Гибридные физико-информированные нейронные сети с граничными условиями для решения уравнений Навье-Стокса со сложными границами

Чтобы понять точное происхождение проблемы, рассматриваемой в данной статье, необходимо обратиться к пересечению гидродинамики и современного искусственного интеллекта.

Введение и академическая преемственность

Чтобы понять точное происхождение проблемы, рассматриваемой в данной статье, необходимо обратиться к пересечению гидродинамики и современного искусственного интеллекта. Десятилетиями ученые и инженеры полагались на уравнения Навье-Стокса (NSE) для описания динамического поведения вязких жидкостей, то есть того, как движутся жидкости и газы. Традиционно эти чрезвычайно сложные нелинейные уравнения решались с помощью вычислительной гидродинамики (CFD). Однако CFD требует процесса, называемого "генерацией сетки", при котором физическое пространство делится на массивную сетку крошечных форм. Создание такой сетки для сложных, неправильных форм невероятно трудно, занимает много времени и может привести к численным неустойчивостям.

В 2019 году произошло прорыв: были представлены физически-информированные нейронные сети (PINN). PINN используют глубокое обучение для решения этих уравнений без необходимости в сетке. Они делают это, встраивая физические законы непосредственно в процесс обучения нейронной сети. Однако по мере того, как исследователи начали применять PINN к реальным задачам гидродинамики, возникла новая, весьма специфическая проблема: работа со сложными границами (например, течение жидкости вокруг неправильных препятствий).

Фундаментальное ограничение — или "болевая точка" — предыдущих подходов PINN заключается в том, что исследователи называют "проблемой конфликта потерь". В обычной PINN ИИ просят одновременно изучать физические правила жидкости (потери PDE) и правила физических границ (потери граничных условий). Поскольку обе эти цели помещаются в единый математический "контейнер" (функция потерь), сеть часто испытывает трудности с их балансировкой. Когда геометрические границы становятся очень сложными, сеть путается. Она может идеально удовлетворять динамику жидкости, но не соблюдать правила твердых стенок, или наоборот. Предыдущие попытки исправить это путем принудительного применения "жестких ограничений" с использованием аналитической математики приводили к искаженным, хаотичным предсказаниям вблизи сложных сопряжений, поскольку эти математические функции не были естественными. Авторы написали эту статью, чтобы разделить эти конфликтующие цели, создав гибридную систему, которая обрабатывает границы и внутреннюю физику жидкости отдельно, но кооперативно.

Вот несколько узкоспециализированных терминов из статьи, переведенных в интуитивно понятные аналогии для полного новичка:

- Уравнения Навье-Стокса (NSE):

- Аналогия: Представьте их как абсолютные, нерушимые "правила дорожного движения" для молекул воды и воздуха. Точно так же, как правила дорожного движения определяют, кто уступает, с какой скоростью можно ехать и как проходить перекресток, не сталкиваясь, NSE точно определяют, как молекулы жидкости должны течь, завихряться и взаимодействовать с давлением и трением, не нарушая законов физики.

- Физически-информированные нейронные сети (PINN):

- Аналогия: Представьте, что вы учите студента рисовать реалистичный пейзаж. Стандартная нейронная сеть просто запоминает миллионы фотографий и пытается скопировать пиксельные узоры. PINN, однако, — это студент, которому также преподают реальные законы гравитации и световой перспективы. Поскольку он знает основные правила, он никогда случайно не нарисует водопад, текущий вверх, даже если он никогда раньше не видел конкретно этот водопад.

- Проблема конфликта потерь:

- Аналогия: Представьте, что вы нанимаете повара и даете ему две строгие инструкции: "Сделайте блюдо невероятно острым" и "Убедитесь, что оно абсолютно неострое для детей". Повар парализован, пытаясь одновременно оптимизировать два совершенно противоречивых требования, что приводит к ужасному блюду. В PINN сеть аналогично парализуется, пытаясь одновременно идеально удовлетворить внутреннюю физику жидкости и сложные правила границ.

- Сеть метрики расстояния ($\mathcal{N_D}$):

- Аналогия: Представьте ее как датчик приближения при парковке в современном автомобиле. Когда вы сдаете назад, он пищит быстрее, чем ближе вы подъезжаете к стене. Эта конкретная подсеть действует как пространственный датчик, точно сообщая основной ИИ, насколько близко он находится к границе, чтобы ИИ точно знал, когда начать строго соблюдать "правила стены" вместо "правил открытой воды".

Ниже приведена таблица, организующая ключевые математические обозначения, переменные и параметры, необходимые для понимания механики предлагаемой модели HB-PINN:

| Обозначение | Тип | Описание |

|---|---|---|

| $\mathbf{u}$ | Переменная | Вектор скорости жидкости (состоящий из горизонтальной и вертикальной компонент $u$ и $v$). |

| $p$ | Переменная | Давление жидкости в данной точке пространства и времени. |

| $\rho$ | Параметр | Плотность жидкости (остается постоянной для несжимаемых течений). |

| $\nu$ | Параметр | Коэффициент динамической вязкости, представляющий внутреннее трение жидкости или ее "густоту". |

| $q(\mathbf{x}, t)$ | Переменная | Общий заполнитель для любой интересующей физической величины, предсказываемой (например, скорости или давления) в пространственных координатах $\mathbf{x}$ и времени $t$. |

| $\mathcal{P}_q(\mathbf{x}, t)$ | Функция | Выход Сети частного решения ($\mathcal{N_P}$), которая строго обучена удовлетворять граничным условиям. |

| $\mathcal{D}_q(\mathbf{x}, t)$ | Функция | Выход Сети метрики расстояния ($\mathcal{N_D}$), представляющий пространственное расстояние от точки до ближайшей границы. |

| $\mathcal{H}_q(\mathbf{x}, t)$ | Функция | Выход Основной Сети ($\mathcal{N_H}$), которая фокусируется исключительно на решении внутренней динамики жидкости (управляющего дифференциального уравнения в частных производных). |

| $\mathcal{L}$ | Параметр | Функция потерь, представляющая ошибку, которую сеть пытается минимизировать. Она разделена на части, такие как $\mathcal{L}_{PDE}$ (ошибка уравнения) и $\mathcal{L}_{BC}$ (ошибка границы). |

| $\lambda_i$ | Параметр | Коэффициенты взвешивания, используемые для указания сети, на какую часть функции потерь важнее сосредоточиться во время обучения. |

| $\alpha$ | Параметр | Положительное значение, контролирующее скорость роста (крутизну) функции расстояния, определяющее, насколько резко сеть переходит от правил границы к внутренним правилам. |

Определение задачи и ограничения

Представьте себе попытку точно предсказать, как вода течет вокруг зазубренного камня или через сложную систему труб. Традиционно инженеры используют вычислительную гидродинамику (CFD), которая требует построения микроскопической, идеальной сетки по всей области течения — процесс, называемый генерацией сетки, который известен своей трудоемкостью и склонностью к численным неустойчивостям.

Физически-информированные нейронные сети (PINNs) обещали блестящий обходной путь: пропустить сетку полностью и просто обучить нейронную сеть законам физики. Однако при применении к реальным, сложным формам эти сети сталкиваются с массивной математической стеной. Давайте подробно разберем, почему это происходит и какую конкретную проблему пытается решить данная статья.

Начальная точка и целевое состояние

Входные данные (текущее состояние):

Мы начинаем с набора пространственно-временных координат $(x, t)$ и управляющих правил гидродинамики, известных как уравнения несжимаемой жидкости Навье-Стокса (NSE):

$$ \nabla \cdot \mathbf{u} = 0 $$

$$ \frac{\partial \mathbf{u}}{\partial t} + (\mathbf{u} \cdot \nabla)\mathbf{u} + \frac{1}{\rho}\nabla p - \nu \nabla^2 \mathbf{u} = 0 $$

Наряду с этими уравнениями мы имеем высокосложные граничные условия — такие как сегментированные входы или нерегулярные препятствующие структуры, где скорость жидкости должна быть точно равна нулю (условие прилипания).

Выходные данные (целевое состояние):

Желаемым конечным результатом является обученная нейронная сеть, которая может мгновенно и точно выдавать вектор скорости $\mathbf{u}$ (состоящий из $u$ и $v$) и давление жидкости $p$ в любой заданной точке.

Математический разрыв:

Отсутствующим звеном является надежный математический мост, который заставляет непрерывную нейронную сеть строго соблюдать резкие, нерегулярные правила на границах, не нарушая ее способности вычислять гладкую, непрерывную физику, происходящую внутри жидкости.

Болезненная дилемма

Предыдущие исследователи оказались в ловушке жестокого компромисса, известного как "проблема конфликта потерь" (loss conflict problem). При попытке решить эту проблему улучшение одного аспекта фундаментально нарушает другой:

- Ловушка мягких ограничений: В традиционных PINNs вы предписываете сети минимизировать единую, гигантскую функцию потерь, которая включает как физические ошибки (потери PDE), так и граничные ошибки. Но сеть перегружается. Она пытается минимизировать оба параметра одновременно, но сложные границы порождают дикие математические градиенты, которые активно противодействуют физическим градиентам во время обучения. В итоге сеть идет на компромисс, что приводит к неточным границам, загрязняющим всю симуляцию течения.

- Ловушка жестких ограничений: Чтобы исправить это, ученые попробовали "жестко ограниченные" PINNs (например, hPINN). Они математически заставили выход сети быть точно равным нулю на границах, используя аналитическую функцию расстояния. Здесь кроется болезненная дилемма: для сложных геометрий эти точные математические формулы крайне неестественны. Принуждение сети через эти жесткие математические рамки приводит к искажению внутренних предсказаний течения, делая их хаотичными и разрывными. Вы идеально исправляете границу, но полностью нарушаете гидродинамику внутри.

Жесткие стены и ограничения

Что делает эту проблему настолько сложной для решения? Авторы столкнулись с несколькими суровыми, реалистичными препятствиями:

- Геометрическая неосуществимость: Чтобы жесткие ограничения работали, вам нужна функция расстояния $D_q(x, t)$, которая вычисляет точное расстояние от любой точки до границы. Для простой плоской стены это базовое алгебраическое уравнение. Для сложных, сегментированных или нерегулярных границ вывод точного аналитического выражения математически невозможен.

- Патологии экстремальных градиентов: Чтобы заставить стандартную сеть обращать внимание на границы, исследователи вынуждены искусственно увеличивать веса граничных потерь (например, устанавливая вес границы $\lambda_2 = 1000$, в то время как вес физики $\lambda_1 = 1$). Это создает огромный дисбаланс. Сеть становится гиперфокусированной на запоминании краев и полностью игнорирует фактические управляющие уравнения жидкости.

- Высоконелинейная физика: Уравнения Навье-Стокса печально известны своей нетерпимостью из-за нелинейного члена конвективного ускорения, математически представленного как $(\mathbf{u} \cdot \nabla)\mathbf{u}$. Из-за этой нелинейности даже микроскопическая ошибка на сложной границе будет быстро усиливаться, дестабилизируя предсказание всего поля течения.

- Пределы пропускной способности сети: Требование к одной нейронной архитектуре одновременно изучать резкие, высокочастотные переходы, необходимые на сложной границе, и гладкую, низкочастотную физическую динамику внутреннего течения, просто превышает стандартные возможности оптимизации. Веса сети не могут легко одновременно представлять оба поведения.

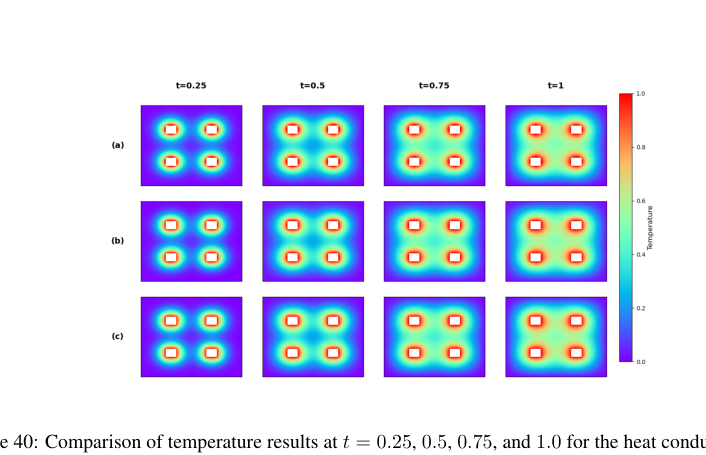

Figure 40. Comparison of temperature results at t = 0.25, 0.5, 0.75, and 1.0 for the heat conduction problem: (a) sPINN predictions; (b) HB-PINN predictions; (c) ground truth (GT)

Figure 40. Comparison of temperature results at t = 0.25, 0.5, 0.75, and 1.0 for the heat conduction problem: (a) sPINN predictions; (b) HB-PINN predictions; (c) ground truth (GT)

Почему данный подход

Чтобы по-настоящему понять, почему авторы разработали гибридную физически-информированную нейронную сеть с граничными условиями (HB-PINN), нам сначала необходимо встать на их место и взглянуть на фундаментальную природу проблемы, которую они пытались решить: моделирование гидродинамики с использованием уравнений Навье-Стокса (NSE).

Если вы задаетесь вопросом, почему авторы не использовали популярную, трендовую модель, такую как GAN, Transformer или Diffusion model, ответ кроется в строгих ограничениях физики. Мы не пытаемся генерировать правдоподобные изображения воды или предсказывать следующее слово в последовательности. Нам необходимо детерминированно решать высоконелинейные дифференциальные уравнения в частных производных (PDE). Генеративные модели отображают шум на распределения данных, что практически бесполезно, когда требуется строгое математическое соответствие физическим законам сохранения (таким как сохранение массы и импульса).

Поскольку традиционное глубокое обучение здесь терпит неудачу, научное сообщество полагается на физически-информированные нейронные сети (PINN). PINN встраивают фактические физические уравнения в функцию потерь нейронной сети. Однако авторы столкнулись с огромным препятствием — в тот момент, когда они поняли, что текущие "SOTA" PINN фундаментально неисправны для реальных приложений.

Проблема возникает, когда поток жидкости обтекает сложные препятствия (например, заблокированную полость или сегментированный вход). Традиционные PINN (часто называемые PINN с мягкими ограничениями, или sPINN) пытаются одновременно изучать управляющие физические уравнения и граничные условия, втискивая их в единую, массивную функцию потерь. Это создает серьезный "конфликт потерь". Градиенты от граничных условий и градиенты от внутренней физики буквально борются друг с другом во время обратного распространения ошибки (backpropagation). Сеть запутывается, и точность резко падает.

Предыдущие попытки исправить это включали PINN с жесткими ограничениями (hPINN), которые заставляют сеть соблюдать границы, используя точные аналитические математические формулы. Но, как авторы явно демонстрируют в Приложении D статьи, при наличии сложных, неправильных геометрий эти аналитические функции перестают работать. Они становятся неестественными и вызывают сильно искаженные, разрывные и хаотичные выходные данные внутри области течения.

Столкнувшись с этой дилеммой — мягкие ограничения вызывают конфликты градиентов, а жесткие ограничения математически разрушаются на сложных формах — авторы поняли, что единственным жизнеспособным решением является разделенная, составная архитектура.

Они разработали HB-PINN для разделения и решения проблемы с помощью трех отдельных подсетей:

1. $\mathcal{N_P}$ (Сеть частного решения): Сеть, обученная исключительно для удовлетворения граничных условий.

2. $\mathcal{N_D}$ (Сеть метрики расстояния): Сеть, которая изучает пространственное расстояние от любой точки до границ.

3. $\mathcal{N_H}$ (Основная сеть): Основная сеть, полностью посвященная решению управляющего PDE во внутренней области.

Они объединили эти сети с помощью блестящей составной формулировки для любой физической величины $q$ (например, скорости или давления):

$$N_q(\mathbf{x}, t) = \mathcal{N}_{\mathcal{P}_q}(\mathbf{x}, t) + \mathcal{N}_{\mathcal{D}_q}(\mathbf{x}, t) \cdot \mathcal{N}_{\mathcal{H}_u}(\mathbf{x}, t)$$

Вот почему эта конкретная математическая модель качественно превосходит предыдущий золотой стандарт. Предварительно обучая $\mathcal{N_P}$ и $\mathcal{N_D}$ с последующим замораживанием их весов, функция расстояния $\mathcal{N_D}$ действует как пространственный привратник. На точной границе $\mathcal{N_D}$ равна 0, что означает, что основная сеть $\mathcal{N_H}$ полностью обнуляется, и выходные данные на 100% зависят от граничной сети $\mathcal{N_P}$. По мере удаления от границы в область течения $\mathcal{N_D}$ плавно переходит к 1, позволяя основной сети $\mathcal{N_H}$ взять на себя управление и решать физические задачи.

Чтобы обеспечить идеальную плавность этого перехода и избежать дестабилизации сети, они ввели степенную функцию для уточнения метрики расстояния:

$$f(\hat{\mathcal{D}}_q) = 1 - (1 - \hat{\mathcal{D}}_q / \max(\hat{\mathcal{D}}_q))^\alpha$$

Настраивая параметр $\alpha$, они могут точно контролировать, насколько круто сеть переходит от границы к внутренней области.

Хотя в статье явно не заявлено снижение сложности по памяти с $O(N^2)$ до $O(N)$ (честно говоря, вычислительным узким местом здесь является оптимизация, а не просто масштабирование памяти), она демонстрирует структурное преимущество, которое делает ее подавляюще превосходящей: полное устранение патологий градиентов. Поскольку основная сеть $\mathcal{N_H}$ больше не должна беспокоиться об удовлетворении граничных условий, она может сосредоточиться исключительно на минимизации остатка PDE. Это структурное разделение приводит к снижению среднеквадратичной ошибки (MSE) на порядок по сравнению с SOTA моделями, такими как XPINN, SA-PINN и PirateNet.

Этот подход представляет собой идеальный "брак" между жесткими требованиями задачи и уникальными свойствами решения. Задача требовала строгого соблюдения граничных условий без опоры на невозможную аналитическую математику; решение предоставило это, используя нейронную сеть ($\mathcal{N_D}$) для аппроксимации геометрии, эффективно превращая геометрически невозможное жесткое ограничение в высокогибкое, обучаемое.

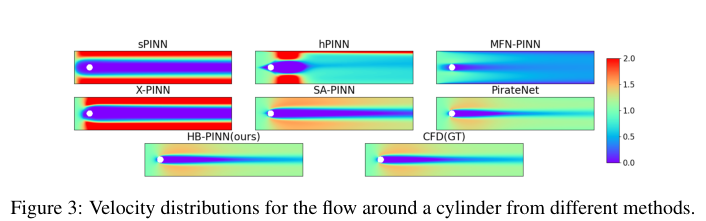

Figure 3. Velocity distributions for the flow around a cylinder from different methods

Figure 3. Velocity distributions for the flow around a cylinder from different methods

Математический и логический механизм

Чтобы понять прорыв, представленный в данной статье, необходимо сначала рассмотреть фундаментальную проблему моделирования жидкостей. Десятилетиями инженеры полагались на вычислительную гидродинамику (CFD) для понимания того, как воздух обтекает крыло или как вода движется по трубе. Эти традиционные методы требуют "создания сетки" — разбиения пространства на миллионы крошечных геометрических ячеек. Создание сетки является вычислительно затратным, трудоемким и склонным к нестабильности, когда границы (например, форма препятствия) становятся очень сложными.

Недавно в качестве революционной альтернативы появились физически-информированные нейронные сети (PINNs). Вместо использования сетки, PINNs применяют глубокое обучение для угадывания решения, наказывая нейронную сеть, если ее предположение нарушает законы физики (в частности, уравнения Навье-Стокса). Однако стандартные PINNs сталкиваются с серьезным препятствием: "конфликтом потерь". Когда жидкость сталкивается со сложной границей, нейронная сеть сбивается с толку. Она пытается одновременно удовлетворить сложные граничные условия (стенки) и динамику жидкости (внутреннюю часть). Математические градиенты, борющиеся за эти две цели, в конечном итоге взаимно уничтожаются, что приводит к крайне неточным симуляциям.

Авторы данной статьи решили эту проблему, создав гибридную PINN с граничными условиями (HB-PINN). Вместо того чтобы заставлять одну сеть изучать все, они построили составную архитектуру, которая строго разделяет граничные ограничения и внутреннюю физику.

Вот основное уравнение, которое лежит в основе всей этой структуры:

$$ \mathcal{N}_q(\mathbf{x}, t) = \mathcal{N}_{\mathcal{P}_q}(\mathbf{x}, t) + \mathcal{N}_{\mathcal{D}_q}(\mathbf{x}, t) \cdot \mathcal{N}_{\mathcal{H}_q}(\mathbf{x}, t) $$

Разберем это уравнение по частям, чтобы точно понять, как оно манипулирует данными.

- $\mathcal{N}_q(\mathbf{x}, t)$:

- Математическое определение: Финальная составная выходная функция для определенной физической величины $q$ (которая может быть скоростью $u$, скоростью $v$ или давлением $p$) в заданной пространственной координате $\mathbf{x}$ и времени $t$.

- Физическая/логическая роль: Это готовый продукт. Он представляет точное состояние жидкости в любой заданный момент времени и в любой точке пространства.

- $\mathcal{N}_{\mathcal{P}_q}(\mathbf{x}, t)$:

- Математическое определение: Выход сети частного решения (Particular Solution Network).

- Физическая/логическая роль: Эта сеть действует как "исполнитель граничных условий". Это предварительно обученная нейронная сеть, единственная задача которой — идеально запомнить и удовлетворить граничные условия (например, обеспечить нулевую скорость у твердой стенки).

- $+$ (Оператор сложения):

- Почему сложение, а не умножение? Сложение позволяет применять принцип суперпозиции. Сеть использует $\mathcal{N}_{\mathcal{P}_q}$ в качестве базового уровня. Если бы авторы использовали умножение, нулевое значение от граничной сети действовало бы как черная дыра, полностью аннигилируя любую физику, рассчитанную во внутренней части. Сложение позволяет модели сказать: "Начни с этого граничного базового уровня и добавь к нему внутреннюю динамику жидкости".

- $\mathcal{N}_{\mathcal{D}_q}(\mathbf{x}, t)$:

- Математическое определение: Выход сети метрики расстояния (Distance Metric Network), сформированный степенной функцией.

- Физическая/логическая роль: Это пространственная маска или "регулятор громкости". Она выдает значение ровно $0$ на границах и быстро увеличивается до $1$ по мере удаления от границы во внутреннюю часть жидкости.

- $\cdot$ (Оператор умножения):

- Почему умножение, а не сложение? Это действует как пространственный множитель или механизм вентилирования. Умножая метрику расстояния на основную физическую сеть, уравнение заставляет физическую сеть умножаться на $0$ на границах. Это полностью заглушает движок внутренней физики у стенок, гарантируя, что исполнитель граничных условий ($\mathcal{N}_{\mathcal{P}_q}$) имеет 100% абсолютный авторитет на краях.

- $\mathcal{N}_{\mathcal{H}_q}(\mathbf{x}, t)$:

- Математическое определение: Выход основной сети (Primary Network).

- Физическая/логическая роль: Это мощный физический движок. Это большая нейронная сеть, полностью посвященная решению уравнений Навье-Стокса во внутренней части области.

Пошаговый процесс

Представьте себе одну абстрактную точку данных — координату в пространстве и времени $(\mathbf{x}, t)$ — поступающую на эту математическую сборочную линию.

Сначала координата дублируется и одновременно подается в три отдельные нейронные сети. На первом пути сеть частного решения оценивает точку и выдает базовое физическое значение, которое идеально соответствует ближайшей стенке. На втором пути сеть метрики расстояния измеряет, насколько далеко эта точка находится от границы, выдавая процент (например, $0.0$, если она на стенке, $0.99$, если она глубоко внутри жидкости). На третьем пути основная сеть рассчитывает сложную динамику жидкости для этой точки.

Затем сборочная линия объединяется. Сырой расчет физики из основной сети умножается на процент расстояния. Если точка находится на стенке, расчет физики умножается на ноль и отбрасывается. Если она находится в открытой жидкости, она сохраняется почти полностью. Наконец, этот масштабированный расчет физики добавляется к базовому граничному значению. Результатом является бесшовный, физически точный прогноз, который идеально соответствует сложным геометриям без борьбы сетей друг с другом.

Динамика оптимизации

Чтобы понять, как этот механизм фактически обучается, мы должны посмотреть, как формируется ландшафт потерь. В стандартной PINN функция потерь представляет собой запутанную комбинацию граничных ошибок и ошибок физики. Градиенты (математические стрелки, указывающие сети в правильном направлении) постоянно сталкиваются.

HB-PINN решает эту проблему с помощью поэтапной динамики оптимизации. Сначала граничная сеть ($\mathcal{N}_{\mathcal{P}}$) и сеть расстояния ($\mathcal{N}_{\mathcal{D}}$) предварительно обучаются, а затем замораживаются. Их веса фиксируются.

Поскольку границы уже идеально обработаны и зафиксированы, основная сеть ($\mathcal{N}_{\mathcal{H}}$) оптимизируется, используя только потери физики:

$$ \mathcal{L}_{\mathcal{H}} = \frac{1}{N_{\text{PDE}}} \sum_{i=1}^{N_{\text{PDE}}} \left( \| \nabla \cdot \mathbf{\hat{u}} \|^2 + \left\| \frac{\partial \mathbf{\hat{u}}}{\partial t} + (\mathbf{\hat{u}} \cdot \nabla)\mathbf{\hat{u}} + \frac{1}{\rho}\nabla \hat{p} - \nu\nabla^2\mathbf{\hat{u}} \right\|^2 \right) $$

Здесь авторы используют суммирование ($\sum$) по $N_{\text{PDE}}$ дискретным коллокационным точкам, а не непрерывный пространственный интеграл. Почему? Потому что нейронные сети обучаются на дискретных пакетах данных. Мы не можем вычислить истинный непрерывный интеграл по бесконечному числу точек в памяти компьютера, поэтому мы выбираем тысячи дискретных точек и суммируем их ошибки для аппроксимации интеграла.

Члены внутри норм ($\| ... \|^2$) являются точными остатками уравнений Навье-Стокса для несжимаемой жидкости (сохранение массы и сохранение импульса). Поскольку граничные ограничения математически гарантированы замороженными подсетями, ландшафт потерь для $\mathcal{L}_{\mathcal{H}}$ значительно сглаживается. Градиенты больше не страдают от патологических конфликтов. Они указывают строго вниз, к минимизации остатка физики. Сеть сходится быстрее, избегает локальных минимумов, вызванных геометрическими сложностями, и достигает передовой точности, просто позволяя физическому движку сосредоточить 100% своей обучающей способности на динамике жидкости.

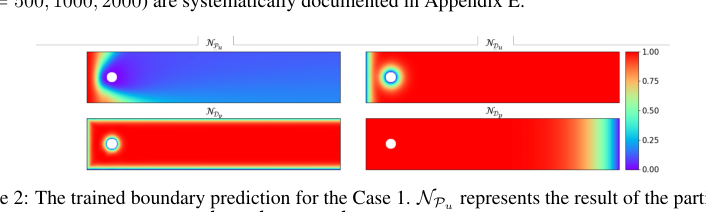

Figure 2. The trained boundary prediction for the Case 1. NPu represents the result of the particular solution network for u, while NDu, NDv, and NDp respectively represent the results of the distance metric network for u, v, and p

Figure 2. The trained boundary prediction for the Case 1. NPu represents the result of the particular solution network for u, while NDu, NDv, and NDp respectively represent the results of the distance metric network for u, v, and p

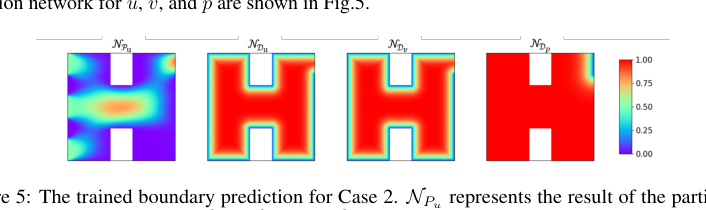

Figure 5. The trained boundary prediction for Case 2. NPu represents the result of the particular solution network for u, while NDu, NDv, and NDp respectively represent the results of the distance metric network for u, v, and p

Figure 5. The trained boundary prediction for Case 2. NPu represents the result of the particular solution network for u, while NDu, NDv, and NDp respectively represent the results of the distance metric network for u, v, and p

Результаты, Ограничения и Заключение

Предыстория: Правила реки и ИИ, которые их изучает

Чтобы понять эту статью, нам сначала необходимо разобраться в двух концепциях: уравнениях Навье-Стокса (NSE) и физически-информированных нейронных сетях (PINN).

Представьте, что вы пытаетесь точно предсказать, как вода будет течь вокруг камня в реке. В физике мы используем уравнения Навье-Стокса, которые, по сути, являются фундаментальными законами движения жидкостей и газов. Они рассчитывают взаимодействие давления, скорости и вязкости. Однако эти уравнения чрезвычайно трудно решить. Традиционно инженеры используют вычислительную гидродинамику (CFD), которая включает разбиение реки на миллионы крошечных цифровых сеток (генерация сетки) и расчет математики для каждой сетки. Это очень точно, но невероятно медленно и вычислительно дорого.

Вступают PINN. Вместо того чтобы разбивать пространство на сетку, мы просим искусственный интеллект (нейронную сеть) угадать течение воды. Но мы не позволяем ему угадывать вслепую; мы встраиваем уравнения Навье-Стокса непосредственно в "функцию потерь" ИИ (его систему штрафов). Если ИИ угадывает течение, нарушающее законы физики, он получает штраф. Со временем он учится предсказывать физически точную гидродинамику без необходимости сложной сетки.

Однако есть нюанс: граничные условия (BCs). Правила реки меняются на границах. Например, вода, касающаяся поверхности камня, имеет скорость ровно ноль (это называется условием прилипания).

Мотивация и ограничение: "Конфликт потерь"

Основная проблема, которую решает эта статья, заключается в том, что стандартные PINN ужасно справляются с многозадачностью.

Когда стандартный PINN пытается решить задачу гидродинамики, он должен одновременно минимизировать два штрафа:

1. Потери PDE: "Соблюдаю ли я физику воды, текущей в середине реки?"

2. Потери BC: "Соблюдаю ли я правило, что вода перестает двигаться точно на поверхности камня?"

Когда границы простые (например, прямая труба), ИИ справляется с этим нормально. Но когда границы сложны — например, множество зазубренных камней или сегментированные входы — ИИ страдает от конфликта потерь. Градиенты (математические толчки, указывающие ИИ, как улучшиться) для граничных правил и внутренней физики начинают конфликтовать друг с другом. ИИ путается, идет на компромисс и в итоге терпит неудачу в обоих случаях.

Ограничением, которое авторам пришлось преодолеть, было найти способ строго обеспечить соблюдение граничных правил, не нарушая способность ИИ изучать физику во внутренней области, сохраняя при этом гладкость и дифференцируемость математики, чтобы нейронная сеть могла ее обрабатывать.

Математическая интерпретация: Что они решили и как

Авторы решили эту проблему, полностью разделив задачу. Вместо того чтобы заставлять один ИИ делать все, они создали гибридную граничную PINN (HB-PINN), которая использует три специализированные подсети.

Математически они переопределили предсказание любой физической величины $q(x, t)$ (например, скорости или давления) с помощью этого элегантного составного уравнения:

$$q(x, t) = \mathcal{N}_{P_q}(x, t) + \mathcal{N}_{D_q}(x, t) \cdot \mathcal{N}_{H_q}(x, t)$$

Разберем, что именно это означает:

- $\mathcal{N}_{P_q}$ (Сеть частного решения): Эта сеть предварительно обучена с одной основной задачей: удовлетворять граничным условиям. Она изучает, что должно происходить с жидкостью непосредственно у стенок.

- $\mathcal{N}_{D_q}$ (Сеть метрики расстояния): Это хитрая часть. Она рассчитывает, насколько точка удалена от границы. Она выдает ровно $0$ на границе и быстро увеличивается до $1$ по мере движения в открытую жидкость. Они использовали специфическую степенную функцию для управления этим переходом:

$$f(\hat{D}_q) = 1 - (1 - \hat{D}_q / \max(\hat{D}_q))^\alpha$$ - $\mathcal{N}_{H_q}$ (Основная сеть): Эта сеть фокусируется только на уравнениях Навье-Стокса внутри жидкости.

Посмотрите снова на основное уравнение. На границе сеть расстояния $\mathcal{N}_{D_q}$ выдает $0$. Это означает, что $0 \cdot \mathcal{N}_{H_q}$ становится $0$, и внутренняя сеть полностью заглушается. Окончательный ответ — это просто $\mathcal{N}_{P_q}$, которая идеально удовлетворяет граничным правилам! По мере удаления от стенки $\mathcal{N}_{D_q}$ становится $1$, позволяя основной сети $\mathcal{N}_{H_q}$ взять на себя управление и решать физику. Конфликт потерь математически аннигилируется.

Экспериментальная архитектура и "жертвы"

Авторы не просто бросили несколько цифр на стол, чтобы заявить о победе; они разработали безжалостную испытательную площадку. Они создали три сценария гидродинамики, кульминацией которых стал очень сложный "сегментированный вход с препятствием в квадратной полости" (по сути, коробка с несколькими заблокированными входными отверстиями и внутренними стенами) как в стационарных, так и в нестационарных (меняющихся во времени) условиях.

"Жертвами" в этом эксперименте стали сливки общества передовых физических ИИ:

* sPINN (стандартная базовая линия)

* hPINN (жестко ограниченная PINN, предыдущая попытка исправить границы)

* MFN-PINN (модифицированная Фурье-сеть)

* XPINN & SA-PINN (продвинутые модели декомпозиции областей и самоадаптивные модели)

* PirateNet (очень недавняя, высокоустойчивая архитектура)

Окончательное доказательство:

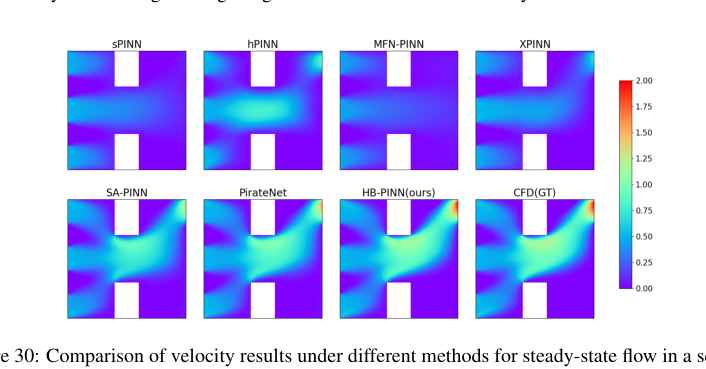

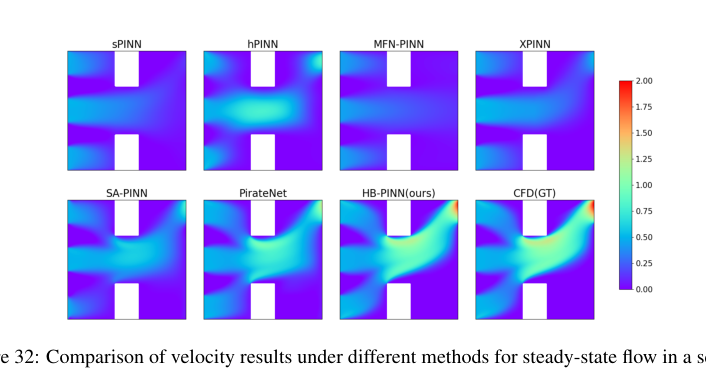

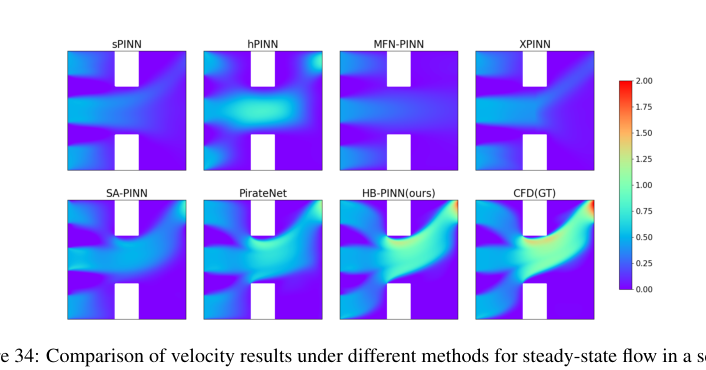

Неоспоримым доказательством превосходства HB-PINN были не только таблицы среднеквадратичной ошибки (MSE) — хотя достижение снижения ошибки на порядок впечатляет. Окончательным доказательством стали визуальные карты остатков.

Авторы использовали высокоточную вычислительную гидродинамику (CFD) как абсолютную истину. При взгляде на тепловые карты ошибок (остатков) модели-жертвы демонстрировали огромные, бросающиеся в глаза красные зоны (высокая ошибка), сосредоточенные точно вокруг углов внутренних препятствий и сложных входов. Базовые модели просто не могли разобраться в физике вблизи странных границ. В резком контрасте карты остатков HB-PINN были почти полностью темно-синими (ошибка близка к нулю) по всей области.

Более того, они увеличили сложность, повысив число Рейнольдса до 2000 (сделав поток очень хаотичным). В то время как ошибки базовых моделей резко возросли, HB-PINN сохранила свою структурную целостность и точность, доказав, что механизм разделения работает в экстремальных условиях.

Темы для будущих обсуждений

Основываясь на этой блестящей статье, вот несколько разнообразных перспектив и тем для будущих исследований и критического осмысления:

1. Автоматизация параметра $\alpha$

В сети метрики расстояния крутизна перехода от стенки к внутренней области контролируется параметром $\alpha$. Авторы отмечают, что в настоящее время они определяют это значение эмпирически (методом проб и ошибок, обнаружив, что $\alpha=5$ хорошо работает для случая 2). Можем ли мы развить эту структуру, сделав $\alpha$ обучаемым параметром? Если бы сеть могла динамически адаптировать крутизну пограничного слоя в зависимости от локальной турбулентности жидкости, модель могла бы стать полностью самонастраивающейся.

2. Масштабирование до 3D и движущихся границ

Эксперименты здесь строго двумерные со статическими препятствиями. В реальном машиностроении (например, пропеллер дрона или бьющееся человеческое сердце) границы являются трехмерными и постоянно движутся. Честно говоря, я не совсем уверен, как вычислительные накладные расходы на выборку метрики расстояния масштабируются теоретически при переходе к очень сложным трехмерным геометриям, поскольку авторы в основном сосредоточены на эмпирическом времени в 2D. Обсуждение того, как эффективно вычислять $\mathcal{N}_D$ в четырехмерном пространственно-временном континууме с движущимися границами, является критически важным следующим шагом.

3. Стоимость предварительного обучения по сравнению с сквозным обучением

HB-PINN требует предварительного обучения сети частного решения ($\mathcal{N}_P$) и сети расстояния ($\mathcal{N}_D$) перед обучением основной сети ($\mathcal{N}_H$). Хотя это решает проблему конфликта потерь, это вводит многоэтапный конвейер. Оправдана ли вычислительная стоимость обучения трех отдельных сетей в более простых сценариях? Ценным обсуждением было бы исследование того, можно ли объединить эти три сети в единую архитектуру с новым механизмом управления, который обеспечивает такое же математическое разделение без необходимости последовательного предварительного обучения.

Figure 30. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 500

Figure 30. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 500

Figure 32. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 1000

Figure 32. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 1000

Figure 34. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 2000

Figure 34. Comparison of velocity results under different methods for steady-state flow in a square cavity with obstructed segmented inlet at Reynolds number Re = 2000