QKAN:量子Kolmogorov-Arnold网络及其在机器学习和多变量状态制备中的应用

We introduce quantum Kolmogorov-Arnold networks (QKAN), a quantum algorithmic framework inspired by the recently proposed Kolmogorov-Arnold Networks (KAN).

背景与学术渊源

起源与学术渊源

本文所解决的问题,即量子Kolmogorov-Arnold网络(QKAN)的开发,精确地源于经典神经网络与量子计算的交叉点,尤其受到近期提出的经典Kolmogorov-Arnold网络(KAN)[5]的启发。其学术历史可以追溯到20世纪50年代一项基础性的数学成果——Kolmogorov-Arnold表示定理(KART)[1-4]。KART指出,任何连续的多变量函数(具有多个输入变量的函数)都可以分解为有限个单变量函数(仅具有一个输入变量的函数)的组合与求和。该定理为理解复杂函数如何使用更简单的构建块来表示提供了理论基础。

然而,KART在实际应用中,尤其是在神经网络领域,其直接应用受到限制,因为定理保证的内函数和外函数可能高度不光滑,难以精确且鲁棒地逼近[5]。这个“痛点”意味着,尽管KART在理论上强大,但它并未直接转化为有效的神经网络架构。

这种情况随着Liu等人[5]近期引入Kolmogorov-Arnold网络(KAN)而改变。KAN推广了KART的组合结构,允许任意层数,而KART仅保证两层。尽管经典KAN不具备KART的通用表示性质,但它们在特定应用中,尤其是在科学领域,通过提供更好的可解释性和在小规模任务上提高准确性,展现出潜力。它们还有可能通过揭示目标函数的模块化结构来帮助发现新的物理定律[10]。

本文作者受到经典KAN潜力的驱动,寻求引入其量子版本——QKAN。作者撰写本文的根本动机源于现有量子方法的局限性,这与量子机器学习模型的本质有关。现有的量子学习模型,如变分量子算法(VQAs)[34-39],通常依赖于优化量子电路中的参数。相比之下,QKAN提供了一种不同的范式:它将块编码矩阵的特征值视为“神经元”,并使用量子奇异值变换(QSVT)在网络的“边”上应用参数化激活函数。这种方法旨在量子环境中利用KAN的组合结构,可能在某些任务上提供效率优势,尤其是在输入存在高效块编码的情况下。然而,QKAN也面临其自身的限制:使用QSVT递归组合层会导致电路深度呈指数级增长,这意味着QKAN自然地局限于浅层架构。

直观的领域术语

-

Kolmogorov-Arnold表示定理(KART):想象你有一个包含许多配料和步骤的非常复杂的食谱。KART就像一个数学证明,说明无论食谱多么复杂,你总能将其分解为一系列更简单、仅包含一种配料的迷你食谱,然后将它们组合起来。它旨在将复杂性简化为可管理的、单变量的部分。

-

块编码(Block-encoding):设想一个你想安全发送的秘密消息(一个矩阵或向量)。块编码就像将这个秘密消息嵌入到一个更大的、看似普通的文档(一个酉量子操作)中。这个更大的文档看起来无害,但其中一个特定的“块”包含了你缩小的秘密消息。量子计算机可以操作这个更大的文档,有效地处理你的隐藏消息,而无需直接“读取”它。

-

量子奇异值变换(Quantum Singular Value Transformation, QSVT):想象一个照片编辑应用程序,你想对图像中的特定颜色或图案应用某种效果,比如改变亮度或对比度。QSVT是一种强大的量子技术,就像一个高度精确的数字滤波器。它可以将几乎任何期望的数学函数(如多项式)应用于块编码矩阵中编码的信息的“强度”或“重要性”(奇异值),从而实现非常具体和复杂的变换。

-

多变量状态制备(Multivariate State Preparation):想象你想创建一个独特的和弦,其中每个音符的响度由一个涉及多个因素(如温度、湿度和一天中的时间)的复杂数学公式精确确定。量子计算中的多变量状态制备是指创建一个量子态(一组量子比特),其中每个可能结果(比特的组合)的“响度”或“幅度”被设置为匹配一个具有多个输入变量的复杂函数的值。这就像将一个复杂的数值景观直接编码到量子领域。

符号表

| 符号 | 描述 |

|---|---|

问题定义与约束

核心问题表述与困境

本文介绍了量子Kolmogorov-Arnold网络(QKAN)作为一种受经典Kolmogorov-Arnold网络(KAN)启发的量子算法框架。核心问题是为机器学习和多变量状态制备应用开发一种高效的KAN量子实现。

输入/当前状态:

QKAN的起点是$N$维实向量$\vec{x} \in [-1,1]^N$的块编码。这意味着向量的分量被编码在一个酉矩阵$U_x$的对角项中,使得$|| \langle 0|_a U_x |0\rangle_a - \text{diag}(x_1, \dots, x_N) || \le \epsilon_x$。对于量子机器学习,此输入可以是量子态的幅度或矩阵的对角项。对于多变量状态制备,输入通常是向量化的$D$维网格点,也以对角块编码的形式提供。

输出/目标状态:

目标终点取决于应用:

* 作为量子学习模型: 目标是产生一个$K$维输出向量$\Phi(\vec{x}) \in [-1,1]^K$的对角块编码。该输出向量的项,$\Phi(\vec{x})_q = \frac{1}{N} \sum_{p=1}^N \phi_{pq}(x_p)$,其中$\phi_{pq}$是单变量激活函数,需要以$\delta$的加性精度进行经典估计。

* 作为多变量量子状态制备协议: 目标是制备一个量子态$|\psi\rangle$,其幅度对应于输入的某个多变量函数,例如在规则平方网格上的$D$维高斯分布。这是通过将最终块编码应用于均匀叠加态,然后使用幅度放大来实现的。

缺失环节/数学鸿沟:

本文试图弥合的基本鸿沟是将经典KAN的组合结构高效准确地转化为量子计算范式。经典KAN将复杂的多变量函数分解为单变量函数的组合和求和。挑战在于使用量子操作实现这些非线性单变量函数及其求和,特别是利用块编码数据上的量子奇异值变换(QSVT),同时克服量子固有的约束,如酉性和误差传播。本文旨在提供一个具体的量子架构,能够以潜在的量子加速执行这些操作。

困境与痛苦的权衡:

先前试图解决量子机器学习和状态制备类似问题的研究人员面临着几个痛苦的权衡:

* 量子加速 vs. 经典读出: 虽然量子算法可以高效地处理指数级大的数据结构(如块编码),但经典地提取完整输出可能会抵消任何量子优势。对于QKAN,实现量子加速取决于经典后处理成本保持亚指数级。这意味着输出维度$K$必须限制在$O(\text{polylog}(N))$,因为估计指数数量的值本身就需要指数时间。

* 浅层 vs. 深层架构: QKAN被设计为“宽而浅”。当存在高效的块编码时,它们可以以对数成本实现指数级宽度的层,这是经典神经网络无法达到的。然而,用于组合多层的基于QSVT的递归构造会产生电路深度的指数级开销。这迫使QKAN保持浅层,通常限制在$L=O(1)$层,以维持计算可行性。

* 精度 vs. 查询复杂度: 对于量子学习模型的输出估计,实现更高的精度(更小的$\delta$)需要对受控对角块编码进行更多的查询。具体来说,$\delta$的加性近似需要$O(d^2/\delta)$次查询。如果需要乘性误差,查询次数会增加到$O(d^2/(\delta|a_q|))$,这意味着潜在的量子加速仅在幅度$a_q$不呈指数衰减时才能保持。这在期望精度和所需的计算资源(查询)之间造成了权衡。

约束与失效模式

实现QKAN的问题因几个严峻、现实的障碍而变得异常困难:

- 酉性约束: 量子力学要求所有操作都必须是酉的。这施加了一个严格的约束,即所有向量元素(输入、输出和权重)在编码为块编码时,其幅度必须小于等于一。这是一个基本的物理约束,需要仔细地对数据进行归一化和缩放。

- 输入的有效块编码: QKAN的门复杂度与构造$N$维输入向量的初始块编码的成本成线性关系。为了使QKAN提供量子加速,输入必须能够以$O(\text{polylog}(N))$时间内准备好的高效块编码形式存在。如果输入编码本身需要$O(N)$个门,那么相对于经典算法的量子优势就会丧失。这是一个重要的由数据驱动的约束。

- 递归误差传播: 输入和权重的块编码中的不完美会累积。在多层QKAN中,这些误差会随着每一层的增加而递归传播,导致最终输出块编码的误差放大。这使得在高精度深层QKAN的实现上极其困难,并限制了其实际深度。

- 深层架构的指数级电路深度: QKAN构造的递归性质,其中一层输出的块编码作为下一层的输入,导致电路深度与层数$L$呈指数关系。这个计算约束严重地将QKAN限制在浅层架构($L=O(1)$),尽管深层网络在理论上具有优势。

- 辅助量子比特限制: QKAN构造所需的辅助量子比特总数随层数$L$线性增加。虽然不是指数级增长,但对于当前和近期的量子设备来说,这仍然可能是一个硬件内存限制。

- 多项式逼近的局限性: QSVT是应用非线性变换的核心机制,它依赖于目标函数的多项式逼近。并非所有函数都能被低次多项式有效逼近,这限制了QKAN在某些任务上的表达能力和准确性。例如,为高斯状态制备逼近指数函数需要足够高的多项式次数,这会影响整体精度。

- 实值限制: 当前工作明确将范围限制在实值输入、输出和权重。虽然推广到复数是可能的,但留待未来工作,表明模型当前的应用存在局限性。

- 梯度估计的成本: 使用参数偏移规则(parameter-shift rules)来获得解析梯度来训练QKAN的计算成本很高。成本对于单层QKAN为$O(d)$次查询,对于$L$层QKAN为$O(d^2L)$,其中$d$是切比雪夫多项式的最大次数。这种随层数呈指数增长的成本使得训练深层QKAN极其困难且资源消耗巨大。

为什么选择这种方法

选择的必然性

采用量子Kolmogorov-Arnold网络(QKAN)不仅仅是一个选择,而是由量子领域中多变量函数逼近和状态制备的独特需求所驱动的内在必然。作者认识到传统“最先进”(SOTA)方法不足,源于几个关键观察。

首先,经典Kolmogorov-Arnold网络(KAN)在可解释性和特定任务(尤其是在涉及符号函数的科学应用)的准确性方面,已经显示出优于传统多层感知机(MLP)的定性优势。为了将这些优势转化为量子计算,一种量子原生的方法是必不可少的。标准的量子机器学习模型,如采用参数化量子电路的变分量子算法(VQAs),或量子CNN和Transformer版本,通常依赖于不同的架构原则,这些原则并不固有地捕捉KAN的组合结构。

关键的“顿悟”时刻可能发生在考虑如何在量子框架内实现KAN核心的非线性激活函数,同时保持量子加速时。直接在量子态上模拟经典非线性通常效率低下。量子奇异值变换(QSVT)成为唯一可行的解决方案,因为它提供了一种强大而通用的元算法,用于将多项式变换应用于块编码矩阵的奇异值。这种能力正是实现KAN的单变量激活函数在量子环境中所需的。没有QSVT,在量子数据(表示为块编码)上高效实现此类非线性将是难以处理的,或者会抵消任何潜在的量子优势。本文明确指出,QKAN“将块编码矩阵的特征值视为神经元,并通过切比雪夫多项式或其他可以通过QSVT有效实现的基函数的线性组合,在网络边上应用参数化激活函数”,突出了QSVT作为核心赋能者。

相对优越性

QKAN在结构上展现出压倒性的优势,使其在特定问题类别上定性优于之前的黄金标准。最显著的优势在于其“宽而浅”的架构。虽然递归组合QKAN层会导致深度的指数级开销,将架构限制在浅层配置($L = O(1)$)中,但这种浅层深度通过在对数成本下实现指数级宽度的层得到了极大的补偿,前提是存在高效的输入块编码。这个领域是经典神经网络根本无法企及的,后者需要$O(N)$的运行时间来处理$N$维状态。

例如,QKAN可以在$O(\text{polylog}(N))$时间内处理$N$维量子态,计算其幅度的多变量函数,假设目标函数具有高效的多项式逼近。这提供了比相同操作的经典$O(N)$运行时间显著的量子加速。这种效率源于QKAN对块编码和QSVT的依赖,它们允许高效地操作指数级大的酉算子。

此外,QKAN继承了经典KAN的可解释性优势。检查单个激活函数并修剪那些类似于零函数的激活函数的能力,使得有可能发现稀疏组合结构和新的物理定律,这是深度学习黑箱模型通常缺乏的定性优势。QSVT框架的多功能性也意味着QKAN不局限于切比雪夫多项式,而是可以实现各种基函数,为不同的应用量身定制灵活性。本文没有明确详细说明处理高维噪声或将内存复杂度从$O(N^2)$降低到$O(N)$的优势,但块编码方法本身就压缩了信息,并且宽层的对数尺度意味着对大输入具有高度高效的资源利用。

与约束的契合

所选的QKAN方法与量子计算的固有约束和问题定义完美契合。

-

高效的输入编码: 量子算法实现加速的一个主要约束是输入数据的有效准备或编码。QKAN通过操作输入向量的块编码完美契合。其门复杂度与构造这些块编码的成本成线性关系,对于固有的量子输入(例如,量子态的幅度或哈密顿量的块编码)可以高效地达到$O(\text{polylog}(N))$。这确保了输入瓶颈不会抵消量子优势。

-

酉性和有界值: 量子计算严格要求操作必须是酉的。QKAN基于QSVT的设计,固有地遵守了这一点。块编码表示本身确保了向量被编码在酉矩阵中,并且这些向量的元素幅度被限制在一以内,满足了量子态的幅度约束。

-

浅层深度要求: 使用QSVT递归构造QKAN层会导致每增加一层电路深度呈指数级增长。这个约束自然地将QKAN强制为一个浅层架构($L=O(1)$)。这个约束并非局限,而是定义了QKAN作为“宽而浅”模型的利基市场,其中指数级宽度可以补偿有限的深度,从而使解决方案的特性与这一严峻要求相符。

-

实值操作: 本文明确将讨论范围限制在输入、输出和权重的实数值。QKAN使用切比雪夫多项式和块编码框架的构造非常适合处理实值函数,尽管推广到复数被视为未来工作。

替代方案的拒绝

本文通过强调QKAN独特的架构和功能差异,暗示了对其他流行的量子机器学习方法的拒绝。

首先,QKAN不同于“变分架构”(VQAs),后者通常是启发式的,依赖于优化参数化量子电路中的参数。虽然VQAs适用于近期量子设备,但QKAN“进入了更强大的量子线性代数工具集”,表明其专注于通过精确构造实现容错量子加速,而不是启发式优化。对于高效制备多变量量子态或逼近具有组合结构的函数这一特定问题,QKAN的基于QSVT的方法提供了通往量子优势的更直接、可能更鲁棒的途径。

其次,QKAN的组合结构,受经典KAN启发,与量子MLP的固定、密集层,或量子CNN或Transformer的特定归纳偏置根本不同。这些替代架构可能无法自然地捕捉KAN将函数表示为单变量函数组合和求和的能力,也不会固有地提供相同的可解释性优势。本文“与先前架构相反”的陈述强调了这种区别。

尽管本文没有明确说明为什么例如量子GAN或量子扩散模型会失败,但其强调了QKAN在对数成本下实现指数级宽度层以处理块编码输入的能力,以及其在科学发现中的可解释性,这表明存在一个领域,其中这些特定优势至关重要。其他方法可能无法提供相同的量子加速、特定函数结构、块编码数据的高效处理以及固有的可解释性的组合。

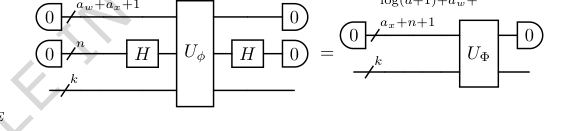

FIG. 9. Step 5. Sum the individual activation functions over N input nodes for each output node, creating the desired diagonal block-encoding UΦ of the K-dimensional output vector Φ(⃗x). This is achieved by sandwiching the block-encoding from Step 4 with two n-qubit Hadamard gates. The dimension reduction occurs as the n qubits originally used for input block-encoding are moved to the auxiliary register

FIG. 9. Step 5. Sum the individual activation functions over N input nodes for each output node, creating the desired diagonal block-encoding UΦ of the K-dimensional output vector Φ(⃗x). This is achieved by sandwiching the block-encoding from Step 4 with two n-qubit Hadamard gates. The dimension reduction occurs as the n qubits originally used for input block-encoding are moved to the auxiliary register

数学与逻辑机制

主方程

量子Kolmogorov-Arnold网络(QKAN)层,特别是CHEB-QKAN变体,其核心数学引擎体现在它如何将输入向量$\vec{x}$转换为输出向量$\Phi(\vec{x})$。这种变换被表示为$K$维向量的对角块编码,其中每个分量是单变量激活函数的和。激活函数本身被定义为切比雪夫多项式的线性组合。

单层QKAN的输出由下式给出:

$$ \Phi(\vec{x}) = \text{diag}\left( \frac{1}{N} \sum_{p=1}^N \phi_{p1}(x_p), \dots, \frac{1}{N} \sum_{p=1}^N \phi_{pK}(x_p) \right)^T $$

其中,每个单变量激活函数$\phi_{pq}(x)$被定义为第一类切比雪夫多项式的线性组合:

$$ \phi_{pq}(x) = \frac{1}{d+1} \sum_{r=0}^d w_{pq}^{(r)} T_r(x) $$

按项解剖

让我们剖析这些方程,以理解每个组件的角色和数学定义:

- $\Phi(\vec{x})$:这代表单层QKAN的输出。

- 数学定义:它是一个$K$维向量,其元素是聚合和转换后的输入特征。在量子语境中,它被块编码为一个对角矩阵,意味着其分量出现在一个更大的酉算子的对角线上。

- 物理/逻辑作用:这是QKAN层产生的“处理后的信息”。它充当经典神经网络层输出的类比,但以量子兼容的格式。

- $\text{diag}(\dots)^T$:此算子从向量构建对角矩阵。

- 数学定义:给定向量$\vec{v} = (v_1, \dots, v_K)$,$\text{diag}(\vec{v})$创建一个$K \times K$的对角矩阵,其主对角线上为$v_1, \dots, v_K$。转置$T$表示输入向量在概念上是列向量。

- 物理/逻辑作用:在QKAN中,向量通过对角块编码表示。此操作明确指出,层的输出是对角块编码,这对于其作为后续QKAN层的输入进行递归使用至关重要。

- $N$:输入向量$\vec{x}$的维度。

- 数学定义:一个整数,通常是2的幂,$N=2^n$,其中$n$是用于编码输入的量子比特数。

- 物理/逻辑作用:代表输入特征的数量或经典KAN类比中的“节点”。除以$N$作为求和的归一化因子,确保输出保持在有界范围内,这对于块编码很重要。

- $K$:输出向量$\Phi(\vec{x})$的维度。

- 数学定义:一个整数,通常是2的幂,$K=2^k$,其中$k$是输出编码的量子比特数。

- 物理/逻辑作用:代表输出特征的数量或经典KAN类比中的“节点”。

- $\sum_{p=1}^N$:对输入节点求和。

- 数学定义:此算子对从1到$N$的每个$p$的$\phi_{pq}(x_p)$值进行求和。

- 物理/逻辑作用:这是一个基本的聚合步骤。对于每个输出节点$q$,它将来自所有输入节点$p$的转换信息组合起来。这个求和是Kolmogorov-Arnold表示定理中组合单变量函数的原理的直接翻译。此处选择加法而非乘法是KAN架构固有的,它将函数建模为组合的求和,在输出层提供特征的线性组合。

- $\phi_{pq}(x_p)$:一个单变量激活函数。

- 数学定义:一个将单个实数输入$x_p \in [-1,1]$映射到实数输出的函数。它为每对输入节点$p$和输出节点$q$唯一定义。

- 物理/逻辑作用:这些是网络的“边”,对单个输入分量应用非线性变换。它们是QKAN的核心可训练元素,负责引入非线性和学习复杂关系。

- $x_p$:输入向量$\vec{x}$的第$p$个分量。

- 数学定义:一个实数,$x_p \in [-1,1]$,代表一个单一输入特征。

- 物理/逻辑作用:这是进入QKAN层的原始输入数据点。

- $d$:用于切比雪夫多项式的最大次数。

- 数学定义:一个非负整数。

- 物理/逻辑作用:此参数控制激活函数$\phi_{pq}(x)$的复杂性和表达能力。更高的$d$允许更精细的非线性变换。

- $\frac{1}{d+1} \sum_{r=0}^d$:切比雪夫多项式次数的归一化求和。

- 数学定义:这是$d+1$个切比雪夫多项式的线性组合,由$1/(d+1)$归一化。

- 物理/逻辑作用:它组合了不同的基函数来构建整体激活函数$\phi_{pq}(x)$。归一化有助于将函数输出保持在有界范围内。使用求和(线性组合)允许通过调整系数$w_{pq}^{(r)}$来灵活逼近各种函数。

- $w_{pq}^{(r)}$:一个权重系数。

- 数学定义:一个实数,$w_{pq}^{(r)} \in [-1,1]$。

- 物理/逻辑作用:这些是QKAN的可训练参数。它们决定了每个切比雪夫多项式$T_r(x)$对激活函数$\phi_{pq}(x)$的贡献,有效地塑造了非线性。

- $T_r(x)$:第一类切比雪夫多项式的第$r$项。

- 数学定义:$T_r(x) = \cos(r \arccos(x))$,定义于$x \in [-1,1]$。

- 物理/逻辑作用:这些多项式作为激活函数的基函数。它们被选中是因为它们可以使用量子奇异值变换(QSVT)在量子计算机上高效实现,使其成为量子框架的自然选择。

分步流程

想象一个单一的抽象数据点,例如$x_p$,在QKAN层中穿行,从输入分量转换为最终输出向量的一部分。这个过程就像一个量子装配线:

- 输入块编码:首先,整个$N$维输入向量$\vec{x} = (x_1, \dots, x_N)$以对角块编码$U_x$的形式呈现。这意味着每个$x_p$被编码为一个更大的酉矩阵内的对角元素。这是我们的原材料,进入量子工厂。

- 扩张与复制:然后,输入块编码$U_x$通过附加$k = \log_2 K$个辅助量子比特进行“扩张”。概念上,这一步将每个输入分量$x_p$复制到$K$个不同的“通道”中,每个通道对应一个输出节点$q$。这确保了每个输入都能影响每个输出。

- 切比雪夫多项式变换:对于每个复制的$x_p$以及每个多项式次数$r$从$0$到$d$,应用量子奇异值变换(QSVT)。这有效地计算了所有$p$和$r$的$T_r(x_p)$,仍然以块编码的形式。这就像将原材料送入专门的机器,对它们应用不同的数学函数(切比雪夫多项式)。

- 加权缩放:接下来,每个块编码的$T_r(x_p)$乘以其对应的权重系数$w_{pq}^{(r)}$。这些权重也以对角块编码的形式提供。这种乘法使用量子线性代数子程序进行。此步骤根据学习到的参数缩放变换后的特征,就像调整每个信号的强度。

- 基函数组合(LCU):对于特定的输入-输出对$(p,q)$,所有加权的切比雪夫多项式$w_{pq}^{(r)} T_r(x_p)$(对于$r=0, \dots, d$)被线性组合。这是通过使用“酉线性组合”(Linear Combination of Unitaries, LCU)过程实现的,该过程涉及制备控制量子比特的等量叠加态,并应用加权的块编码。这个机器将各个多项式贡献聚合起来,形成完整的非线性激活函数$\phi_{pq}(x_p)$。

- 输入节点聚合(Hadamard求和):最后,对于每个输出节点$q$,将值$\phi_{pq}(x_p)$(对于$p=1, \dots, N$)相加。这是通过将$\phi_{pq}(x_p)$值块编码与输入量子比特上的Hadamard门进行夹叠来实现的。此操作有效地对每个特定输出节点$q$的所有输入节点贡献进行平均,产生输出向量$\Phi(\vec{x})$的第$q$个分量。然后,输入量子比特被吸收到辅助寄存器中,从而减小了整体维度。

- 输出块编码:这些操作的结果是$K$维输出向量$\Phi(\vec{x})$的对角块编码。这个最终产品随后可以被馈送到另一个QKAN层,或被测量以获得经典输出。

优化动力学

QKAN机制通过调整其可训练参数,即权重系数$w_{pq}^{(r)}$,来最小化预定义的成本函数来学习。这个学习过程涉及几个关键动力学:

-

权重参数化:权重$w_{pq}^{(r)}$不是直接的经典数字,而是被编码到对角块编码$U_{w^{(r)}}$中。本文提出了两种主要的参数化方法:

- 幅度编码:权重可以从参数化量子态$|w(\theta)\rangle = U(\theta)|0\rangle$的实数幅度导出。这里,$U(\theta)$是一个参数化量子电路(PQC),其门角度$\theta$是实际的可训练参数。这种方法自然地对权重施加了$L_2$归一化约束,这起到了正则化的作用。

- Hadamard乘积编码:或者,可以通过Hadamard乘积将参数化酉算子$U(\theta)$与切比雪夫多项式块编码结合起来。这种方法被推测具有更大的表达能力,允许对权重施加$L_\infty$范数约束。

参数化方法的选择决定了可学习函数空间和模型的正则化特性。

-

损失函数与景观:QKAN被设计为一个量子学习模型,这意味着存在一个量化QKAN输出与目标值之间差异的成本函数(例如,用于回归或分类)。“损失景观”是由该成本函数在参数$\theta$空间上定义的曲面。本文没有明确详细说明损失函数,但它通常是提取的输出幅度的函数。基函数(切比雪夫多项式)和参数化方法的选择影响了该景观的平滑度和复杂性。

-

梯度计算:为了导航损失景观并找到其最小值,模型需要计算损失相对于参数$\theta$的梯度。

- 解析梯度:本文建议使用参数偏移规则,这是变分量子算法中常见的技术,用于计算解析梯度。由于QKAN构造的递归和组合性质(涉及QSVT、LCU和块编码乘积),相同的PQC参数$\theta$在电路的不同部分被重复使用。这意味着梯度可以通过对各个子项的贡献求和来获得。然而,这种方法对于单层QKAN的成本为$O(d)$次查询,对于$L$层QKAN则呈指数级增长,成本为$O(d^2L)$,这是一个显著的计算成本。

- 梯度估计:为了规避解析梯度的昂贵成本,作者提出使用梯度估计技术,如有限差分法或同步扰动随机逼近(SPSA)。SPSA特别有吸引力,因为其计算成本在很大程度上与参数数量无关,为估计梯度提供了一种更有效的方式,尤其适用于参数众多的模型。

-

参数更新与收敛:一旦获得梯度(或其估计值),就采用梯度下降或Adam等经典优化算法来迭代更新参数$\theta$。这些优化器沿着减小损失函数的方向调整参数。量子自然梯度方法也可以用于潜在的更快收敛,这涉及到计算量子Fisher信息矩阵。迭代更新持续进行,直到模型收敛到令人满意的损失景观最小值。本文中高斯状态制备的数值示例表明,$L_2$误差随着多项式次数$d$的增加呈指数级下降,表明函数逼近具有良好的收敛行为。然而,层数$L$的查询复杂度的指数级增长意味着QKAN最适合浅层架构,这可能会影响其学习极其复杂、深层函数的能力。

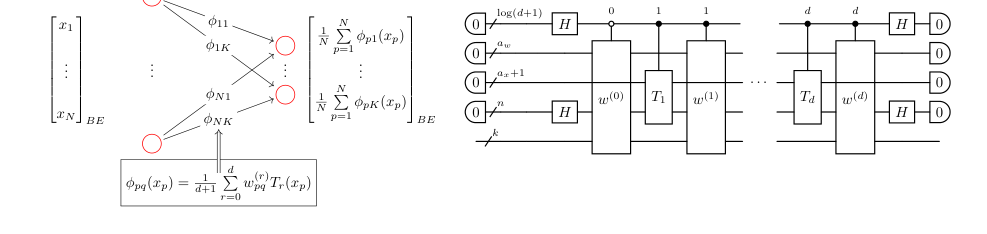

FIG. 1. Construction of a CHEB-QKAN layer with the corresponding quantum circuit. The input to the QKAN model is a diagonal block-encoding of an N-dimensional real vector ⃗x. The CHEB-QKAN layer applies univariate activation functions ϕpq to each input component xp, where p ∈[N] indexes input nodes and q ∈[K] indexes output nodes. The output vector is computed as a sum over activated input nodes. This operation yields a block-encoded real K-dimensional output vector. The quantum circuit implementation requires 1 + log2(d + 1) qubits for the construction and linear combination of weighted Chebyshev polynomials, aw + ax qubits for the block-encodings of input and weights, n = log2 N qubits for input vector encoding, and k = log2 K qubits for output. The circuit consists of a series of multi-controlled block-encodings of Chebyshev polynomials, interspersed with diagonal block- encodings of the corresponding real weights. The entire circuit represents a block-encoding of the K-dimensional vector corresponding to the CHEB-QKAN layer, with auxiliary qubits initialized and measured in the |0⟩state

FIG. 1. Construction of a CHEB-QKAN layer with the corresponding quantum circuit. The input to the QKAN model is a diagonal block-encoding of an N-dimensional real vector ⃗x. The CHEB-QKAN layer applies univariate activation functions ϕpq to each input component xp, where p ∈[N] indexes input nodes and q ∈[K] indexes output nodes. The output vector is computed as a sum over activated input nodes. This operation yields a block-encoded real K-dimensional output vector. The quantum circuit implementation requires 1 + log2(d + 1) qubits for the construction and linear combination of weighted Chebyshev polynomials, aw + ax qubits for the block-encodings of input and weights, n = log2 N qubits for input vector encoding, and k = log2 K qubits for output. The circuit consists of a series of multi-controlled block-encodings of Chebyshev polynomials, interspersed with diagonal block- encodings of the corresponding real weights. The entire circuit represents a block-encoding of the K-dimensional vector corresponding to the CHEB-QKAN layer, with auxiliary qubits initialized and measured in the |0⟩state

结果、局限性与结论

实验设计与基线

为了严格验证量子Kolmogorov-Arnold网络(QKAN)架构,作者专注于一个特定但具有启发性的应用:多变量量子状态制备。实验设计并非旨在与竞争性量子模型进行正面基准测试,而是提供确凿的证据,证明QKAN的核心组合机制(利用量子奇异值变换,QSVT)能够准确地实现复杂的多变量函数。在这种情况下,“受害者”本身就是理想的目标函数——一个D维高斯分布——QKAN旨在以高保真度逼近它。

实验专门针对在$32 \times 32$网格上制备一个2D高斯量子态,对应于每个维度$n=5$个量子比特,选择参数$\beta=6$。这种设置允许清晰地数值说明QKAN的性能。该架构采用了两层QKAN。第一层旨在精确计算每个网格点的函数$x^2 + y^2 - 1$,有效地编码一个偏移的平方半径。第二层然后使用不同次数的切比雪夫多项式应用指数衰减函数$e^{-\beta(x+1)}$的多项式逼近。这种两层结构是QKAN组合原理的直接实例化,其中一层($x^2 + y^2 - 1$的块编码)的输出作为下一层的输入。实验旨在无情地证明,关于QKAN通过QSVT应用非线性变换和组合层的数学声明可以转化为一个具体、准确的量子状态。

证据证明的内容

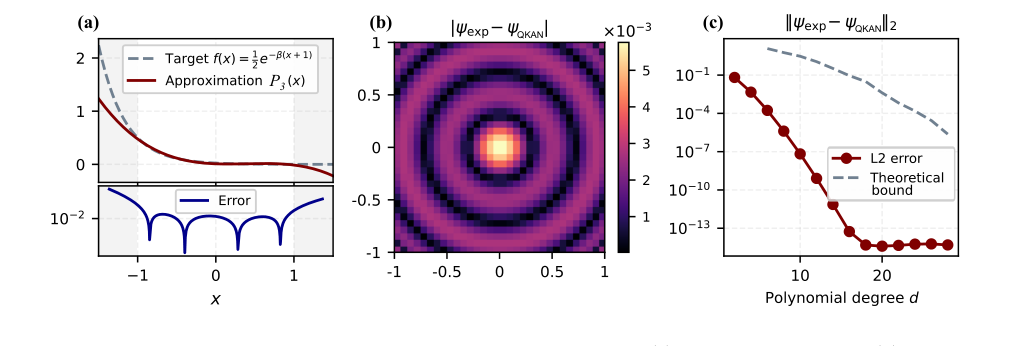

数值示例为QKAN架构在多变量状态制备中的有效性提供了令人信服的证据。关键发现呈现在图10中:

-

多项式逼近精度(图10a): 本文首先展示了在区间$[-1,1]$上用三次切比雪夫多项式$P_3(x)$逼近非线性指数函数$e^{-\beta(x+1)}$的精度。这至关重要,因为这些多项式逼近构成了QKAN内激活函数的基础,通过QSVT实现。图清楚地显示了目标函数与其多项式逼近在指定范围内的紧密拟合,证实了实现这些非线性的可行性。

-

绝对幅度误差(图10b): 使用三次多项式$P_3(x)$制备的归一化2D高斯态在$32 \times 32$网格上的绝对幅度误差$| \psi_{\text{exp}}(i,j) - \psi_{\text{QKAN}}(i,j) |$以热图形式呈现。这张热图提供了如何精确地将QKAN制备的态与理想高斯态匹配的直接、无可辩驳的视觉证据。误差普遍较低,最大的差异出现在分布的中心附近。这与多项式逼近本身的行为一致,在该区域误差最大。这些硬性证据表明,QKAN机制成功地通过其层转换了输入网格点,产生了与期望高斯分布密切对应的幅度。

-

指数误差衰减(图10c): 或许最确凿的证据是$L_2$误差$|| \psi_{\text{exp}} - \psi_{\text{QKAN}} ||_2$作为多项式次数$d$的函数。图显示,随着多项式次数的增加,经验误差呈指数级衰减。这种指数级改进一直持续到误差在$d=20$时饱和到机器精度,约为$10^{-14}-10^{-15}$。这个结果有力地验证了理论界限,并证明了QKAN能够通过增加其激活函数的复杂性来实现高保真度逼近。它无情地证明了使用QSVT通过多项式逼近进行非线性变换的核心机制按预期工作,从而实现了可控和高精度的状态制备。经验误差与理论界限之间的一致性进一步巩固了这些主张。

总之,证据证明QKAN通过其组合块编码结构和QSVT支持的非线性激活,能够准确地制备复杂的多变量量子态,展示了一种用于量子机器学习和状态制备的强大新范式。

局限性与未来方向

尽管QKAN提出了一个有前途的新方向,但本文坦诚地讨论了几项局限性,并为未来的研究开辟了丰富的图景。

当前局限性:

-

继承的KAN局限性: QKAN继承了其经典对应物的一些注意事项。Kolmogorov-Arnold表示定理(KART)保证了两层分解,但经典KAN,以及由此引申的QKAN,不一定继承KART的通用表示性质。这意味着不能保证深层QKAN能够表示任何给定的多变量函数,特别是如果它缺乏适合QKAN设计的组合结构。KAN的全部潜力,即使在经典领域,仍然是一个活跃的研究领域,尤其是在符号回归方面。

-

浅层架构约束: 多层QKAN的一个显著局限性是查询复杂度随层数呈指数级增长。递归的基于QSVT的构造意味着前一层的所有输出块编码都成为下一层的基本构建块,导致电路深度呈指数级开销。这从根本上将QKAN限制为“浅层但宽”的架构,即$L = O(1)$层。虽然当存在高效的块编码时,浅层深度可以通过指数级宽度的层来补偿,但这个约束对于非常深层的学习任务来说是一个实际的障碍。

-

多项式逼近范围: 量子计算机在表示多项式方面表现出色,但并非所有函数都能被多项式有效逼近。这意味着QKAN激活函数基函数的选择至关重要。虽然QSVT功能强大,但它仍然依赖于多项式逼近,这可能不如样条函数等直接逼近任意函数那样强大。逼近符号函数等函数(可能需要用于某些正则化)的精度,当参数接近零时,也可能受到限制。

-

实值限制: 为简单起见,当前工作将讨论范围限制在输入、输出和权重的实数值。虽然推广到复数是可能的,通过将实部和虚部分别处理,但这会增加复杂性,并留待未来工作。

未来方向与讨论主题:

-

增强的参数化与训练策略:

- 超越权重参数化: 本文建议对QKAN的参数化步骤进行扩展,而不仅仅是权重向量。例如,在线性组合酉(LCU)步骤中,可以使用参数化的酉算子作为状态制备对,而不是固定的Hadamard变换。这将允许对不同次数切比雪夫多项式的全局权重进行更精细的控制,从而可能增加表达能力。

- 自适应基函数选择: 目前,切比雪夫多项式是自然的选择,因为QSVT。然而,QSVT框架允许实现任何有界多项式。一个令人着迷的方向是使QSVT的角度本身成为可训练参数。这将允许基函数选择成为学习过程的一部分,可能为特定问题发现最优基集,而不是依赖于固定的选择。

- 迭代模型精化: 一种训练策略可能涉及迭代地向和中添加更高次数的切比雪夫多项式并优化它们的全局权重。通过检查优化后的权重,可以确定所需多项式的数量,例如,如果新添加多项式的权重消失。这可能导致更具可解释性和更高效的模型。

-

探索QKAN用于直接量子输入:

- 量子相位分类: QKAN被提议可能适用于直接量子输入,例如那些经典上难以分析的量子态。例如,在相位分类任务中,如果一个对应于未知量子相位的状态可以被高效地制备,那么QKAN可以以监督方式进行训练以分类该相位。这可能有助于计算状态幅度的多变量函数,并可能有助于在物理系统中发现新的序参量。这是一个引人注目的应用,其中QKAN的量子性质提供了独特的优势。

-

泛化与表达能力:

- 复值QKAN: 将QKAN扩展到处理复数将极大地拓宽其在更广泛的量子问题和数据类型中的适用性。

- 替代基函数: 虽然切比雪夫多项式是高效的,但探索其他可以通过QSVT有效逼近的多项式基函数(例如,B样条、小波、傅里叶展开)可以增强QKAN对不同类型函数的表达能力。本文提到B样条可以通过分离分段并使用LCU来实现,这是一个复杂但可能富有成效的方向。

-

先进的状态制备技术:

- 多变量重要性采样: 本文指出,通过重要性采样实现多变量指数改进的推广仍然是一个开放问题,由于多变量设置中的挑战。克服这一点将显著增强QKAN制备高度复杂、非均匀多变量状态的效用。

-

可解释性与科学发现:

- 经典KAN的可解释性优势,即可以检查和修剪单个激活函数,是一个关键优势。进一步研究这种可解释性如何转化为QKAN,特别是在识别稀疏组合结构或从量子数据中发现新的物理定律方面,是一个迷人的前景。从训练权重分布中采样提供了一条修剪和模型压缩的途径。

这些讨论点表明,QKAN不仅是一个理论构造,而且是一个具有巨大演化潜力的基础框架,特别是在利用量子计算的独特能力来解决经典方法无法解决的问题方面。要充分实现其潜力,需要解决这些局限性并创造性地探索这些未来方向。

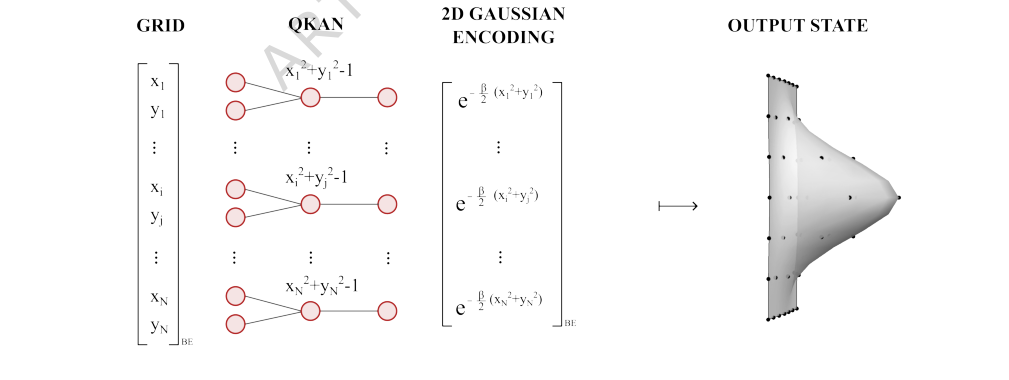

FIG. 4. Example: 2D Gaussian state preparation via QKAN. Starting from a vectorized 2D grid of points {(xi, yi)} encoded as a diagonal block-encoding (left), the first QKAN layer applies Chebyshev polynomial T2 and sums over the two dimensions, computing 1

FIG. 4. Example: 2D Gaussian state preparation via QKAN. Starting from a vectorized 2D grid of points {(xi, yi)} encoded as a diagonal block-encoding (left), the first QKAN layer applies Chebyshev polynomial T2 and sums over the two dimensions, computing 1

FIG. 10. Numerical illustration of Gaussian state preparation via QKAN. (a) Degree-3 polynomial P3(x) approxi- mating 1

FIG. 10. Numerical illustration of Gaussian state preparation via QKAN. (a) Degree-3 polynomial P3(x) approxi- mating 1