QKAN: квантовые сети Колмогорова-Арнольда с приложениями в машинном обучении и многомерной подготовке состояний

Проблема, рассматриваемая в данной статье, — разработка квантовых сетей Колмогорова-Арнольда (QKAN) — возникает на стыке классических нейронных сетей и квантовых вычислений, будучи конкретно вдохновленной недавно...

Предыстория и академическая родословная

Происхождение и академическая родословная

Проблема, рассматриваемая в данной статье, — разработка квантовых сетей Колмогорова-Арнольда (QKAN) — возникает на стыке классических нейронных сетей и квантовых вычислений, будучи конкретно вдохновленной недавно предложенными классическими сетями Колмогорова-Арнольда (KAN) [5]. Исторический контекст начинается с Теоремы Колмогорова-Арнольда о представлении (KART), фундаментального математического результата 1950-х годов [1-4]. KART утверждает, что любая непрерывная многомерная функция (функция с несколькими входными переменными) может быть разложена в композицию и сумму конечного числа одномерных функций (функций только с одной входной переменной). Эта теорема предоставила теоретическую основу для понимания того, как сложные функции могут быть представлены с использованием более простых строительных блоков.

Однако прямое применение KART на практике, особенно для нейронных сетей, было ограничено, поскольку внутренние и внешние функции, которые она гарантирует, могут быть весьма негладкими, что затрудняет их точное и надежное приближение [5]. Эта «болевая точка» означала, что, несмотря на теоретическую мощь, KART не могла быть напрямую переведена в эффективную архитектуру нейронной сети.

Ситуация изменилась с недавним введением классических сетей Колмогорова-Арнольда (KAN) Лю и др. [5]. KAN обобщают композиционную структуру KART, допуская произвольное количество слоев, в отличие от двух слоев, гарантированных KART. Хотя классические KAN не наследуют свойство универсального представления KART, они показали перспективность в конкретных приложениях, особенно в научных областях, предлагая лучшую интерпретируемость и повышенную точность на маломасштабных задачах. Они также потенциально могут помочь в открытии новых физических законов, выявляя модульные структуры в целевых функциях [10].

Авторы данной статьи были мотивированы потенциалом классических KAN и стремились представить их квантовую версию — QKAN. Фундаментальное ограничение предыдущих квантовых подходов, которое побудило авторов написать эту статью, проистекает из природы моделей квантового машинного обучения. Существующие модели квантового обучения, такие как вариационные квантовые алгоритмы (VQA) [34-39], часто полагаются на оптимизацию параметров в квантовых схемах. QKAN, напротив, предлагает другую парадигму: она рассматривает собственные значения блочно-закодированных матриц как «нейроны» и применяет параметризованные функции активации на «ребрах» сети, используя квантовую трансформацию сингулярных значений (QSVT). Этот подход направлен на использование композиционной структуры KAN в квантовом контексте, потенциально предлагая преимущества в эффективности для определенных задач, особенно при наличии эффективных блочных кодировок входов. Однако QKAN также сталкивается со своими ограничениями: рекурсивное составление слоев с использованием QSVT приводит к экспоненциальному увеличению глубины схемы, что означает, что QKAN естественным образом ограничена мелкомасштабными архитектурами.

Интуитивные термины предметной области

-

Теорема Колмогорова-Арнольда о представлении (KART): Представьте, что у вас есть очень сложный рецепт с множеством ингредиентов и шагов. KART — это как математическое доказательство, которое гласит, что, какой бы сложной ни была рецептура, ее всегда можно разбить на серию гораздо более простых мини-рецептов с одним ингредиентом, которые затем комбинируются. Речь идет об упрощении сложности до управляемых частей с одной переменной.

-

Блочное кодирование (Block-encoding): Представьте секретное сообщение (матрицу или вектор), которое вы хотите отправить безопасно. Блочное кодирование похоже на встраивание этого секретного сообщения в гораздо больший, внешне обычный документ (унитарную квантовую операцию). Больший документ выглядит безобидно, но определенная его часть, «блок», содержит ваше секретное сообщение, уменьшенное в масштабе. Квантовые компьютеры могут затем манипулировать этим большим документом, эффективно обрабатывая ваше скрытое сообщение, не «читая» его напрямую.

-

Квантовая трансформация сингулярных значений (Quantum Singular Value Transformation, QSVT): Представьте приложение для редактирования фотографий, где вы хотите применить определенный эффект, например, изменить яркость или контрастность, но только к определенным цветам или узорам на изображении. QSVT — это мощная квантовая техника, действующая как высокоточный цифровой фильтр. Она может применить почти любую желаемую математическую функцию (например, полином) к «силе» или «важности» (сингулярным значениям) информации, закодированной в блочно-закодированной матрице, что позволяет выполнять очень специфичные и сложные преобразования.

-

Многомерная подготовка состояний (Multivariate State Preparation): Представьте, что вы хотите создать уникальный музыкальный аккорд, где громкость каждой ноты точно определяется сложной математической формулой, включающей несколько факторов (например, температуру, влажность и время суток). Многомерная подготовка состояний в квантовых вычислениях заключается в создании квантового состояния (набора кубитов), где «громкость» или «амплитуда» каждого возможного исхода (каждой комбинации битов) устанавливается в соответствии со значением сложной функции с несколькими входными переменными. Это похоже на прямое кодирование сложного ландшафта значений в квантовую область.

Таблица обозначений

| Обозначение | Описание |

|---|---|

Определение проблемы и ограничения

Формулировка основной проблемы и дилемма

В статье представлены квантовые сети Колмогорова-Арнольда (QKAN) как квантовая алгоритмическая структура, вдохновленная классическими сетями Колмогорова-Арнольда (KAN). Основная задача — разработать эффективную квантовую реализацию KAN для приложений в машинном обучении и многомерной подготовке состояний.

Вход/Текущее состояние:

Отправной точкой для QKAN является блочное кодирование $N$-мерного вещественного вектора $\vec{x} \in [-1,1]^N$. Это означает, что компоненты вектора закодированы в диагональных элементах унитарной матрицы $U_x$, такой что $|| \langle 0|_a U_x |0\rangle_a - \text{diag}(x_1, \dots, x_N) || \le \epsilon_x$. Для квантового машинного обучения этот вход может представлять собой амплитуды квантового состояния или диагональные элементы матрицы. Для многомерной подготовки состояний вход обычно представляет собой векторизованную $D$-мерную сетку точек, также представленную в виде диагонального блочного кодирования.

Выход/Целевое состояние:

Желаемый конечный результат зависит от приложения:

* В качестве модели квантового обучения: Цель состоит в том, чтобы получить диагональное блочное кодирование $K$-мерного выходного вектора $\Phi(\vec{x}) \in [-1,1]^K$. Элементы этого выходного вектора, $\Phi(\vec{x})_q = \frac{1}{N} \sum_{p=1}^N \phi_{pq}(x_p)$, где $\phi_{pq}$ — одномерные функции активации, должны быть оценены классически с аддитивной точностью $\delta$.

* В качестве протокола многомерной квантовой подготовки состояний: Задача состоит в подготовке квантового состояния $|\psi\rangle$, амплитуды которого соответствуют многомерной функции от входа, такой как $D$-мерное гауссово распределение на регулярной квадратной сетке. Это достигается путем применения финального блочного кодирования к равномерной суперпозиции и последующего использования амплификационной амплитуды.

Отсутствующее звено/Математический пробел:

Фундаментальный пробел, который данная статья пытается преодолеть, — это эффективный и точный перевод композиционной структуры классических KAN в парадигму квантовых вычислений. Классические KAN разлагают сложные многомерные функции на композиции и суммы одномерных функций. Задача состоит в реализации этих нелинейных одномерных функций и их суммирования с использованием квантовых операций, в частности, с использованием квантовой трансформации сингулярных значений (QSVT) на блочно-закодированных данных, преодолевая при этом присущие квантовые ограничения, такие как унитарность и распространение ошибок. Статья направлена на предоставление конкретной квантовой архитектуры, которая может выполнять эти операции с потенциальным квантовым ускорением.

Дилемма и болезненные компромиссы:

Предыдущие исследователи, пытавшиеся решить аналогичные проблемы в квантовом машинном обучении и подготовке состояний, сталкивались с несколькими болезненными компромиссами:

* Квантовое ускорение против классического считывания: В то время как квантовые алгоритмы могут эффективно обрабатывать экспоненциально большие структуры данных (например, блочные кодировки), классическая экстракция полного вывода может свести на нет любое квантовое преимущество. Для QKAN достижение квантового ускорения зависит от того, останется ли стоимость классической постобработки субэкспоненциальной. Это означает, что выходное измерение $K$ должно быть ограничено $O(\text{polylog}(N))$, поскольку оценка экспоненциального числа значений сама по себе займет экспоненциальное время.

* Мелкие против глубоких архитектур: QKAN разработаны как «широкие и мелкие». Они могут реализовывать экспоненциально широкие слои при полилогарифмической стоимости при наличии эффективных блочных кодировок, что недоступно для классических нейронных сетей. Однако рекурсивная конструкция на основе QSVT для составления нескольких слоев влечет за собой экспоненциальное увеличение глубины схемы. Это вынуждает QKAN быть мелкими, обычно ограниченными $L=O(1)$ слоями, для поддержания вычислительной осуществимости.

* Точность против сложности запросов: Для оценки выхода в модели квантового обучения достижение более высокой точности (меньшего $\delta$) требует большего количества запросов к управляемому диагональному блочному кодированию. В частности, аддитивное приближение $\delta$ требует $O(d^2/\delta)$ запросов. Если требуется мультипликативная ошибка, количество запросов увеличивается до $O(d^2/(\delta|a_q|))$, что означает, что потенциальное квантовое ускорение сохраняется только в том случае, если амплитуда $a_q$ не убывает экспоненциально. Это представляет собой компромисс между желаемой точностью и вычислительными ресурсами (запросами), необходимыми для ее достижения.

Ограничения и режимы отказа

Проблема реализации QKAN чрезвычайно усложняется несколькими суровыми, реалистичными преградами:

- Ограничение унитарности: Квантовая механика требует, чтобы все операции были унитарными. Это накладывает строгое ограничение, согласно которому все элементы вектора (входные, выходные и веса) должны быть ограничены единицей по величине при кодировании в виде блочных кодировок. Это фундаментальное физическое ограничение, требующее тщательной нормализации и масштабирования данных.

- Эффективное блочное кодирование входов: Сложность вентилей QKAN масштабируется линейно со стоимостью построения начального блочного кодирования $N$-мерного входного вектора. Чтобы QKAN предлагали квантовое ускорение, входы должны допускать эффективные блочные кодировки, которые могут быть подготовлены за время $O(\text{polylog}(N))$. Если само кодирование входа требует $O(N)$ вентилей, квантовое преимущество над классическими алгоритмами теряется. Это значительное ограничение, зависящее от данных.

- Рекурсивное распространение ошибок: Несовершенства в блочных кодировках входов и весов накапливаются. В многослойном QKAN эти ошибки рекурсивно распространяются с каждым последующим слоем, приводя к усиленной ошибке в финальном выходном блочном кодировании. Это делает достижение высокой точности для глубоких QKAN чрезвычайно сложным и ограничивает их практическую глубину.

- Экспоненциальная глубина схемы для глубоких архитектур: Рекурсивный характер построения QKAN, где выходное блочное кодирование одного слоя служит входом для следующего, приводит к экспоненциальной зависимости глубины схемы от количества слоев $L$. Это вычислительное ограничение серьезно сводит QKAN к мелкомасштабным архитектурам ($L=O(1)$), несмотря на теоретические преимущества более глубоких сетей.

- Лимиты вспомогательных кубитов: Общее количество вспомогательных кубитов, необходимых для построения QKAN, увеличивается линейно с количеством слоев $L$. Хотя это и не экспоненциальное масштабирование, это все же может быть ограничением аппаратной памяти для текущих и ближайших квантовых устройств.

- Ограничения полиномиальной аппроксимации: QSVT, основной механизм применения нелинейных преобразований, опирается на полиномиальные аппроксимации целевых функций. Не все функции могут быть эффективно аппроксимированы полиномами низкой степени, что ограничивает выразительность и точность QKAN для определенных задач. Например, аппроксимация экспоненциальной функции для гауссовой подготовки состояний требует достаточно высокой степени полинома, что влияет на общую точность.

- Ограничение вещественными числами: Текущая работа явно ограничивает свою область применения вещественными входами, выходами и весами. Обобщение на комплексные числа возможно, но оставлено для будущей работы, что указывает на текущее ограничение применимости модели.

- Стоимость оценки градиента: Обучение QKAN с использованием правил сдвига параметров для получения аналитических градиентов является вычислительно затратным. Стоимость составляет $O(d)$ запросов для однослойного QKAN и $O(d^2L)$ для $L$-слойного QKAN, где $d$ — максимальная степень полиномов Чебышева. Это экспоненциальное масштабирование с количеством слоев делает обучение глубоких QKAN невероятно сложным и ресурсоемким.

Почему такой подход

Неизбежность выбора

Принятие квантовых сетей Колмогорова-Арнольда (QKAN) было не просто выбором, а неотъемлемой необходимостью, обусловленной уникальными требованиями многомерной аппроксимации функций и подготовки состояний в квантовой области. Осознание авторами того, что традиционные «передовые» (SOTA) методы были недостаточны, проистекало из нескольких ключевых наблюдений.

Во-первых, классические сети Колмогорова-Арнольда (KAN) уже продемонстрировали качественные преимущества перед обычными многослойными перцептронами (MLP) с точки зрения интерпретируемости и точности для конкретных задач, особенно в научных приложениях, связанных с символьными функциями. Чтобы перенести эти преимущества на квантовые вычисления, был необходим нативный квантовый подход. Стандартные модели квантового машинного обучения, такие как вариационные квантовые алгоритмы (VQA), использующие параметризованные квантовые схемы, или квантовые версии CNN и Трансформеров, обычно опираются на другие архитектурные принципы, которые не воплощают в себе композиционную структуру KAN.

Критический момент «эврики», вероятно, наступил при рассмотрении вопроса о том, как реализовать нелинейные функции активации, центральные для KAN, в квантовой среде, сохраняя при этом квантовое ускорение. Прямое моделирование классических нелинейностей на квантовых состояниях, как правило, неэффективно. Квантовая трансформация сингулярных значений (QSVT) оказалась единственным жизнеспособным решением, поскольку она предоставляет мощный и универсальный метаалгоритм для применения полиномиальных преобразований к сингулярным значениям блочно-закодированных матриц. Эта возможность точно соответствует тому, что необходимо для реализации одномерных функций активации KAN в квантовом контексте. Без QSVT реализация таких нелинейностей эффективно на квантовых данных (представленных в виде блочных кодировок) была бы невыполнимой или свела бы на нет любое потенциальное квантовое преимущество. В статье прямо указано, что QKAN «рассматривает собственные значения блочно-закодированных матриц как нейроны и применяет параметризованные функции активации на ребрах сети посредством линейных комбинаций полиномов Чебышева или других базисных функций, которые могут быть эффективно реализованы с использованием QSVT», подчеркивая роль QSVT как основного средства реализации.

Сравнительное превосходство

QKAN демонстрирует подавляющие структурные преимущества, которые делают ее качественно превосходящей предыдущие золотые стандарты для определенных классов задач. Наиболее значительное преимущество заключается в ее «широкой и мелкой» архитектуре. В то время как рекурсивное составление слоев QKAN приводит к экспоненциальному увеличению глубины, ограничивая архитектуру мелкими конфигурациями ($L = O(1)$), эта малая глубина удивительно компенсируется возможностью реализации экспоненциально широких слоев при полилогарифмической стоимости, при условии наличия эффективных блочных кодировок входов. Этот режим принципиально недоступен для классических нейронных сетей, которым потребовалось бы время $O(N)$ для обработки $N$-мерного состояния.

Например, QKAN может обрабатывать $N$-мерное квантовое состояние, вычисляя многомерную функцию его амплитуд за время $O(\text{polylog}(N))$, при условии, что целевая функция имеет эффективную полиномиальную аппроксимацию. Это обеспечивает существенное квантовое ускорение по сравнению с классическим временем $O(N)$ для той же операции. Эта эффективность обусловлена опорой QKAN на блочные кодировки и QSVT, которые позволяют эффективно манипулировать экспоненциально большими унитарными операторами.

Кроме того, QKAN наследует преимущества интерпретируемости классических KAN. Возможность инспектировать отдельные функции активации и отбрасывать те, которые похожи на нулевые функции, позволяет потенциально открывать разреженные композиционные структуры и новые физические законы, что является качественным преимуществом, часто отсутствующим в моделях глубокого обучения типа «черный ящик». Универсальность фреймворка QSVT также означает, что QKAN не ограничивается полиномами Чебышева, а может реализовывать широкий спектр базисных функций, предлагая гибкость, адаптированную к различным приложениям. В статье не детализируются преимущества в обработке высокоразмерного шума или сокращении сложности памяти с $O(N^2)$ до $O(N)$, но подход блочного кодирования по своей сути сжимает информацию, а полилогарифмическое масштабирование для широких слоев подразумевает высокоэффективное использование ресурсов для больших входов.

Соответствие ограничениям

Выбранный метод QKAN демонстрирует идеальное «сочетание» с присущими ограничениями квантовых вычислений и определением проблемы.

-

Эффективное кодирование входа: Основное ограничение для квантовых алгоритмов для достижения ускорения — это эффективная подготовка или кодирование входных данных. QKAN идеально соответствует этому, работая с блочными кодировками входных векторов. Сложность вентилей масштабируется линейно со стоимостью построения этих блочных кодировок, которые для изначально квантовых входов (например, амплитуд квантового состояния или блочных кодировок гамильтонианов) могут быть столь же эффективными, как $O(\text{polylog}(N))$. Это гарантирует, что узкое место входа не сводит на нет квантовое преимущество.

-

Унитарность и ограниченные значения: Квантовые вычисления строго требуют унитарности операций. Конструкция QKAN, основанная на QSVT, по своей сути уважает это. Само представление блочного кодирования гарантирует, что векторы кодируются в унитарных матрицах, а элементы этих векторов ограничены единицей по величине, удовлетворяя ограничениям амплитуды квантовых состояний.

-

Требование малой глубины: Рекурсивное построение слоев QKAN с использованием QSVT приводит к экспоненциальному увеличению глубины схемы с каждым дополнительным слоем. Это ограничение естественным образом вынуждает QKAN быть мелкой архитектурой ($L=O(1)$). Вместо того чтобы быть ограничением, это ограничение определяет нишу QKAN как «широкой и мелкой» модели, где экспоненциальная ширина компенсирует ограниченную глубину, приводя свойства решения в соответствие с этим суровым требованием.

-

Операции с вещественными числами: Статья явно ограничивает свое обсуждение вещественными числами для входов, выходов и весов. Конструкция QKAN с полиномами Чебышева и ее фреймворк блочного кодирования хорошо подходят для работы с вещественными функциями, хотя обобщения на комплексные числа отмечены как будущая работа.

Отклонение альтернатив

Статья подразумевает отказ от других популярных подходов к квантовому машинному обучению, подчеркивая уникальные архитектурные и функциональные различия QKAN.

Во-первых, QKAN отличается от «вариационных архитектур» (VQA), которые часто являются эвристическими и полагаются на оптимизацию параметров в параметризованных квантовых схемах. В то время как VQA подходят для квантовых устройств ближайшего будущего, QKAN «вступает в более мощный набор инструментов квантовой линейной алгебры», предполагая фокус на отказоустойчивом квантовом ускорении посредством точных конструкций, а не эвристической оптимизации. Для конкретной задачи эффективной подготовки многомерных квантовых состояний или аппроксимации функций с композиционной структурой подход QKAN на основе QSVT предлагает более прямой и потенциально более надежный путь к квантовому преимуществу.

Во-вторых, композиционная структура QKAN, вдохновленная классическими KAN, принципиально отличается от фиксированных, плотных слоев квантовых MLP или специфических индуктивных смещений квантовых CNN или Трансформеров. Эти альтернативные архитектуры могут не воплощать естественным образом способность KAN представлять функции как композиции и суммы одномерных функций, а также не предлагать тех же преимуществ интерпретируемости. Заявление статьи о том, что QKAN «противоположна предыдущим архитектурам», подчеркивает это различие.

Хотя в статье явно не детализируется, почему, например, квантовые GAN или квантовые диффузионные модели потерпят неудачу, акцент на способности QKAN достигать экспоненциально широких слоев при полилогарифмической стоимости для блочно-закодированных входов и ее интерпретируемости для научных открытий указывает на область проблем, где эти конкретные преимущества имеют первостепенное значение. Другие методы могут не предлагать такое же сочетание квантового ускорения для специфических структур функций, эффективной обработки блочно-закодированных данных и присущей интерпретируемости.

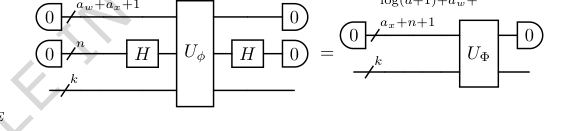

FIG. 9. Step 5. Sum the individual activation functions over N input nodes for each output node, creating the desired diagonal block-encoding UΦ of the K-dimensional output vector Φ(⃗x). This is achieved by sandwiching the block-encoding from Step 4 with two n-qubit Hadamard gates. The dimension reduction occurs as the n qubits originally used for input block-encoding are moved to the auxiliary register

FIG. 9. Step 5. Sum the individual activation functions over N input nodes for each output node, creating the desired diagonal block-encoding UΦ of the K-dimensional output vector Φ(⃗x). This is achieved by sandwiching the block-encoding from Step 4 with two n-qubit Hadamard gates. The dimension reduction occurs as the n qubits originally used for input block-encoding are moved to the auxiliary register

Математический и логический механизм

Основное уравнение

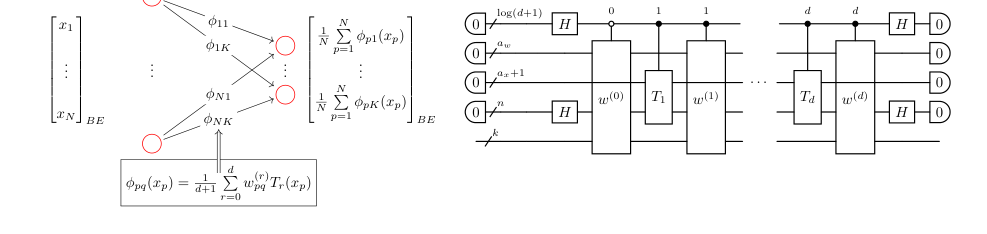

Основной математический механизм слоя квантовой сети Колмогорова-Арнольда (QKAN), в частности варианта CHEB-QKAN, заключается в том, как он преобразует входной вектор $\vec{x}$ в выходной вектор $\Phi(\vec{x})$. Это преобразование выражается как диагональное блочное кодирование $K$-мерного вектора, где каждый компонент является суммой одномерных функций активации. Сами функции активации определяются как линейные комбинации полиномов Чебышева.

Выход одного слоя QKAN задается формулой:

$$ \Phi(\vec{x}) = \text{diag}\left( \frac{1}{N} \sum_{p=1}^N \phi_{p1}(x_p), \dots, \frac{1}{N} \sum_{p=1}^N \phi_{pK}(x_p) \right)^T $$

Здесь каждая одномерная функция активации $\phi_{pq}(x)$ определяется как линейная комбинация полиномов Чебышева первого рода:

$$ \phi_{pq}(x) = \frac{1}{d+1} \sum_{r=0}^d w_{pq}^{(r)} T_r(x) $$

Покомпонентный разбор

Давайте разберем эти уравнения, чтобы понять роль и математическое определение каждого компонента:

- $\Phi(\vec{x})$: Это представляет выход одного слоя QKAN.

- Математическое определение: Это $K$-мерный вектор, элементы которого являются агрегированными и преобразованными входными признаками. В квантовом контексте он блочно-кодируется как диагональная матрица, что означает, что его компоненты появляются на диагонали большего унитарного оператора.

- Физическая/логическая роль: Это «обработанная информация», которую производит слой QKAN. Он служит активированными признаками, аналогично выходу слоя в классической нейронной сети, но в квантово-совместимом формате.

- $\text{diag}(\dots)^T$: Этот оператор строит диагональную матрицу из вектора.

- Математическое определение: Для данного вектора $\vec{v} = (v_1, \dots, v_K)$, $\text{diag}(\vec{v})$ создает диагональную матрицу $K \times K$ с $v_1, \dots, v_K$ на главной диагонали. Транспонирование $T$ указывает на то, что входной вектор концептуально является столбцовым вектором.

- Физическая/логическая роль: В QKAN векторы представляются в виде диагональных блочных кодировок. Эта операция явно указывает на то, что выход слоя является диагональной блочной кодировкой, что критически важно для ее рекурсивного использования в качестве входа для последующих слоев QKAN.

- $N$: Размерность входного вектора $\vec{x}$.

- Математическое определение: Целое число, обычно степень двойки, $N=2^n$, где $n$ — количество кубитов, используемых для кодирования входа.

- Физическая/логическая роль: Представляет количество входных признаков или «узлов» в аналогии с классической KAN. Деление на $N$ действует как нормализующий множитель для суммирования, гарантируя, что выход остается в пределах ограниченного диапазона, что важно для блочных кодировок.

- $K$: Размерность выходного вектора $\Phi(\vec{x})$.

- Математическое определение: Целое число, обычно степень двойки, $K=2^k$, где $k$ — количество кубитов для выходного кодирования.

- Физическая/логическая роль: Представляет количество выходных признаков или «узлов» в аналогии с классической KAN.

- $\sum_{p=1}^N$: Суммирование по входным узлам.

- Математическое определение: Этот оператор суммирует значения $\phi_{pq}(x_p)$ для каждого $p$ от $1$ до $N$.

- Физическая/логическая роль: Это фундаментальный шаг агрегации. Для каждого выходного узла $q$ он объединяет преобразованную информацию от всех входных узлов $p$. Это суммирование является прямым переводом принципа теоремы Колмогорова-Арнольда о комбинировании одномерных функций. Выбор сложения вместо умножения присущ архитектуре KAN, которая моделирует функции как суммы композиций, обеспечивая линейную комбинацию признаков на выходном слое.

- $\phi_{pq}(x_p)$: Одномерная функция активации.

- Математическое определение: Функция, которая принимает один вещественный вход $x_p \in [-1,1]$ и отображает его в вещественный выход. Она однозначно определяется для каждой пары входного узла $p$ и выходного узла $q$.

- Физическая/логическая роль: Это «ребра» сети, применяющие нелинейные преобразования к отдельным входным компонентам. Это основные обучаемые элементы QKAN, ответственные за введение нелинейности и изучение сложных зависимостей.

- $x_p$: $p$-я компонента входного вектора $\vec{x}$.

- Математическое определение: Вещественное число, $x_p \in [-1,1]$, представляющее один входной признак.

- Физическая/логическая роль: Это необработанная входная точка данных, которая поступает в слой QKAN.

- $d$: Максимальная степень используемых полиномов Чебышева.

- Математическое определение: Неотрицательное целое число.

- Физическая/логическая роль: Этот параметр контролирует сложность и выразительность функций активации $\phi_{pq}(x)$. Более высокое $d$ позволяет использовать более сложные нелинейные преобразования.

- $\frac{1}{d+1} \sum_{r=0}^d$: Нормализованная сумма по степеням полиномов Чебышева.

- Математическое определение: Это линейная комбинация $d+1$ полиномов Чебышева, нормализованная на $1/(d+1)$.

- Физическая/логическая роль: Это объединяет различные базисные функции для построения общей функции активации $\phi_{pq}(x)$. Нормализация помогает сохранять выход функции в ограниченном диапазоне. Использование суммирования (линейной комбинации) позволяет гибко аппроксимировать широкий спектр функций путем корректировки коэффициентов $w_{pq}^{(r)}$.

- $w_{pq}^{(r)}$: Весовой коэффициент.

- Математическое определение: Вещественное число, $w_{pq}^{(r)} \in [-1,1]$.

- Физическая/логическая роль: Это обучаемые параметры QKAN. Они определяют вклад каждого полинома Чебышева $T_r(x)$ в функцию активации $\phi_{pq}(x)$, фактически формируя нелинейность.

- $T_r(x)$: $r$-й полином Чебышева первого рода.

- Математическое определение: $T_r(x) = \cos(r \arccos(x))$, определенный для $x \in [-1,1]$.

- Физическая/логическая роль: Эти полиномы служат базисными функциями для функций активации. Они выбраны потому, что их можно эффективно реализовать на квантовом компьютере с использованием квантовой трансформации сингулярных значений (QSVT), что делает их естественным выбором для квантовой структуры.

Пошаговый поток

Представьте себе одну абстрактную точку данных, скажем $x_p$, когда она проходит через слой QKAN, преобразуясь из входного компонента в часть финального выходного вектора. Этот процесс подобен квантовой сборочной линии:

- Блочное кодирование входа: Сначала весь $N$-мерный входной вектор $\vec{x} = (x_1, \dots, x_N)$ представляется в виде диагонального блочного кодирования $U_x$. Это означает, что каждый $x_p$ кодируется как диагональный элемент внутри большей унитарной матрицы. Это наше сырье, поступающее на квантовую фабрику.

- Масштабирование и репликация: Затем входное блочное кодирование $U_x$ «масштабируется» путем добавления $k = \log_2 K$ вспомогательных кубитов. Концептуально этот шаг реплицирует каждый входной компонент $x_p$ по $K$ различным «каналам», по одному для каждого выходного узла $q$. Это гарантирует, что каждый вход может влиять на каждый выход.

- Преобразование полиномами Чебышева: Для каждого реплицированного $x_p$ и для каждой степени полинома $r$ от $0$ до $d$ применяется квантовая трансформация сингулярных значений (QSVT). Это фактически вычисляет $T_r(x_p)$ для всех $p$ и $r$, все еще в блочно-кодированной форме. Это похоже на отправку сырья через специализированные машины, которые применяют к нему различные математические функции (полиномы Чебышева).

- Взвешенное масштабирование: Далее, каждый блочно-кодированный $T_r(x_p)$ умножается на соответствующий весовой коэффициент $w_{pq}^{(r)}$. Эти веса также предоставляются в виде диагональных блочных кодировок. Это умножение выполняется с использованием подпрограмм квантовой линейной алгебры. Этот шаг масштабирует преобразованные признаки в соответствии с изученными параметрами, подобно регулировке интенсивности каждого сигнала.

- Комбинация базисных функций (LCU): Для конкретной пары вход-выход $(p,q)$ все взвешенные полиномы Чебышева $w_{pq}^{(r)} T_r(x_p)$ (для $r=0, \dots, d$) линейно комбинируются. Это достигается с использованием процедуры линейной комбинации унитарных операторов (LCU), которая включает подготовку равной суперпозиции управляющих кубитов и применение взвешенных блочных кодировок. Эта машина агрегирует индивидуальные вклады полиномов для формирования полной нелинейной функции активации $\phi_{pq}(x_p)$.

- Агрегация входных узлов (Суммирование Адамара): Наконец, для каждого выходного узла $q$ значения $\phi_{pq}(x_p)$ (для $p=1, \dots, N$) суммируются. Это делается путем «сэндвичирования» блочного кодирования значений $\phi_{pq}(x_p)$ вентилями Адамара на «входных» кубитах. Эта операция фактически усредняет вклады от всех входных узлов для каждого конкретного выходного узла $q$, производя $q$-ю компоненту выходного вектора $\Phi(\vec{x})$. Затем входные кубиты поглощаются вспомогательным регистром, уменьшая общую размерность.

- Блочное кодирование выхода: Результатом этих операций является диагональное блочное кодирование $K$-мерного выходного вектора $\Phi(\vec{x})$. Этот финальный продукт затем готов для подачи в другой слой QKAN или для измерения для получения классического вывода.

Динамика оптимизации

Механизм QKAN обучается путем корректировки своих обучаемых параметров, весовых коэффициентов $w_{pq}^{(r)}$, для минимизации предопределенной функции потерь. Этот процесс обучения включает несколько ключевых динамик:

-

Параметризация весов: Веса $w_{pq}^{(r)}$ являются не просто классическими числами, а кодируются в диагональные блочные кодировки $U_{w^{(r)}}$. Статья предлагает два основных метода для этой параметризации:

- Амплитудное кодирование: Веса могут быть получены из вещественных амплитуд параметризованного квантового состояния $|w(\theta)\rangle = U(\theta)|0\rangle$. Здесь $U(\theta)$ — параметризованная квантовая схема (PQC), углы вентилей которой $\theta$ являются фактическими обучаемыми параметрами. Этот метод естественным образом накладывает ограничение $L_2$-нормы на веса, что действует как форма регуляризации.

- Кодирование через произведение Адамара: Альтернативно, параметризованный унитарный оператор $U(\theta)$ может быть объединен с блочными кодировками полиномов Чебышева через произведение Адамара. Предполагается, что этот подход обеспечивает большую выразительность, позволяя наложить ограничение $L_\infty$-нормы на веса.

Выбор метода параметризации формирует пространство обучаемых функций и свойства регуляризации модели.

-

Функция потерь и ландшафт: QKAN разработана как модель квантового обучения, что подразумевает наличие функции потерь, которая количественно определяет расхождение между выходом QKAN и целевыми значениями (например, для регрессии или классификации). «Ландшафт потерь» — это поверхность, определяемая этой функцией потерь в пространстве параметров $\theta$. Статья не детализирует функцию потерь, но обычно она будет функцией извлеченных выходных амплитуд. Выбор базисных функций (полиномов Чебышева) и метода параметризации влияют на гладкость и сложность этого ландшафта.

-

Вычисление градиента: Для навигации по ландшафту потерь и поиска его минимума модели необходимо вычислять градиенты потерь по отношению к параметрам $\theta$.

- Аналитические градиенты: Статья предлагает использовать правила сдвига параметров, технику, распространенную в вариационных квантовых алгоритмах, для вычисления аналитических градиентов. Из-за рекурсивной и композиционной природы построения QKAN (включая QSVT, LCU и произведения блочных кодировок) одни и те же параметры PQC $\theta$ повторно используются в различных частях схемы. Это означает, что градиент может быть получен путем суммирования вкладов от отдельных подтерм. Однако этот подход масштабируется как $O(d)$ запросов для однослойного QKAN и экспоненциально, $O(d^2L)$, для $L$-слойного QKAN, что является значительной вычислительной стоимостью.

- Оценка градиента: Чтобы обойти высокую стоимость аналитических градиентов, авторы предлагают использовать методы оценки градиента, такие как методы конечных разностей или стохастической аппроксимации с одновременной пертурбацией (SPSA). SPSA особенно привлекателен, поскольку его вычислительная стоимость в значительной степени не зависит от количества параметров, предлагая более эффективный способ оценки градиентов, особенно для моделей с большим количеством обучаемых параметров.

-

Обновление параметров и сходимость: После получения градиентов (или их оценок) классические алгоритмы оптимизации, такие как градиентный спуск или Adam, используются для итеративного обновления параметров $\theta$. Эти оптимизаторы корректируют параметры в направлении, которое уменьшает функцию потерь. Квантовые методы естественного градиента также могут быть использованы для потенциально более быстрой сходимости, что включает вычисление матрицы квантовой информации Фишера. Итеративные обновления продолжаются до тех пор, пока модель не сойдется к удовлетворительному минимуму в ландшафте потерь. Численная иллюстрация подготовки гауссова состояния в статье демонстрирует, что ошибка $L_2$ экспоненциально убывает с увеличением степени полинома $d$, указывая на хорошее поведение сходимости при аппроксимации функций. Однако экспоненциальное масштабирование сложности запросов с количеством слоев $L$ означает, что QKAN лучше всего подходит для мелких архитектур, что может повлиять на ее способность изучать чрезвычайно сложные, глубокие функции.

FIG. 1. Construction of a CHEB-QKAN layer with the corresponding quantum circuit. The input to the QKAN model is a diagonal block-encoding of an N-dimensional real vector ⃗x. The CHEB-QKAN layer applies univariate activation functions ϕpq to each input component xp, where p ∈[N] indexes input nodes and q ∈[K] indexes output nodes. The output vector is computed as a sum over activated input nodes. This operation yields a block-encoded real K-dimensional output vector. The quantum circuit implementation requires 1 + log2(d + 1) qubits for the construction and linear combination of weighted Chebyshev polynomials, aw + ax qubits for the block-encodings of input and weights, n = log2 N qubits for input vector encoding, and k = log2 K qubits for output. The circuit consists of a series of multi-controlled block-encodings of Chebyshev polynomials, interspersed with diagonal block- encodings of the corresponding real weights. The entire circuit represents a block-encoding of the K-dimensional vector corresponding to the CHEB-QKAN layer, with auxiliary qubits initialized and measured in the |0⟩state

FIG. 1. Construction of a CHEB-QKAN layer with the corresponding quantum circuit. The input to the QKAN model is a diagonal block-encoding of an N-dimensional real vector ⃗x. The CHEB-QKAN layer applies univariate activation functions ϕpq to each input component xp, where p ∈[N] indexes input nodes and q ∈[K] indexes output nodes. The output vector is computed as a sum over activated input nodes. This operation yields a block-encoded real K-dimensional output vector. The quantum circuit implementation requires 1 + log2(d + 1) qubits for the construction and linear combination of weighted Chebyshev polynomials, aw + ax qubits for the block-encodings of input and weights, n = log2 N qubits for input vector encoding, and k = log2 K qubits for output. The circuit consists of a series of multi-controlled block-encodings of Chebyshev polynomials, interspersed with diagonal block- encodings of the corresponding real weights. The entire circuit represents a block-encoding of the K-dimensional vector corresponding to the CHEB-QKAN layer, with auxiliary qubits initialized and measured in the |0⟩state

Результаты, ограничения и заключение

Экспериментальный дизайн и базовые линии

Для строгой проверки архитектуры квантовой сети Колмогорова-Арнольда (QKAN) авторы сосредоточились на конкретном, но показательном приложении: многомерной квантовой подготовке состояний. Экспериментальный дизайн не был направлен на победу над конкурирующими квантовыми моделями в прямом сравнении, а скорее на предоставление убедительных доказательств того, что основной композиционный механизм QKAN, использующий квантовую трансформацию сингулярных значений (QSVT), может точно реализовывать сложные многомерные функции. «Жертвой» в данном контексте была сама идеальная целевая функция — $D$-мерное гауссово распределение, которое QKAN стремилась аппроксимировать с высокой точностью.

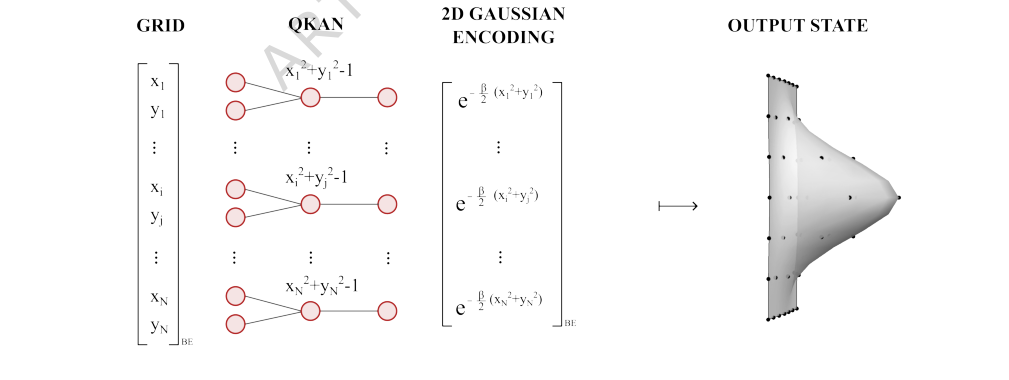

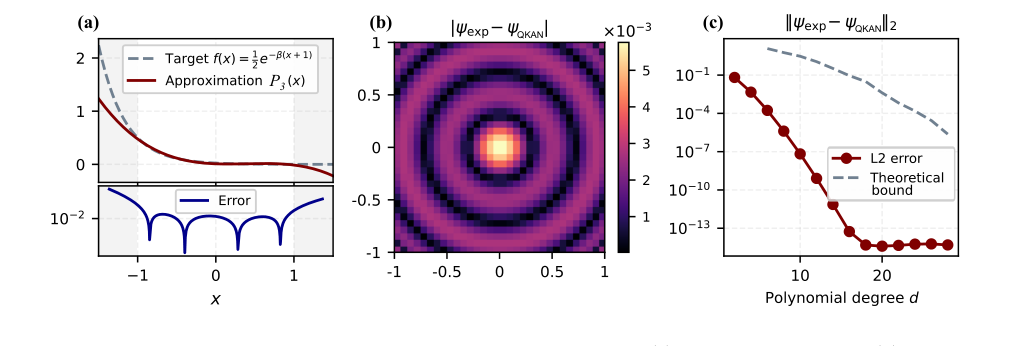

Эксперимент был специально сосредоточен на подготовке 2D гауссова квантового состояния на сетке $32 \times 32$, что соответствует $n=5$ кубитам на измерение, с выбранным параметром $\beta=6$. Эта установка позволила получить четкую численную иллюстрацию производительности QKAN. Архитектура использовала двухслойную QKAN. Первый слой был разработан для точного вычисления функции $x^2 + y^2 - 1$ для каждой точки сетки, эффективно кодируя смещенный квадрат радиуса. Второй слой затем применял полиномиальную аппроксимацию экспоненциальной функции затухания $e^{-\beta(x+1)}$ с использованием полиномов Чебышева различной степени. Эта двухслойная структура была прямым воплощением принципа композиции QKAN, где выход одного слоя (блочное кодирование $x^2 + y^2 - 1$) служил входом для следующего. Эксперимент был разработан для безжалостного доказательства того, что математические утверждения относительно способности QKAN применять нелинейные преобразования через QSVT и составлять слои могут быть переведены в ощутимое, точное квантовое состояние.

Что доказывают свидетельства

Численная иллюстрация предоставляет убедительные доказательства эффективности архитектуры QKAN в многомерной подготовке состояний. Ключевые выводы представлены на Рисунке 10:

-

Точность полиномиальной аппроксимации (Рисунок 10a): Статья сначала демонстрирует точность аппроксимации нелинейной экспоненциальной функции $e^{-\beta(x+1)}$ полиномом Чебышева третьей степени $P_3(x)$ на интервале $[-1,1]$. Это крайне важно, поскольку эти полиномиальные аппроксимации составляют основу функций активации в QKAN, реализуемых через QSVT. График четко показывает близкое соответствие между целевой функцией и ее полиномиальной аппроксимацией в указанном диапазоне, подтверждая осуществимость реализации этих нелинейностей.

-

Абсолютная ошибка амплитуды (Рисунок 10b): Абсолютная ошибка амплитуды, $| \psi_{\text{exp}}(i,j) - \psi_{\text{QKAN}}(i,j) |$, по сетке $32 \times 32$ для нормализованного 2D гауссова состояния, подготовленного с использованием полинома третьей степени $P_3(x)$, представлена визуально. Эта тепловая карта предоставляет прямое, неоспоримое визуальное доказательство того, насколько хорошо подготовленное QKAN состояние соответствует идеальному гауссову состоянию. Ошибка в целом низкая, причем наибольшие расхождения наблюдаются в центре распределения. Это соответствует поведению самой полиномиальной аппроксимации, где ошибки были максимальны в этой области. Эти неопровержимые доказательства показывают, что механизм QKAN успешно преобразует входные точки сетки через свои слои для получения амплитуд, тесно соответствующих желаемому гауссову распределению.

-

Экспоненциальное затухание ошибки (Рисунок 10c): Возможно, наиболее убедительным доказательством является ошибка $L_2$, $|| \psi_{\text{exp}} - \psi_{\text{QKAN}} ||_2$, как функция степени полинома $d$. График показывает экспоненциальное затухание эмпирической ошибки по мере увеличения степени полинома. Это экспоненциальное улучшение продолжается до тех пор, пока ошибка не насытится на уровне машинной точности, около $10^{-14}-10^{-15}$, при $d=20$. Этот результат является мощным подтверждением теоретических границ и способности QKAN достигать высокоточных аппроксимаций путем увеличения сложности своих функций активации. Он безжалостно доказывает, что основной механизм использования полиномиальных аппроксимаций через QSVT для нелинейных преобразований работает как задумано, позволяя осуществлять контролируемую и высокоточную подготовку состояний. Соответствие между эмпирической ошибкой и теоретическими границами еще больше укрепляет утверждения.

По сути, доказательства показывают, что QKAN, благодаря своей композиционной блочно-кодированной структуре и активациям, управляемым QSVT, может точно подготавливать сложные многомерные квантовые состояния, демонстрируя мощную новую парадигму для квантового машинного обучения и подготовки состояний.

Ограничения и будущие направления

Хотя QKAN представляет собой многообещающее новое направление, статья откровенно обсуждает несколько ограничений и открывает богатое поле для будущих исследований.

Текущие ограничения:

-

Наследуемые ограничения KAN: QKAN наследует некоторые оговорки от своего классического аналога. Теорема Колмогорова-Арнольда о представлении (KART) гарантирует двухслойное разложение, но классические KAN, и, следовательно, QKAN, не обязательно наследуют свойство универсального представления KART. Это означает, что нет гарантии, что глубокая QKAN может представлять любую заданную многомерную функцию, особенно если ей не хватает композиционной структуры, подходящей для дизайна QKAN. Полный потенциал KAN, даже классических, по-прежнему является активной областью исследований, особенно для символьной регрессии.

-

Ограничение мелкой архитектуры: Значительным ограничением для многослойных QKAN является экспоненциальное масштабирование сложности запросов с количеством слоев. Рекурсивная конструкция на основе QSVT означает, что каждое выходное блочное кодирование из предыдущего слоя становится элементарным строительным блоком для следующего, что приводит к экспоненциальному увеличению глубины схемы. Это фундаментально ограничивает QKAN «мелкой, хотя и широкой» архитектурой, означающей $L = O(1)$ слоев. Хотя малая глубина может быть компенсирована экспоненциально широкими слоями при наличии эффективных блочных кодировок, это ограничение является практическим препятствием для очень глубоких задач обучения.

-

Область применения полиномиальной аппроксимации: Квантовые компьютеры преуспевают в представлении полиномов, но не все функции могут быть эффективно аппроксимированы полиномами. Это означает, что выбор базисных функций для функций активации QKAN имеет решающее значение. Хотя QSVT универсален, он по-прежнему опирается на полиномиальные аппроксимации, которые могут быть менее мощными, чем, например, сплайны, для прямой аппроксимации произвольных функций. Точность аппроксимации таких функций, как функция знака, которая может потребоваться для некоторой регуляризации, также может быть ограничена, когда параметры близки к нулю.

-

Ограничение вещественными числами: Для простоты текущая работа ограничивает обсуждение вещественными числами для входов, выходов и весов. Обобщение на комплексные числа, хотя и возможно путем раздельной обработки вещественной и мнимой частей, добавляет сложности и оставлено для будущей работы.

Будущие направления и темы для обсуждения:

-

Улучшенные стратегии параметризации и обучения:

- Параметризация за пределами весов: Статья предлагает параметризовать другие этапы QKAN, помимо весовых векторов. Например, в этапе линейной комбинации унитарных операторов (LCU), вместо фиксированных преобразований Адамара, можно параметризовать унитарные операторы, используемые в качестве пар подготовки состояний. Это позволило бы более тонко контролировать глобальные веса полиномов Чебышева различных степеней, потенциально увеличивая выразительность.

- Адаптивный выбор базисных функций: В настоящее время полиномы Чебышева являются естественным выбором из-за QSVT. Однако фреймворк QSVT позволяет реализовывать любой ограниченный полином. Увлекательным направлением было бы сделать сами углы QSVT обучаемыми параметрами. Это позволило бы выбирать базисные функции как часть процесса обучения, потенциально открывая оптимальные наборы базисных функций для конкретных задач, а не полагаясь на фиксированный выбор.

- Итеративное уточнение модели: Стратегия обучения может включать итеративное добавление полиномов Чебышева более высокой степени к сумме и оптимизацию их глобальных весов. Анализируя оптимизированные веса, можно определить оптимальное количество необходимых полиномов, например, если вес вновь добавленного полинома становится нулевым. Это может привести к более интерпретируемым и эффективным моделям.

-

Исследование QKAN для прямых квантовых входов:

- Классификация квантовых фаз: QKAN предлагается как потенциально подходящая для прямых квантовых входов, таких как квантовые состояния, анализ которых классически неразрешим. Например, в задачах классификации фаз, если состояние, соответствующее неизвестной квантовой фазе, может быть эффективно подготовлено, QKAN может быть обучена под наблюдением для классификации фазы. Это может привести к вычислению многомерных функций амплитуд состояния и потенциально помочь в открытии новых порядковых параметров в физических системах. Это убедительное применение, где квантовая природа QKAN предлагает явное преимущество.

-

Обобщение и выразительность:

- QKAN с комплексными числами: Расширение QKAN для работы с комплексными числами значительно расширит ее применимость к более широкому спектру квантовых задач и типов данных.

- Альтернативные базисные функции: Хотя полиномы Чебышева эффективны, исследование других базисных функций (например, B-сплайнов, вейвлетов, рядов Фурье), которые могут быть эффективно аппроксимированы полиномами через QSVT, может повысить выразительность QKAN для различных типов функций. В статье упоминается, что B-сплайны могут быть реализованы путем разделения кусочно-постоянных участков и использования LCU, что является сложным, но потенциально плодотворным направлением.

-

Продвинутые методы подготовки состояний:

- Многомерная важностная выборка: В статье отмечается, что достижение многомерной версии экспоненциального улучшения посредством важностной выборки, предложенной Раттевым и Ребентростом [59], остается открытой проблемой из-за сложностей в многомерном случае. Преодоление этого значительно повысит полезность QKAN для подготовки высокосложных, неравномерных многомерных состояний.

-

Интерпретируемость и научные открытия:

- Преимущество интерпретируемости классических KAN, где отдельные функции активации могут быть проинспектированы и отброшены, является ключевым преимуществом. Дальнейшие исследования того, как эта интерпретируемость переносится на QKAN, особенно в выявлении разреженных композиционных структур или открытии новых физических законов из квантовых данных, представляют собой захватывающую перспективу. Возможность выборки из обусловленного распределения весов предлагает путь к обрезке и сжатию модели.

Эти пункты обсуждения подчеркивают, что QKAN — это не просто теоретическая конструкция, а основополагающая структура со значительным потенциалом для эволюции, особенно в использовании уникальных возможностей квантовых вычислений для задач, недоступных для классических методов. Путь к полному раскрытию ее потенциала будет включать решение этих ограничений и творческое исследование этих будущих направлений.

FIG. 4. Example: 2D Gaussian state preparation via QKAN. Starting from a vectorized 2D grid of points {(xi, yi)} encoded as a diagonal block-encoding (left), the first QKAN layer applies Chebyshev polynomial T2 and sums over the two dimensions, computing 1

FIG. 4. Example: 2D Gaussian state preparation via QKAN. Starting from a vectorized 2D grid of points {(xi, yi)} encoded as a diagonal block-encoding (left), the first QKAN layer applies Chebyshev polynomial T2 and sums over the two dimensions, computing 1

FIG. 10. Numerical illustration of Gaussian state preparation via QKAN. (a) Degree-3 polynomial P3(x) approxi- mating 1

FIG. 10. Numerical illustration of Gaussian state preparation via QKAN. (a) Degree-3 polynomial P3(x) approxi- mating 1