高速值迭代网络 (Highway Value Iteration Networks)

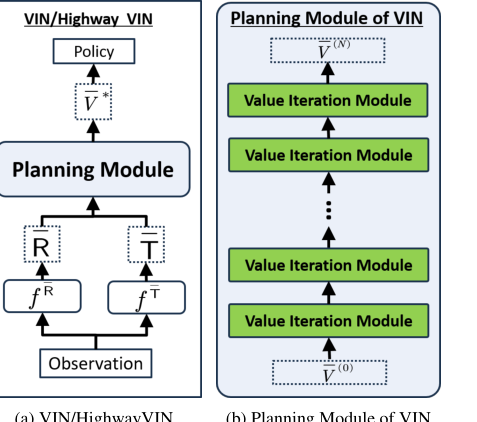

Value iteration networks (VINs) enable end-to-end learning for planning tasks by employing a differentiable "planning module" that approximates the value iteration algorithm.

背景与学术渊源

起源与学术渊源

本研究的核心源于一个长期存在的挑战:如何使人工智能代理能够进行有效的长期规划。这一特定问题最早在 2016 年 Tamar 等人提出的值迭代网络 (Value Iteration Networks, VINs) 中得到突出体现。VINs 的一个重要进步在于,它们将一个“规划模块”直接集成到神经网络 (NN) 架构中,从而实现了规划任务的端到端学习。该规划模块旨在近似经典的值迭代算法,这是 Bellman 于 1966 年正式提出的强化学习 (RL) 中的一个基本概念。

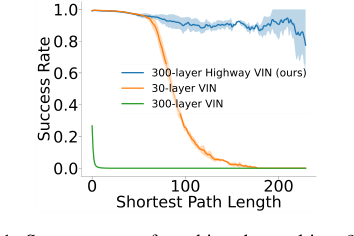

历史上,尽管 VINs 在路径规划和自主导航等各种规划任务中表现出卓越的能力,但它们面临一个关键限制:处理长期规划的能力。随着任务复杂性的增加,需要更多的规划步骤(例如,迷宫中路径长度超过 120),VINs 的成功率急剧下降,常常低于 10%。改进长期规划的一个自然方法是增加 VIN 规划模块的深度,使其能够模拟更多的规划步骤。然而,这立即遇到了深度学习中的一个基本问题:由于梯度消失或爆炸等问题 (Hochreiter, 1991),训练非常深的神经网络本身就非常困难。尽管残差网络和高速网络等技术已成功实现了用于分类任务的非常深的 NN 的训练,但这些方法在应用于 VINs 的独特架构,尤其是在规划场景中时,并未被证明同样有效。这种差异的出现是因为 VINs 融入了来自强化学习的特定归纳偏置,而这种偏置植根于理论上可靠的值迭代算法。因此,作者们被迫开发一种新方法,通过整合来自 NN 和 RL 的先进技术,来有效地训练深度 VINs 以实现长期规划。

直观的领域术语

为了帮助零基础的读者理解概念,这里提供了一些专业术语的日常类比翻译:

- 值迭代网络 (VIN):想象一个智能 GPS,它不仅能告诉你最佳路线,还能通过反复模拟所有可能的未来步骤及其结果来学习如何找到最佳路线,这就像你会在脑海中“迭代”各种选项来找到最有价值的那一个。VIN 就是一个具有这种内置“预想”模块的神经网络。

- 长期信用分配 (Long-term Credit Assignment):想象教一只狗一个涉及许多步骤的复杂技巧。如果狗最终在最后得到了奖励,它很难知道哪些具体的早期行为促成了获得奖励。在人工智能领域,长期信用分配是指弄清楚许多步之前采取的哪些行动真正导致了稍后发生的良好(或糟糕)结果的挑战。

- 梯度消失/爆炸 (Vanishing/Exploding Gradients):想象一个非常长的“传话”游戏。如果信息传递得太轻柔(梯度消失),信息在最后就会丢失。如果信息传递得太响亮(梯度爆炸),信息就会失真成噪音。在深度学习中,梯度就像告诉网络如何调整其内部设置的“反馈”信号。如果这个反馈信号跨越许多层变得太弱或太不稳定,网络就无法有效地学习。

- 跳跃连接 (Skip Connections):想象一条非常长且弯曲的道路。跳跃连接就像添加了直接的捷径或快速通道,可以绕过一些弯曲的部分。这使得信息(或学习的“反馈”信号)能够更容易、更直接地跨越神经网络的许多层进行传输,防止其在途中丢失或被稀释。

符号表

| 符号 | 描述 | 类别 |

|---|---|---|

| $s$ | 环境中的一个特定状态。 | 变量 |

| $a$ | 代理采取的一个动作。 | 变量 |

| $V^\pi(s)$ | 值函数,表示在遵循策略 $\pi$ 时,从状态 $s$ 开始的总未来奖励的期望值。 | 变量 |

| $Q^\pi(s, a)$ | 动作-值函数,表示在状态 $s$ 下采取动作 $a$ 并随后遵循策略 $\pi$ 时,总未来奖励的期望值。 | 变量 |

| $V^{(n)}$ | 值迭代算法第 $n$ 次迭代时的值函数。 | 变量 |

| $\gamma$ | 折扣因子,一个介于 0 和 1 之间的值,决定了未来奖励的重要性。 | 参数 |

| $N$ | 神经网络的总深度(层数)。 | 参数 |

| $N_B$ | 网络架构中“高速块”的数量。 | 参数 |

| $N_p$ | 高速块内并行值探索 (VE) 模块的数量。 | 参数 |

| $\epsilon$ | 探索率,控制训练期间动作选择的随机性。 | 参数 |

问题定义与约束

核心问题表述与困境

本文解决的核心问题是使值迭代网络 (VINs) 能够进行有效长期规划的重大挑战。

输入/当前状态:

当前状态涉及值迭代网络 (VINs),这是一种为规划任务中的端到端学习而设计的神经网络架构。VINs 通过嵌入一个可微分的“规划模块”来实现这一点,该模块近似经典的值迭代算法。这些网络在各种规划场景中表现出相当大的熟练度,例如路径规划和自主导航,尤其是在需要相对有限规划步骤的任务中。

期望终点/目标状态:

期望的目标是开发能够进行鲁棒且准确的长期规划的 VINs。这意味着网络应该能够处理需要数百个规划步骤的任务,例如在具有非常长最短路径的复杂迷宫中导航。至关重要的是,这些高级 VINs 应该能够使用标准的反向传播技术训练到显著的深度(数百层),即使在扩展的规划范围内也能保持高成功率。

缺失环节与数学鸿沟:

确切的缺失环节是现有 VIN 架构无法有效扩展到长期规划所需的深度网络配置。虽然更深的规划模块应该允许更多的规划步骤,从而带来更好的长期性能,但当前的 VIN 在其深度增加时会遇到严重的困难。

图 1 鲜明地说明了这一点:对于最短路径长度超过 120 的情况,30 层 VIN 的成功率急剧下降,而尝试训练 300 层 VIN 则非常困难,导致性能不佳。数学鸿沟在于设计一种 VIN 架构,该架构能够有效地将信息和梯度传播到数百层,从而使嵌入式值迭代过程在多个迭代中收敛到最优值函数,而不会屈服于深度学习固有的挑战。

痛苦的权衡或困境:

困扰先前研究人员的核心困境是规划深度需求与深度神经网络训练的实际限制之间的固有冲突。一方面,VIN 中更深的规划模块在理论上是可取的,因为它允许更多的迭代规划步骤,这对于解决长期规划问题至关重要。另一方面,增加任何神经网络(包括 VINs)的深度通常会带来严重的并发症,例如梯度消失或爆炸。虽然通用深度学习已经开发出(如 ResNets 或 DenseNets 中的跳跃连接)用于训练非常深的分类网络的*技术,但这些技术在 VINs 的规划任务中并未“同样成功”。这种差异表明,VINs 源自强化学习中值迭代算法的独特归纳偏置,使其特别容易受到这些与深度相关的训练问题的影响,从而在用于规划能力的架构深度与实际可训练性之间造成痛苦的权衡。

约束与失效模式

由于存在几个严峻的现实约束和失效模式,实现深度 VINs 的长期规划问题变得极其困难:

-

计算约束:梯度消失/爆炸:最根本的障碍是深度神经网络中众所周知的梯度消失或爆炸问题。正如论文所述,“增加 NN 的深度会带来并发症,例如梯度消失或爆炸,这是深度学习中的一个基本问题。”这使得使用标准反向传播有效地训练具有数百层的 VINs 变得极其困难,因为梯度要么变得太小而无法更新早期层,要么变得太大,导致训练不稳定。

-

架构约束:与标准深度学习解决方案的不兼容性:尽管跳跃连接(例如,在 Highway Networks、ResNets、DenseNets 中)在其他领域(如图像分类)的非常深的网络训练中已被证明是有效的,但它们并未很好地转化为 VINs 的规划任务。这表明在将这些通用深度学习技术应用于 VINs 的规划模块时,存在特定的架构不兼容性或缺乏适当的归纳偏置,而该规划模块植根于强化学习的值迭代。

-

性能失效模式:深度导致的性能下降:VINs 的性能并未得到改善,反而随着深度增加而急剧下降,尤其是在长期规划方面。例如,深度超过 150 层的 VINs 在许多任务上的成功率接近 0%。这是一种关键的失效模式,其中预期的解决方案(增加深度以获得更多规划步骤)会主动恶化结果。

-

信息流约束:贪婪动作选择与梯度通道化:原始 VIN 的值迭代模块“贪婪地选择最大的 Q 值”(公式 4)。这种机制为每一层创建了“独特的信息流,从而将梯度引导到某些特定神经元”。这种多样化信息和梯度流在空间维度上的缺乏,使得网络难以在复杂、高维的长期规划场景中进行鲁棒学习和泛化。

-

探索失效模式:有害的随机性:虽然引入随机性(探索)可以帮助多样化信息流,但不受控制的探索可能适得其反。论文指出,如果没有“过滤器门”来管理探索,“高速 VINs 很容易遭受 VE 模块中探索的不利影响,这可能会阻止收敛。”这表明朴素的提高多样性的尝试会导致不稳定并阻止网络学习最优策略。

-

硬件内存限制:尽管不是问题定义的主要焦点,但非常深的网络在计算上的复杂性对硬件内存施加了实际限制。论文的实验部分(表 4)显示,提出的 Highway VIN 虽然比某些替代方案更有效,但对于 300 层网络仍需要 15.0G 的 GPU 内存,而对于 30 层 VIN 则需要 3.1G。这表明扩展到更深的架构或更大的问题规模将很快触及内存上限,使研究和部署更加昂贵和困难。

Figure 1. Success rates of reaching the goal in a 25 × 25 maze problem. The success rate of a 30-layer VIN con- siderably decreases as the shortest path length increases, and training a 300-layer VIN is difficult and exhibits poor performance

Figure 1. Success rates of reaching the goal in a 25 × 25 maze problem. The success rate of a 30-layer VIN con- siderably decreases as the shortest path length increases, and training a 300-layer VIN is difficult and exhibits poor performance

为什么选择此方法

选择的必然性

高速值迭代网络 (highway VIN) 的采用并非仅仅是一个选择,而是由现有方法在面对长期规划需求时固有的局限性所驱动的必然结果。作者们在观察 VINs 在路径规划任务中的表现时,精确地指出了传统方法的不足之处。具体而言,对于最短路径长度超过 120 的情况,VINs 的成功率骤降至 10% 以下(图 1)。这一急剧下降凸显了一个根本性的缺陷:虽然增加 VIN 嵌入式“规划模块”的深度似乎是整合更多规划步骤从而改进长期规划的逻辑途径,但传统的深度神经网络 (NN) 训练并发症,如梯度消失或爆炸,很快就使这种方法变得不可行。

至关重要的是,论文指出,即使是先进的深度 NN,它们在分类任务中成功解决了这些梯度问题(例如,ResNets、DenseNets 和标准 Highway Networks),在规划任务中也“不 equally successful”(表 1,第 5 节)。这种差异直接源于 VINs 的独特架构及其源自强化学习 (RL) 中值迭代算法的内在归纳偏置。标准的深度 NN 解决方案虽然对通用深度学习有效,但无法提供在 VIN 的规划框架内促进有效长期信用分配所需的特定 RL 相关先验知识。因此,一种既能实现深度架构又能保留/增强 VIN 规划归纳偏置的解决方案是唯一可行的前进道路,这导致了高速值迭代和架构创新(如为该特定问题量身定制的跳跃连接)的整合。

比较优势

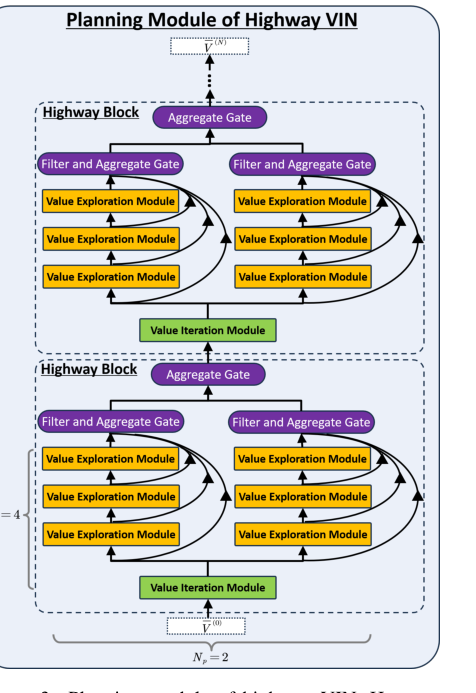

高速 VIN 通过根本性的结构重新设计,解决了深度规划的核心挑战,从而在性能指标上超越了以往的黄金标准。其压倒性的优势源于 VIN 规划模块中嵌入的三项关键创新:

-

聚合门 (Aggregate Gate):该组件构建了跳跃连接,显著改善了跨越许多层的信息流。与标准高速网络中的通用跳跃连接不同,它集成在值迭代的上下文中,使得 VINs 能够训练到数百层而不会遭受梯度消失或爆炸。这种结构优势直接促进了长期规划所需的深度架构。

-

探索模块 (Exploration Module):该模块在训练期间注入受控的随机性,这使得信息和梯度流在空间维度上多样化。这是对传统 VINs 的一项关键改进,传统 VINs 中值迭代模块中的贪婪最大化操作可能导致所选动作的多样性有限,如 VINs 与高速 VINs 的低熵值(表 2)所示。这种多样性对于复杂、高维规划环境中的鲁棒学习至关重要。

-

过滤器门 (Filter Gate):该门旨在“过滤掉”无用的探索路径,确保安全高效的探索。它比较激活值并丢弃那些无助于收敛的激活值,这是一个在与探索模块引入的随机性结合时,对于维持值迭代的理论可靠性至关重要的机制。没有这个,正如消融研究所示(图 7),性能会急剧下降,因为网络会遭受无指导探索的不利影响。

这些组件共同使高速 VINs 能够学习更有效的值函数,以处理远离目标的状态(图 6),这意味着它们在处理长期依赖性和在扩展范围内进行规划方面具有更强的能力,而这是传统 VINs 和其他规划任务中的深度 NN 所严重缺乏的能力。

与约束的对齐

所选的高速 VIN 方法完美地符合长期规划的严苛要求,形成了“问题需求与解决方案独特属性的结合”。

一个主要约束是深度网络对于进行长期规划的必要性,因为更多的规划步骤本质上需要更大的深度。传统 VINs 在此方面失败了,因为在增加深度时会遇到训练困难。Highway VIN 通过实现数百层的有效训练(使用标准反向传播)直接解决了这个问题,这是其前身无法实现的壮举。

另一个关键约束是克服深度 NN 中固有的梯度消失或爆炸问题。聚合门通过引入跳跃连接,直接解决了这个问题,确保了稳定的梯度流。这是对已验证的深度学习技术(如高速网络和 ResNets 中的技术)的直接改编,但专门集成到 VIN 架构中以保留其规划归纳偏置。

此外,该问题要求在 RL 框架内进行有效的长期信用分配。该方法的基础——高速值迭代——正是为此目的而设计的(Wang et al., 2024)。该算法的集成确保了解决方案在理论上是可靠的,并且即使在探索模块的随机性增加的情况下,由于过滤器门(Remark 2),也能收敛到最优值函数。这确保了深度网络不仅是“深”的,而且对于规划来说是有效地深的。

拒绝替代方案

本文为解决此特定问题而拒绝其他流行或最先进的方法提供了清晰的理由:

-

传统 VINs:这些方法被明确证明不足以进行长期规划。当深度超过一定点(例如,对于 25x25 的迷宫为 30 层)时,它们的成功率急剧下降,对于路径长度超过 120 的情况,成功率通常低于 10%(图 1,表 1)。由于梯度问题导致训练非常深的 VINs 的困难,使其不适用于需要数百个规划步骤的任务。

-

标准深度神经网络(例如,Highway Networks、ResNets、DenseNets):尽管这些架构在图像分类等任务中表现出色,能够训练非常深的模型,但它们在规划任务中“不 equally successful”(第 1 页)。作者推测,简单地将它们的跳跃连接集成到 VINs 中并不能引入有益于规划的额外架构归纳偏置*(第 8 页)。这些方法缺乏值迭代的特定 RL 相关归纳偏置,未能将其深度转化为改进的长期规划能力。表 1 清楚地表明,尽管高速网络在比 VINs 更大的深度下保持了性能,但它们的长期规划能力并未随着深度的增加而显著提高,并且它们仍然被高速 VINs 超越。

-

门控路径规划网络 (GPPNs):GPPNs 是一种 VIN 的循环变体,旨在提高深度模型的训练稳定性。尽管它们表现稳健,并在短期规划任务中表现出色(例如,在 25x25 迷宫中 SPL [1,30] 的成功率为 99.09%),但对于长期规划,它们的性能急剧下降,对于 SPLs [130,230] 下降到 3% 以下(表 1,第 8 页)。本文认为这是因为 GPPN 是一个“具有较少规划归纳偏置的黑盒方法”,使其更适合学习短期模式而不是真正的长期规划技能。这突显了提供强大、明确的规划归纳偏置(如高速值迭代所提供的)至关重要。

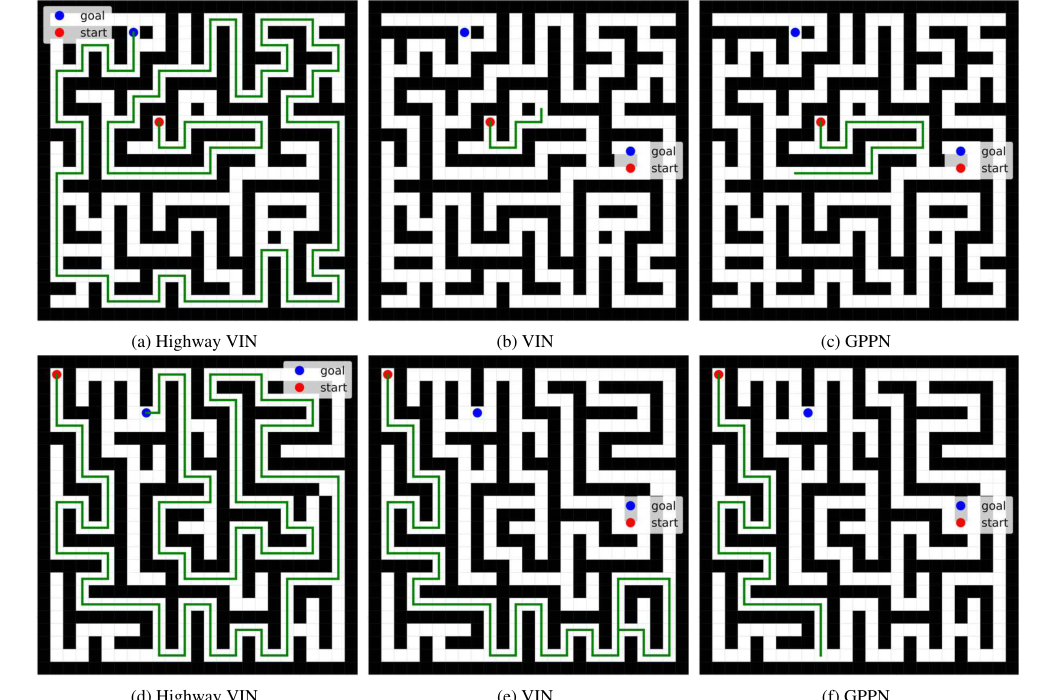

Figure 11. Examples of 2D maze navigation tasks where highway VIN succeeds, but other methods fail

Figure 11. Examples of 2D maze navigation tasks where highway VIN succeeds, but other methods fail

数学与逻辑机制

主方程

高速值迭代网络 (Highway VINs) 的核心在于其“规划模块”,该模块旨在近似高速值迭代 (highway VI) 算法。驱动该算法的核心数学引擎是 $G$ 算子,它定义了值函数如何进行迭代更新。论文指出,高速 VI 算法通过 $V^{(n+1)} = GV^{(n)}$ 迭代更新值函数,其中 $G$ 被形式化定义为:

$$ GV(s) = \max_{\Pi \in \mathbf{\Pi}} \max_{N \in \mathbf{N}} \max_{a \in \mathcal{A}} \max_{x \in \mathcal{X}} \{(B^{\pi})^{\circ(N-1)} BV, BV\} $$

该方程概括了多步引导和策略探索机制,这些机制是高速 VI 的基础,进而也是 Highway VIN 架构的基础。

逐项剖析

让我们剖析这个主方程,以理解每个组件的角色和含义。

-

$GV(s)$:

- 数学定义:这表示在应用高速值迭代算子 $G$ 后,给定状态 $s$ 的更新值函数。

- 物理/逻辑作用:这是从状态 $s$ 可达的最优值的新、改进的估计,它整合了来自多个规划视野和策略的见解。这是 VIN 规划模块中一个“高速块”迭代的输出。

- 为何选择此算子:$G$ 算子是一个复合算子,旨在促进强化学习中有效的长期信用分配,结合了最优和基于策略的值迭代的元素。

-

$V(s)$:

- 数学定义:状态 $s$ 的值函数的当前估计。在迭代更新 $V^{(n+1)} = GV^{(n)}$ 中,这将是 $V^{(n)}(s)$。

- 物理/逻辑作用:这是 $G$ 算子的输入,代表代理当前对每个状态有多好的理解。它是构建下一个、更精炼的值估计的基础。

-

$\max_{\Pi \in \mathbf{\Pi}}$:

- 数学定义:对一组策略进行最大化操作。

- 物理/逻辑作用:这一项允许算法考虑并选择一组预定义的策略 $\mathbf{\Pi}$ 中的最佳“前瞻策略”。它确保规划过程不局限于单一的、固定的策略,而是可以探索不同的策略来找到最有希望的路径。这是 Highway VINs 中“探索模块”的一个关键方面。

- 为何最大化:此处使用最大化来选择不同潜在规划策略中的最乐观结果,这与寻找最优值函数的目标一致。

-

$\mathbf{\Pi}$:

- 数学定义:一组前瞻策略。

- 物理/逻辑作用:这些是代理可以“想象”或“模拟”以探索未来状态和奖励的各种策略。在 Highway VIN 中,这些对应于值探索 (VE) 模块内的嵌入式策略。

-

$\max_{N \in \mathbf{N}}$:

- 数学定义:对一组前瞻深度进行最大化操作。

- 物理/逻辑作用:这允许算法考虑不同的“规划视野”或它应该向前看多少步。这对于长期规划至关重要,因为它使算法能够选择最有利的规划深度。

- 为何最大化:与策略类似,对深度进行最大化有助于选择最有利的规划视野,确保算法能够适应其规划范围。

-

$\mathbf{N}$:

- 数学定义:一组前瞻深度。

- 物理/逻辑作用:这些是规划模块可以模拟到未来的不同步数(或迭代次数)。论文提到 $n$ 作为前瞻深度,因此这里的 $N$ 指的是从集合 $\mathbf{N}$ 中选择的特定深度。

-

$\max_{a \in \mathcal{A}}$:

- 数学定义:对动作集合进行最大化操作。

- 物理/逻辑作用:这一项确保在每个决策点,算法都考虑所有可用的动作,并选择导致最高预期值的动作。这是值迭代的一个基本部分。

- 为何最大化:这是贝尔曼最优性原理的核心,旨在找到最大化未来奖励的最佳可能动作。

-

$\mathcal{A}$:

- 数学定义:代理可以采取的所有可能动作的集合。

- 物理/逻辑作用:这些是代理在其环境中可用的离散选择。

-

$\max_{x \in \mathcal{X}}$:

- 数学定义:对状态或空间位置集合进行最大化操作。

- 物理/逻辑作用:这表明算子考虑了不同空间配置或状态下的最佳可能结果,这在迷宫导航任务中很重要,其中“状态”可能是一个网格单元格。

- 为何最大化:这确保算法对不同的起点或环境的局部变化具有鲁棒性,始终以全局最优路径为目标。

-

$B$:

- 数学定义:贝尔曼最优性算子。对于状态 $s$, $BV(s) = \max_a \sum_{s'} T(s'|s,a) [R(s,a,s') + \gamma V(s')]$。

- 物理/逻辑作用:该算子通过考虑即时奖励和下一状态的折扣值来计算状态的最优值,假设代理总是采取最佳动作。它代表了一个“贪婪”的规划步骤。在 Highway VIN 中,这由标准值迭代 (VI) 模块近似(公式 3 和 4)。

- 为何求和与最大化:求和用于对可能的下一状态(按转移概率加权)进行平均,而最大化则选择最佳动作。

-

$B^\pi$:

- 数学定义:给定策略 $\pi$ 的贝尔曼期望算子。对于状态 $s$, $B^\pi V(s) = \sum_a \pi(a|s) \sum_{s'} T(s'|s,a) [R(s,a,s') + \gamma V(s')]$。

- 物理/逻辑作用:该算子计算在特定策略 $\pi$ 下状态的期望值。它代表了一个“基于策略的探索”步骤。在 Highway VIN 中,这由值探索 (VE) 模块近似(公式 6 和 7),该模块注入随机性。

- 为何求和:求和被使用两次:一次是对动作(按策略概率加权)进行平均,另一次是对可能的下一状态进行平均。

-

$\circ(N-1)$:

- 数学定义:组合算子,应用 $N-1$ 次。对于算子 $O$, $O^{\circ k} = O \circ O \circ \dots \circ O$($k$ 次)。论文在公式 (5) 中使用了 $n-1$,但鉴于 $N$ 被定义为前瞻深度,将其解释为 $N-1$ 次组合更为一致。

- 物理/逻辑作用:这表示多步前瞻。多次应用贝尔曼期望算子意味着模拟策略 $\pi$ 向前 $N-1$ 步。这使得算法能够评估策略的长期后果,而不仅仅是即时下一步。在 Highway VIN 中,这对应于堆叠 $N_b-1$ 个并行 VE 模块。

- 为何组合:组合自然地表示算子的顺序应用,模拟多步规划。

-

$\{\cdot, \cdot\}$:

- 数学定义:包含两个元素的集合。

- 物理/逻辑作用:这表明 $G$ 算子考虑了两个主要的值传播分支:一个涉及多步基于策略的探索 ($(B^{\pi})^{\circ(N-1)} BV$),另一个代表更直接的单步最优更新 ($BV$)。然后外部最大化选择这两个中的更好者。这就是“过滤器门”发挥作用的地方,选择最大值。

- 为何集合与外部最大化:这种结构允许在深度探索路径和更直接的贪婪路径之间进行比较,确保算法同时受益于短期最优性和长期探索。

分步流程

想象一个抽象的数据点,代表状态 $V^{(n)}(s)$ 的值,进入 Highway VIN 的规划模块。该模块像一个复杂的装配线,处理 $V^{(n)}(s)$ 以产生改进的 $V^{(n+1)}(s)$。

-

初始输入:当前值函数估计 $V^{(n)}(s)$ 被输入到规划模块。这个 $V^{(n)}(s)$ 通常是一个特征图,代表了潜在 MDP 中每个空间位置的值。

-

贝尔曼最优性路径(“贪婪”通道):

- 一部分 $V^{(n)}(s)$ 被路由到一个标准的值迭代 (VI) 模块。

- 在该模块内部,卷积操作(如公式 3 所示)通过考虑即时奖励和邻近状态的折扣值来计算动作值 $Q_{a,i,j}^{(n)}$。

- 然后,一个最大池化操作(公式 4)为每个状态 $(i,j)$ 选择所有动作 $a$ 中的最大 $Q_{a,i,j}^{(n)}$,有效地应用贝尔曼最优性算子 $B$。这产生了一个更新的值函数,我们称之为 $V_{VI}^{(n+1)}(s) = BV^{(n)}(s)$。这条路径代表了最直接、最贪婪的更新。

-

贝尔曼期望路径(“探索”通道):

- 同时,$V^{(n)}(s)$ 也被路由到多个并行值探索 (VE) 模块。每个 VE 模块都与一个不同的“前瞻策略”$\pi_{np}$ 相关联,并贡献于一个特定的“前瞻深度”$n_b$。

- 在每个 VE 模块内部:VE 模块不是对动作进行最大化,而是根据其嵌入式策略 $\pi_{np}$(公式 7)计算动作的期望值。该策略可以在训练期间随机生成(公式 8),注入多样性。这有效地应用了贝尔曼期望算子 $B^{\pi_{np}}$。

- 为深度堆叠:这些 VE 模块堆叠了 $N_b - 1$ 层。这意味着一个 VE 模块的输出成为下一个的输入,组合了 $B^{\pi_{np}}$ 算子多次,从而为各种 $n_b$ 和 $np$ 产生 $(B^{\pi_{np}})^{\circ(n_b-1)} BV^{(n)}(s)$。这创建了一系列丰富的探索性值估计,考虑了不同的策略和规划视野。

-

聚合(“信息合并”):

- 来自所有这些并行和堆叠的 VE 模块的输出,以及来自 VI 模块的输出,汇聚在一起。

- 一个“聚合门”(如公式 9 所示)结合了这些多样化的激活。该门使用可学习的 softmax 权重来确定每个并行 VE 模块和每个深度的贡献到最终聚合值。这创建了跳跃连接,允许信息跨越许多层和深度进行传播,从而缓解了梯度消失。

-

过滤(“质量控制”):

- 聚合后,一个“过滤器门”执行最大化操作。该门将聚合值(代表潜在的探索路径)与更直接的、通常是贪婪的值(例如,来自 VI 模块或前一迭代的值的 $V^{(n+1)}$)进行比较。

- 它选择这些值中的最大值,有效地丢弃了不有助于收敛或导致较低值的“无用探索路径”。这确保只有有益的信息被向前传播。

-

输出:整个过程的结果,在聚合和过滤之后,成为新的、精炼的值函数估计 $V^{(n+1)}(s)$(或论文中对于一个高速块的表示法为 $V^{(n+N_b)}(s)$)。这个输出随后被输入到下一个高速块,或用于推导出最终策略。

这种并行处理、基于策略的探索和选择性聚合的复杂组合,使 Highway VIN 能够执行鲁棒的长期规划。

优化动力学

Highway VIN 通过端到端的训练过程进行学习和收敛,主要利用标准反向传播,但具有旨在塑造损失景观和梯度流的特定架构创新。

-

可微分规划模块:整个规划模块,包括值迭代 (VI) 模块、值探索 (VE) 模块、聚合门和过滤器门,都被设计成完全可微分的。这一点至关重要,因为它允许梯度向后流经规划步骤,从而使网络能够学习如何规划。

-

反向传播与梯度流:模型使用标准反向传播进行训练。在输出层计算一个损失函数(例如,基于模仿学习,将预测的策略/值与目标策略/值进行比较)。然后将此损失的梯度反向传播到网络的所有层,包括深度规划模块,以更新模型的参数。

-

解决梯度消失/爆炸问题:Highway VIN 的主要动机是克服非常深的网络中梯度消失/爆炸问题,尤其是在规划任务中。

- 聚合门(跳跃连接):聚合门显式引入了跳跃连接,类似于高速网络和 ResNets。这些连接提供了梯度从后层流向前层的直接路径,绕过了多个非线性变换。这有助于在非常深的架构中保持强大的梯度信号,使得训练数百层成为可能。

- 值探索模块(随机性):VE 模块通过随机生成嵌入式策略(公式 8)在训练期间注入受控的随机性。这使得信息和梯度流在空间维度上多样化。虽然随机性有时会阻碍收敛,但论文指出,这种机制提高了鲁棒性,并且对于高性能至关重要,而不会影响到最优值函数的收敛(Remark 1)。这表明它有助于更有效地探索损失景观,防止模型陷入不良的局部最小值。

-

塑造损失景观(收敛保证):

- 过滤器门(最大化):执行最大化操作的过滤器门被明确声明为“对于确保收敛到 $V^*$ 至关重要”(Remark 2)。通过丢弃“无用的探索路径”(即,低于更直接值的激活值),它修剪了规划过程中的次优分支。这有效地通过引导模型走向导致最优值函数的区域来塑造损失景观,防止因无益的探索而导致发散。

- 理论可靠性:底层高速 VI 算法被证明无论前瞻策略、深度或 softmax 温度如何,都能收敛到最优值函数 $V^*$(Remark 1)。这一理论保证为 Highway VIN 的学习动力学提供了坚实的基础,表明迭代更新在经过适当过滤后,最终将导致最优解决方案。

-

可学习参数:模型通过更新几组参数来学习:

- VI 和 VE 模块中卷积层的权重。

- 用于在 VE 模块中生成嵌入式策略的可学习参数 $W_{np}^{(n+n_b)}$。

- 聚合门中的 softmax 温度 $\alpha_a^{(n_p+n_b)}$ 和 $\alpha_n^{(n_p+n_b)}$,它们控制不同信息路径的权重。

通过这种架构设计、受控随机性和理论上可靠的算子的结合,Highway VIN 通过迭代地精炼其值函数估计,有效地学会了执行长期规划,克服了复杂顺序决策任务中深度网络训练的挑战。

Figure 3. Planning module of highway VIN. Here, we demonstrate the planning module of highway VIN using a highway block of depth Nb = 4 and incorporating Np = 2 embedded policies

Figure 3. Planning module of highway VIN. Here, we demonstrate the planning module of highway VIN using a highway block of depth Nb = 4 and incorporating Np = 2 embedded policies

Figure 2. (a): Architecture of VIN and highway VIN. (b): Architecture of the planning module of VIN, which includes N layers of value iteration modules. The architecture of the value iteration module is detailed in Fig. 4(a)

Figure 2. (a): Architecture of VIN and highway VIN. (b): Architecture of the planning module of VIN, which includes N layers of value iteration modules. The architecture of the value iteration module is detailed in Fig. 4(a)

结果、局限性与结论

实验设计与基线

为了严格验证其主张,作者们进行了一系列实验,主要集中在二维迷宫导航和一定程度上的三维 ViZDoom 导航任务。二维迷宫导航的实验设置与 GPPN 论文(Lee et al., 2018)中描述的非常相似。对于这些任务,代理被训练来导航不同大小的迷宫,特别是 $15 \times 15$ 和 $25 \times 25$,动作包括前进、左转 90 度或右转 90 度,以及保持四种方向。

训练方案包括 30 个 epoch 的模仿学习,使用标记数据集,包括 25K 个迷宫用于训练,5K 个用于验证,5K 个用于测试。使用了 RMSprop 优化器,学习率为 0.001,批次大小为 32。规划模块内的卷积操作使用了 5 的核大小,将观测映射到潜在 MDP 的神经网络具有 150 的隐藏维度。

评估规划能力的主要指标是成功率 (SR),定义为成功完成的任务数与总规划任务数的比率。如果代理在预定步数内生成了从起点到终点的路径,则认为任务成功。为了评估长期规划能力,算法在具有不同最短路径长度 (SPLs) 的任务上进行了评估,SPLs 使用 Dijkstra 算法预先计算。更长的 SPLs 固有地需要更多的长期规划。所有实验都进行了 3 次随机种子运行,并报告了 SR 的均值和标准差。

与提出的 Highway VIN 进行比较的“受害者”(基线模型)包括:

* 原始 VIN (Tamar et al., 2016):基础值迭代网络。

* GPPN (Lee et al., 2018):门控路径规划网络,一种为提高稳定性而设计的循环 VIN 变体。

* Highway Network (Srivastava et al., 2015b):一种包含跳跃连接的深度神经网络架构,此处已适应于 VIN。

为了公平比较,基线 VIN 和 GPPN 在 $15 \times 15$ 迷宫中使用了 20 层,在 $25 \times 25$ 迷宫中使用了 30 层。Highway Networks 和 Highway VINs 在 $15 \times 15$ 迷宫中使用了 $N_B = 20$ 个高速块,在 $25 \times 25$ 迷宫中使用了 $N_B = 30$ 个。探索了各种总深度 $N$,范围从 $15 \times 15$ 迷宫的 40 到 200,以及 $25 \times 25$ 迷宫的 60 到 300。除非另有说明,Highway VINs 使用单个并行 VE 模块 ($N_p = 1$) 和嵌入式探索率 $\epsilon = 1$。

还进行了消融研究,以隔离过滤器门和 VE 模块的影响,并研究并行 VE 模块数量 ($N_p$) 的变化。最后,该方法在三维 ViZDoom 导航中进行了测试,其中输入由 RGB 图像组成,并评估了 SPLs 超过 30 的任务的性能。还测量了计算复杂度,包括 GPU 内存使用和 300 层网络在 NVIDIA A100 GPU 上的训练时间。

证据证明了什么

证据压倒性地支持了 Highway VINs 通过实现非常深的网络的高效训练,显著增强了长期规划能力的核心主张,而这是 VINs 以前难以实现的。

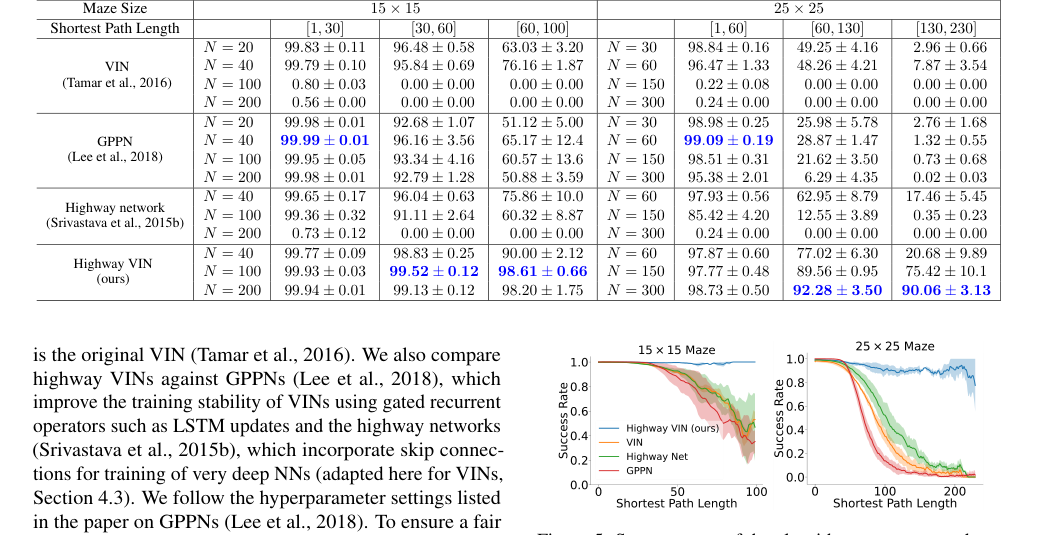

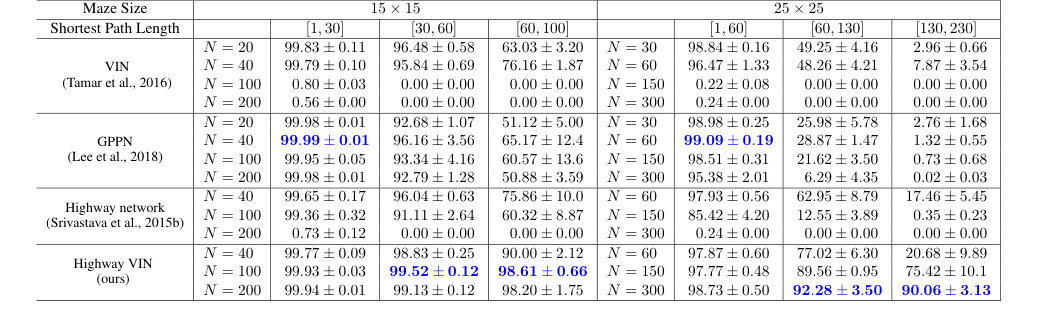

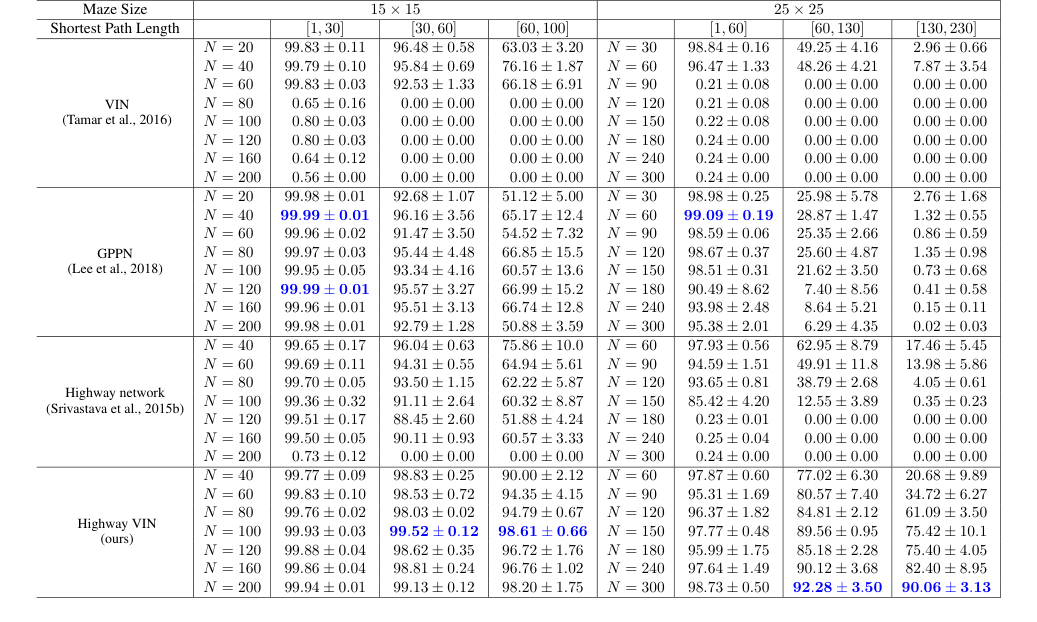

最确凿的证据来自二维迷宫导航中的比较成功率,尤其是在需要长最短路径长度 (SPLs) 的任务中。如表 1 和图 5 所示,对于 $25 \times 25$ 迷宫,当 SPLs 超过 200 时,基线 VIN、GPPN 和 Highway Network 模型的成功率骤降至接近 0%。与此形成鲜明对比的是,Highway VIN 在这些具有挑战性的长期规划场景中保持了令人印象深刻的 90% SR。同样,对于 SPLs 约为 100 的 $15 \times 15$ 迷宫,Highway VIN 实现了 98% 的 SR,而其他方法则显示出明显的性能下降。这清楚地表明了 Highway VIN 在处理长期信用分配方面的卓越能力。

论文还强调了现有方法的局限性:

* 原始 VIN 的性能随着深度的增加而急剧下降,对于深度超过 $N=150$ 的网络,成功率降至几乎 0%。这在图 1 中得到了直观的体现,该图显示了一个 30 层 VIN 的成功率在 SPLs 超过 120 时降至 10% 以下,而一个 300 层 VIN 则表现不佳。

* 尽管 Highway Network 在更大的深度下保持了性能,但与较浅的对应模型相比,其长期规划能力并未显著提高。

* GPPN 尽管对于短 SPLs 表现稳健(在 $25 \times 25$ 迷宫中 SPLs [1,30] 的成功率为 99.09%),但对于更长的路径则彻底失败,在 SPLs [130,230] 下降至 3% 以下。

Highway VIN 的学习特征图(图 6)提供了进一步的证据,证明了其有效性。与 VIN 相比,Highway VIN 的特征图显示了远离目标的状态具有更大的学习值,这表明 Highway VIN 为长期规划开发了更有效、更全面的值函数。

消融研究提供了关于 Highway VIN 新组件必要性的关键见解:

* 过滤器门:图 7 明确显示,没有过滤器门,Highway VIN 的性能会显著下降。这证明了过滤器门在丢弃“无用的探索路径”和确保收敛方面的基本作用,直接验证了其数学目的。

* VE 模块:图 8 显示,当缺少 VE 模块时,性能明显下降,尤其是在 $25 \times 25$ 迷宫中。这证实了 VE 模块引入的潜在动作多样性对于促进空间维度上的信息和梯度流至关重要。表 2 进一步量化了这一点,显示 Highway VIN 在所选潜在动作的熵方面显著高于 VIN(例如,$15 \times 15$ 迷宫中 $N=200$ 时为 4.17,而 VIN 为 0.00),直接证明了其保持多样性的能力。

最后,在三维 ViZDoom 导航(表 3)中,Highway VIN 再次超越了基线,在 SPLs [60,100] 下实现了 96.98% 的 SR,而 VIN 为 69.37%,这进一步巩固了其在更复杂视觉环境中的可泛化性。尽管 Highway VIN 对于 300 层网络确实需要更多的 GPU 内存(15.0G 对比 VIN 的 3.1G)和训练时间(9.0 小时对对比 VIN 的 7.5 小时),但与 GPPN 的 103.0G 内存使用相比,这是长期规划性能显著提升的合理权衡。

局限性与未来方向

尽管 Highway VIN 在深度神经网络的长期规划方面取得了重大进展,但该论文也隐含和明确地指出了几个局限性,并为未来的研究开辟了道路。

一个明显的局限性,尽管是可以管理的,就是非常深的高速 VIN 的计算成本增加。如计算复杂度表所示,训练一个 300 层 Highway VIN 比标准 VIN(3.1G,7.5 小时)或 Highway Network(3.3G,7.7 小时)需要更多的 GPU 内存(15.0G)和训练时间(9.0 小时)。尽管这仍然比 GPPN(103.0G)有效得多,但它表明扩展到更大、更复杂的现实世界问题可能需要进一步优化。

另一个有趣的观察是,在 B.2 节和图 10 中提到,额外的并行 VE 模块 ($N_p > 1$) 有时会对非常深的网络产生不利影响。例如,在深度 $N=300$ 时,$N_p=1$ 表现最佳,而在 $N=100$ 时,$N_p=3$ 是最优的。这表明当前整合多个并行 VE 模块的机制可能并非普遍有益,甚至可能在某些深度配置中阻碍性能。这暗示着需要一种微妙的平衡或更复杂的策略来组合这些模块。

论文还提到,在训练期间使用了嵌入式探索率 $\epsilon=1$(完全随机),尽管过滤器门可以防止次优解,但这种固定的、最大化的探索可能并非对所有场景都最有效或最适应。更动态或自适应的探索机制可能可以进一步提高学习效率或在具有不同程度不确定性或稀疏奖励的环境中的性能。

展望未来,作者们在其结论中明确提出了两个关键方向:

1. 研究整合多个并行 VE 模块与各种类型的嵌入式策略,以提高性能。这直接解决了关于 $N_p > 1$ 的局限性,并建议探索更细致的方式来利用不同的规划视野和策略。

2. 专注于扩展到更大的任务。当前的实验虽然令人印象深刻,但主要集中在迷宫导航和特定的三维环境。将 Highway VIN 扩展到真正大规模、高维度和非结构化的现实世界规划问题(例如,复杂的机器人技术、动态城市中的自动驾驶)将是自然且关键的下一步。

除了这些之外,还出现了几个值得进一步发展的讨论话题:

* 理论鲁棒性与泛化性:虽然高速 VI 算法具有收敛保证,但对完整的可微分 Highway VIN 架构进行更深入的理论分析,尤其是在随机性和复杂门交互存在的情况下,将非常有价值。这可以为在安全关键应用中的部署提供更强的保证。

* 效率与资源优化:考虑到非常深的网络在计算上的需求,未来的工作可以探索知识蒸馏等技术,以在不显著损失性能的情况下将深度 Highway VIN 压缩成更浅、更有效的模型。此外,研究剪枝策略或硬件感知优化可以使这些模型更容易被资源受限的环境所使用。

* 超越网格世界规划:当前的应用是基于网格的或涉及预测网格状地图。探索 Highway VIN 如何适应连续动作空间或图基规划问题(其中状态表示不是简单的网格)将拓宽其适用性。这可能涉及在规划模块内集成不同类型的卷积或图神经网络层。

* 可解释性与可解释性:尽管学习到的特征图提供了一些见解,但进一步研究解释 Highway VIN 做出某些规划决策的原因可能是有益的。我们能否提取人类可理解的规划启发式方法,或可视化深度网络中“价值”和“策略”信息的流动,以更好地理解其内部工作原理?这有助于建立信任并简化复杂 AI 系统中的调试。

* 与其他 RL 范式的集成:Highway VIN 如何与其他先进的强化学习范式集成,例如基于模型的 RL 与学习到的世界模型或分层 RL?规划模块是否可以作为更大、更复杂的 RL 代理的组成部分,以应对更复杂、多阶段的决策问题?这可能会产生结合了深度规划与其他学习机制优势的混合系统。

Figure 5. Success rates of the algorithms are presented as a function of varying shortest path length. For each algorithm, the optimal result from a range of depths is selected. For a comprehensive view of the results across all depths, please see Fig. 9 in the Appendix

Figure 5. Success rates of the algorithms are presented as a function of varying shortest path length. For each algorithm, the optimal result from a range of depths is selected. For a comprehensive view of the results across all depths, please see Fig. 9 in the Appendix

Table 1. The success rates for each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path length. Please also refer to Appendix Table 4 for the results of all the other depths

Table 1. The success rates for each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path length. Please also refer to Appendix Table 4 for the results of all the other depths

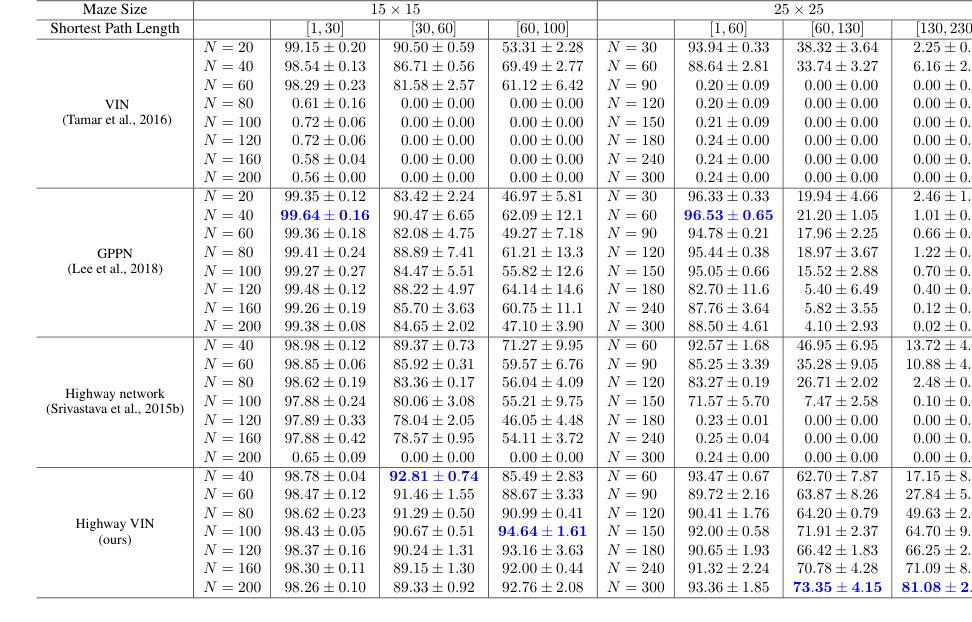

Table 5. Optimality rates of each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path lengths. The optimality rate is defined by the ratio of tasks completed within the steps of the shortest path length to the total number of tasks

Table 5. Optimality rates of each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path lengths. The optimality rate is defined by the ratio of tasks completed within the steps of the shortest path length to the total number of tasks

Table 4. Success rates of each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path lengths

Table 4. Success rates of each algorithm with various depths under 2D maze navigation tasks with different ranges of shortest path lengths

与其他领域的同构性

结构骨架

本文提出了一种机制,通过整合信息流、受控探索和路径过滤来确保稳定收敛,从而在深度不确定的系统中鲁棒地优化多步顺序决策。