TAPNext:将任意点追踪(TAP)视为下一个Token预测

The problem of "correspondence" has been a foundational challenge in computer vision for decades.

背景与学术渊源

起源与学术渊源

“对应”问题几十年来一直是计算机视觉领域的基石性挑战。该领域的杰出人物竹内武夫(Takeo Kanade)曾将“对应、对应、再对应!”誉为三个最基本问题之一。历史上,这涉及到在图像之间寻找匹配的点或区域,这对于理解运动、估计深度以及从照片集中重建三维场景等任务至关重要。

最近,这一基本问题在视频领域以“追踪任意点(TAP)”的形式重新焕发活力并不断演进。这一特定问题最初是为了解决光流等早期方法的局限性而出现的。虽然光流方法可以追踪帧间运动,但它们在较长的时间跨度内常常会产生显著的漂移,并且难以处理遮挡问题。TAP的出现旨在弥合这一差距,专注于在整个视频中为固体物体上的特定点提供密集、长程的对应关系。这种能力对于机器人技术、视频编辑、三维重建、动作识别、动物学甚至医学等广泛的下游计算机视觉应用都极具价值。

促使作者开发TAPNext的先前TAP方法的根本局限性或“痛点”在于它们依赖于复杂的、特定于追踪的归纳偏置和启发式方法。许多先前模型将追踪表述为一个两步过程,包括逐帧编码、用于匹配的成本体积计算以及后续的轨迹细化。这常常引入关于如何解决追踪问题的限制性假设,例如将其视为特征空间中的外观匹配问题。这些方法经常包含大量的启发式设计元素,包括可微分argmax操作、双线性特征插值、受限搜索窗口和窗口化推理。

此外,许多现有的追踪器需要未来帧的信息来产生当前帧的输出,这使得它们不适用于实时应用。即使是使用局部窗口化推理的在线方法,由于其仅依赖于连续窗口之间的点传递,也常常在长期遮挡期间失败。这些复杂的架构和算法选择限制了先前模型在通用性、可扩展性和整体性能方面的表现,尤其是在长期追踪基准测试中。作者的动机是构建一个更简单、更具可扩展性且性能更优的模型,该模型可以在不施加强大、显式归纳偏置的情况下克服这些局限性。

直观领域术语

- 追踪任意点(TAP):想象一下你在观看一个繁忙街道的视频,你想在整个片段中追踪一辆移动汽车上一个微小的、特定的油漆斑点,或者一个人夹克上一个特定的纽扣。TAP正是计算机视觉中要做的任务:识别并追踪视频中移动和变化的物体上任何选定点的精确位置。

- 归纳偏置(Inductive Biases):将这些视为模型用于学习的内置假设或“捷径”。例如,如果你教一个孩子识别猫,并告诉他们“猫总是尖耳朵”,这就是一个归纳偏置。它能帮助他们更快地学习,但可能会导致他们错误地识别一只折耳猫。在计算机视觉中,这些偏置是模型架构中的设计选择,指导模型以特定方式解决问题,但它们也可能限制其灵活性或泛化能力。

- 成本体积计算(Cost-Volume Computation):想象一位侦探试图将“通缉令”上的嫌疑人脸与人群中的每一张脸进行匹配。成本体积就像一张详细的、像素级的地图,告诉侦探人群中每张脸与嫌疑人脸的相似程度。它量化了匹配每个潜在位置的“成本”或不相似性。

- 状态空间模型(SSM):考虑一位讲故事的人正在叙述一个漫长、展开的故事。讲故事的人不需要从一开始就记住每一个细节,而是维护一个故事当前情况(“状态”)的简洁、不断演进的摘要。随着新事件(视频帧)的发生,他们会更新这个摘要,使他们能够保持叙述的连贯性,并预测接下来可能发生的事情,而无需每次都从第一页重读整个故事。

符号表

| 变量 | 描述 |

|---|---|

问题定义与约束

核心问题表述与困境

本文解决的核心问题是视频中的追踪任意点(TAP)。精确地说,模型(输入/当前状态)的起点包括:

- 一个包含 $T$ 帧的视频,其中每帧都是 $H \times W$ 像素的 RGB 图像。

- 一组 $Q$ 个查询点,每个点由其时间 $t$ 和在视频中的空间坐标 $(x, y)$ 定义。

期望的终点(输出/目标状态)是为视频中的每一帧、每一个查询点预测其坐标 $(x, y) \in [0, H] \times [0, W]$ 和一个二元的可见性标志。

本文试图弥合的精确缺失环节或数学鸿沟是将TAP问题转化为一个序列化掩码Token解码任务。TAPNext不依赖于复杂的、特定于追踪的归纳偏置和启发式方法,而是将点追踪表述为一个插补问题。给定初始查询点的坐标,模型的任务是“填充”或插补代表这些点在所有其他帧中未知坐标的掩码Token。这是通过将视频Token(源自图像块)与点坐标Token连接来实现的,其中查询点信息通过位置编码注入。然后,模型通过预测掩码Token来学习解码完整的轨迹。

试图解决这一特定问题的先前研究人员陷入了几个痛苦的权衡和困境:

- 通用性 vs. 特异性:现有的TAP方法严重依赖于复杂的、特定于追踪的归纳偏置和启发式方法。虽然这些方法可能在特定场景下提供性能提升,但它们严重限制了模型的通用性和可扩展性。改进一个方面(例如,通过专用架构提高准确性)通常会破坏另一个方面(例如,可扩展性和广泛适用性)。

- 准确性 vs. 实时延迟:许多先前的方法通过使用未来帧来预测当前帧输出,或通过采用窗口化推理来实现高精度。这种方法本质上会引入延迟,使其不适用于机器人技术等实时应用。困境是如何在不牺牲实时能力的情况下实现高追踪性能。

- 鲁棒性 vs. 简洁性:传统方法通常涉及多步过程,如逐帧编码、成本体积计算以进行匹配以及迭代细化。这些复杂的流程虽然旨在提高对漂移和遮挡的鲁棒性,但引入了许多启发式设计元素(例如,可微分argmax、双线性插值、受限搜索窗口),使得模型复杂且可扩展性差。

- 长期追踪 vs. 遮挡处理:基于光流的方法在长时域上会产生显著漂移,并且难以处理遮挡。虽然引入了长期点追踪来解决这个问题,但许多在线方法中的窗口化推理仍然会导致追踪失败,尤其是在长期遮挡期间,因为点在连续窗口之间传递时可能会丢失。

约束与失败模式

追踪任意点(TAP)的问题由于作者遇到的几个严峻的现实障碍而极其难以解决:

- 数据稀缺:TAP的真实世界训练数据稀缺。这迫使先前的工作严重依赖合成数据,然后需要复杂的归纳偏置和定制架构来弥合“模拟到真实”的差距,从而限制了模型的可扩展性和通用性。

- 计算复杂性与内存限制:

- 传统方法通常为每个查询点独立计算成本体积,这可能计算成本高昂。

- 迭代细化步骤和窗口化推理方案增加了显著的计算开销。

- 硬件内存限制是一个实际问题,一些基线模型的高内存使用量(例如,如表2所示的LocoTrack-B使用超过30 GB内存)证明了这一点。开发内存效率高的模型对于部署至关重要。

- 实时延迟要求:对于机器人等应用,严格的实时延迟是一个关键约束。需要处理未来帧或大时间窗口才能输出当前帧预测的方法在适用性上存在固有局限性。

- 时间连贯性与漂移:在长视频序列中保持时间连贯性具有挑战性。自回归模型根据过去预测未来状态,容易累积误差,导致随时间推移产生显著漂移。这是许多追踪器的一个主要失败模式。

- 泛化到长视频:在较短视频片段(例如,48帧)上训练的模型通常难以泛化到明显更长的视频(例如,超过150帧)。这种时间泛化能力的限制是一个重大障碍,特别是对于状态空间模型(SSM),如果未得到适当缓解。论文指出,当SSM被替换为时间注意力时,模型表现出较差的时间泛化能力,即使使用SSM,如果在足够长的序列上未进行训练,在“超过150帧的视频全程的长期点追踪中也存在显著失败”。

- 非可微分操作:先前架构中的许多启发式设计元素,例如可微分argmax操作或特征的双线性插值,引入了TAPNext旨在避免的复杂性,以实现更简单、更统一的方法。

- 遮挡处理:点在视频中可能会被长时间遮挡。通过这些遮挡鲁棒地追踪点并正确预测其可见性是一个持续的挑战。窗口化推理方法在长期遮挡期间常常失败。

- 外观变化:被追踪点的外观可能由于光照变化、视角转移或形变而改变,使得基于外观的匹配变得困难。

- 坐标预测精度:坐标预测空间受图像尺寸的限制,同时实现高精度并表示不确定性(例如,多模态预测)是一项复杂任务。坐标头需要能够同时预测连续坐标并处理图像像素的离散性质。

- 模拟到真实差距:主要在合成数据上训练的模型由于视觉特征的差异,在真实世界视频上表现不佳,需要鲁棒的机制来弥合这种领域差距。论文提到在伪标记的真实数据上训练对此有益。

- 缺乏归纳偏置:虽然TAPNext旨在消除特定于追踪的归纳偏置以实现通用性,但这也意味着模型必须从数据中有机地学习这些必要的启发式方法,这可能是一个更困难的学习问题。论文表明一些启发式方法自然出现,但并非所有问题都保证如此。

- 视觉信息传播:模型必须学会从过去帧准确地将视觉信息传播到未来帧,特别是对于被追踪点覆盖的区域,即使它们已被遮挡。如果模型没有关于某些视觉区域的先前信息,它可能会简单地用平均值填充它们,这是一个失败模式。这对于在初始点网格移开后出现的区域尤其相关,这些区域没有得到很好的重建。这是模型的一个关键挑战,因为它必须保持被追踪点的准确视觉表示。这不应被视为生成模型,而应视为线性探测实验。

为什么选择这种方法

选择的必然性

TAPNext的作者面临一个关键的十字路口,传统的追踪任意点(TAP)的最新技术(SOTA)方法被证明根本不足。核心认识是,现有的TAP方法过度依赖于“复杂的、特定于追踪的归纳偏置和启发式方法”(摘要)。这些方法包括成本体积计算、迭代细化、窗口化推理以及显式的逐帧外观匹配等技术。虽然这些方法取得了合理的性能,但它们本质上限制了模型的通用性和可扩展性,尤其是在试图弥合从合成数据到真实世界数据的“模拟到真实差距”时。

这一认识的确切时刻似乎源于这样一个观察:这些复杂、手工设计的组件是:

1. 过于受限:具有强归纳偏置设计的架构限制了它们扩展和泛化到各种场景的能力。

2. 并非真正在线:许多方法,即使是那些声称具有在线能力的,仍然依赖于未来帧或大的时间窗口,使其不适用于机器人技术等实时应用。这种依赖性常常导致在长期遮挡期间的追踪失败。

3. 启发式驱动:需要可微分argmax、双线性插值、受限搜索窗口和其他特定设计元素,使得整个系统复杂且脆弱。

作者得出结论,需要一个概念上更简单、更通用的架构——一个可以在不被明确规定如何使用运动和外观线索的情况下学习追踪点的架构。这促使他们将TAP表述为一个“序列化掩码Token解码”问题,利用通用的组件,如状态空间模型(SSM)进行时间处理和视觉Transformer(ViT)进行空间处理,这种组合之前在TRecViT [40]中有所探索。这种方法被认为是克服先前SOTA方法固有的复杂性、通用性不足和可扩展性差的局限性的唯一可行解决方案。

比较优势

TAPNext在几个关键方面展示了超越先前黄金标准的定性优势,这些优势超出了单纯的性能指标:

- 涌现的启发式方法:最引人注目的优势之一是,许多广泛使用的追踪启发式方法(例如,基于运动聚类的注意力、基于坐标的读出以及类似成本体积的注意力)“通过端到端训练自然地在TAPNext中涌现”(摘要,图3)。这消除了对复杂、手工设计的组件的需求,使得模型更加简洁和鲁棒。

- 增强的时间连贯性和遮挡处理:通过采用循环状态架构,特别是SSM,TAPNext可以保持时间连贯性,并有效地捕捉被追踪点随时间变化的动态。这种结构优势使其能够比基于窗口的推理方法更准确地处理长期遮挡,而后者在点被长时间遮挡时常常会失败。

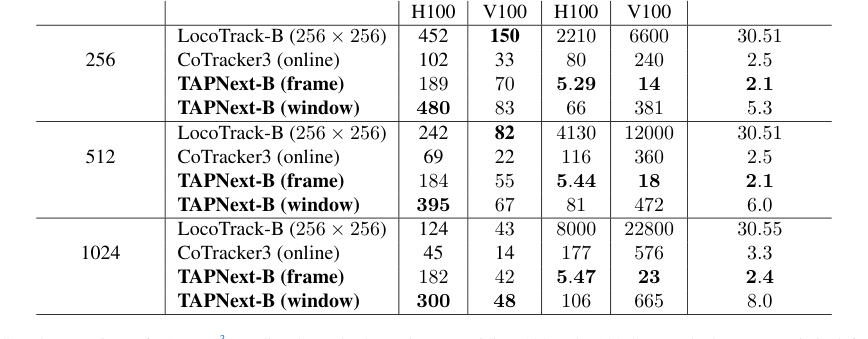

- 降低内存和延迟:本文提供了TAPNext效率的令人信服的证据。例如,TAPNext-B(帧)的内存使用量(例如,2.1-2.4 GB)显著低于LocoTrack-B(256x256)的约30.5 GB(表2)。此外,其延迟也大大降低,在5.29-5.47毫秒的范围内运行,比CoTracker3(80-177毫秒)或LocoTrack-B(2210-8000毫秒)快几个数量级。这使其在实时应用中具有压倒性的优势。

- 可扩展性和泛化能力:TAPNext的设计具有最少的特定于追踪的归纳偏置,使其能够更好地泛化。它可以追踪比训练时看到的视频长得多(长达5倍)的视频,这是真实世界场景中的一项关键能力。SSM的线性循环也使得时间处理可以在离线环境中并行化,进一步提高了效率。

- 多模态预测:与通常依赖单一轨迹假设的先前方法不同,TAPNext的坐标分类头可以表示多模态预测,从而能够表达不确定性。这是处理模糊追踪情况的定性飞跃。

- 简洁性和无偏解决方案:模型的概念简洁性,具有很少的超参数和没有特定于追踪的归纳偏置,使其能够发现TAP问题的无偏解决方案,而不是受限于对运动和外观的预定义概念。这使其更具适应性,并且可能更强大。

与约束的对齐

将TAP表述为序列化掩码Token解码的方法,建立在TRecViT的交错SSM和ViT块之上,完美地符合了问题的严峻要求,形成了问题与解决方案之间的强大“联姻”。

- 在线和因果追踪:一个主要约束是需要纯粹的在线和因果追踪,这对于机器人技术和实时应用至关重要。TAPNext通过顺序处理帧并通过SSM维护循环状态来实现这一点,确保当前帧的预测仅依赖于过去的信息。这直接解决了许多依赖未来帧的先前方法的局限性。

- 最小延迟:架构的设计,特别是线性循环SSM的使用,实现了最小延迟。它在消耗每帧后立即输出点预测,避免了其他SOTA追踪器中引入延迟的时间窗口或迭代细化步骤。

- 可扩展性和通用性:对可扩展且通用的模型、无复杂归纳偏置的需求,通过TAPNext使用现成的架构组件(SSM和ViT)及其作为掩码解码任务的表述得到满足。这使得模型能够在没有显式手工设计的启发式方法的情况下学习追踪,使其更能适应各种场景和更长的视频。

- 处理长期遮挡:SSM层维护的循环状态对于保持时间连贯性以及即使在长期遮挡期间也能追踪点至关重要。这直接解决了基于窗口的方法的一个重大弱点,这些方法在点消失和重新出现时会遇到困难。

- 计算效率:SSM的线性循环允许在时间上并行推理,这对于在不增加过高计算复杂性的情况下处理长视频至关重要。这是依赖于窗口化推理或迭代细化的方法的关键优势,这些方法对于长序列可能计算成本高昂。

- 不确定性表示:将坐标预测作为分类任务,允许多模态预测,这与表示追踪不确定性的需求相符,这是先前基于点估计的方法常常缺乏的能力。

替代方案的拒绝

本文通过在TAP的背景下强调其固有的局限性,隐式和显式地拒绝了几种流行或传统的方法。

- 传统SOTA方法(成本体积、迭代细化、窗口化推理):作者明确指出,“TAP的现有方法严重依赖于复杂的、特定于追踪的归纳偏置和启发式方法”(摘要)。他们将其详细描述为“成本体积计算,然后是轨迹细化[11, 12, 21, 26]”,涉及“许多启发式设计元素,包括可微分argmax操作[12]、特征的双线性插值[21]、受限搜索窗口[9]和窗口化推理[26]”。这些方法被拒绝是因为它们限制了通用性、可扩展性,并且通常需要非因果处理或在长期遮挡期间导致追踪失败。TAPNext的目标是避免这些“强归纳偏置”,并开发一个“概念上更简单的架构”。

- 离线/非因果追踪器:许多追踪器“依赖于使用未来帧来产生当前帧的输出,这限制了它们在实时场景中的适用性”。这种非因果性质直接与在线追踪的要求相矛盾,导致它们在目标应用中被拒绝。

- 基于窗口的在线追踪器:虽然一些方法声称使用局部窗口具有在线能力,但本文指出它们“依赖于大的时间窗口以及点仅在连续窗口之间传递,这常常导致追踪失败,尤其是在视频中间的长期遮挡期间[21, 26]”。在长期追踪基准测试中的这种较差性能导致了在真正循环、逐帧解决方案的偏好下拒绝了此类方法。

- 具有时间注意力的标准Transformer:消融研究(表5)明确拒绝了使用标准时间注意力机制(如基本Transformer中的机制)作为时间处理组件。当SSM被替换为时间注意力时,模型“尽管使用了RoPE[45]时间位置嵌入(已知其能随时间泛化),但表现出较差的时间泛化能力”。这表明对于长程时间连贯性追踪的特定任务,SSM比通用时间注意力提供了更优越的结构优势,后者在长序列和泛化方面存在困难。这是一个关键发现,表明对于这个问题,简单的循环比复杂的注意力更有效。

- 单假设点估计:TAPIR和Co-Tracker等先前方法对“每个查询的单一轨迹假设进行多次细化步骤,并对该单一假设进行局部特征采样”。TAPNext的坐标分类头,可以表示多模态预测和不确定性,隐式地拒绝了这种更简单、信息量较少的方法。表示不确定性的能力是一个定性优势。

- 用于重建的生成模型:虽然本文确实进行了一项重建实验,但明确指出这不应被视为生成模型,而应视为“线性探测实验”。主要目标是追踪,而不是图像生成,作者并未发现“图像重建目标‘导致追踪性能提升’”。这表明,虽然使用了掩码自编码器进行Token插补,但视频帧的完整生成模型并未被认为对核心追踪任务是必需的或有益的。

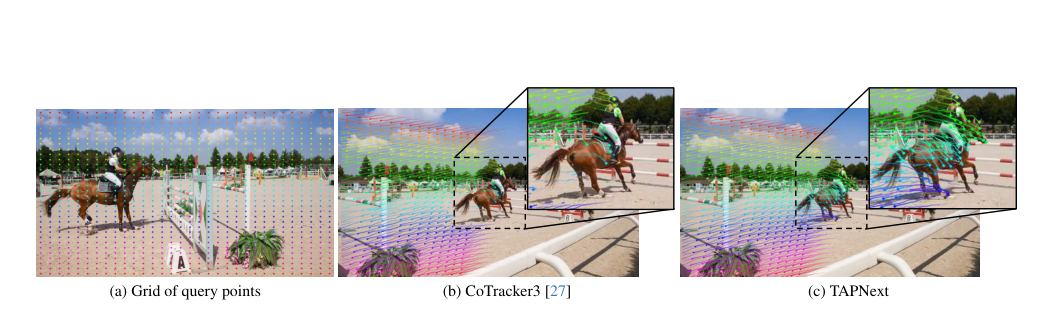

Figure 1. Dense grid tracking with TAPNext. We show (a) the query points on the first frame of the video, (b) the resulting tracks on the final frame of the video for CoTracker3 [27], and (c) our proposed TAPNext method

Figure 1. Dense grid tracking with TAPNext. We show (a) the query points on the first frame of the video, (b) the resulting tracks on the final frame of the video for CoTracker3 [27], and (c) our proposed TAPNext method

数学与逻辑机制

主方程

TAPNext的核心机制由一个多任务损失函数驱动,该函数结合了坐标预测(分类和回归)和可见性预测。该损失应用于TRecViT架构的每一层,确保模型深度上的稳健学习。总体目标是最小化模型预测与点坐标及其随时间可见性之间的地面真实值之间的差异。

总损失 $L_{total}$ 在训练期间最小化,可以表示为:

$$ L_{total} = \frac{1}{L \cdot Q \cdot T} \sum_{l=1}^{L} \sum_{q=1}^{Q} \sum_{t=1}^{T} \left( L_{coord}^{(l)}(t,q) + L_{vis}^{(l)}(t,q) \right) $$

其中 $L_{coord}^{(l)}(t,q)$ 是来自层 $l$ 的时间 $t$ 的查询点 $q$ 的坐标损失,而 $L_{vis}^{(l)}(t,q)$ 是相同点的可见性损失。这些单独的损失进一步定义为:

$$ L_{coord}^{(l)}(t,q) = L_{CE}(p_x^{(l)}(t,q), \text{target_bin}_x) + L_{CE}(p_y^{(l)}(t,q), \text{target_bin}_y) + L_{Huber}((\hat{x}^{(l)}_{t,q}, \hat{y}^{(l)}_{t,q}), (x_{t,q}, y_{t,q})) $$

$$ L_{vis}^{(l)}(t,q) = L_{BCE}(\hat{V}^{(l)}_{t,q}, V_{t,q}) $$

按项解剖

让我们剖析这些方程的每个组成部分,以理解其数学定义及其在TAPNext框架中的作用。

-

$L_{total}$:

- 数学定义:总损失函数,代表TAPNext训练期间要最小化的整体目标。它是所有层、查询点和时间步的单独损失的平均总和。

- 物理/逻辑作用:此项量化了模型在整个视频序列和所有追踪点上的预测“错误”程度。通过最小化 $L_{total}$,模型学会准确地预测点随时间的位置和可见性。跨层求和(如论文所述,权重相等)是一种战略选择,以确保中间表示也具有意义,防止深层出现诸如梯度消失之类的问题,并促进整个网络中的鲁棒特征学习。这种深度监督有助于稳定训练并提高最终性能。

- 为什么求和而不是其他操作? 求和用于组合来自不同组件(坐标、可见性)和不同层的损失。这表明所有这些方面对于整体任务都同样重要,任何部分的错误都会直接计入总误差。通过 $L \cdot Q \cdot T$ 进行平均化可以使损失归一化,使其独立于层数、查询数或帧数,这对于跨不同输入尺寸的稳定训练至关重要。

-

$L$:

- 数学定义:TRecViT骨干网络中交错的SSM和ViT层的总数。

- 物理/逻辑作用:代表模型处理流水线的深度。每一层都有助于精炼图像和点Token的时空表示。损失应用于每一层,以确保不同抽象级别的特征都有意义并有助于最终预测,这是一种深度监督形式。

-

$Q$:

- 数学定义:视频中正在追踪的查询点的数量。

- 物理/逻辑作用:这是模型任务是预测其轨迹的单个点的计数。损失对所有查询点求和,以确保模型学会同时准确地追踪多个点。

-

$T$:

- 数学定义:视频序列中的总帧数。

- 物理/逻辑作用:代表视频的时间范围。损失对所有时间步求和,以确保模型在整个视频中一致地追踪点,捕捉其时间动态并处理遮挡。

-

$L_{coord}^{(l)}(t,q)$:

- 数学定义:来自层 $l$ 的时间 $t$ 的查询点 $q$ 的组合坐标损失。它包括两个用于分类的交叉熵项和一个用于回归的Huber损失项。

- 物理/逻辑作用:此项驱动模型预测被追踪点的精确 $(x,y)$ 坐标。分类和连续回归的双重方法允许模型同时捕捉离散空间位置和精细的连续位置。分类方面有助于模型表示多模态预测和不确定性,这对于模糊情况或遮挡情况来说是一个显著优势,不像仅输出单个点估计的方法。

-

$L_{CE}(p_x^{(l)}(t,q), \text{target_bin}_x)$ 和 $L_{CE}(p_y^{(l)}(t,q), \text{target_bin}_y)$:

- 数学定义:Softmax交叉熵损失。对于给定的坐标(例如,x坐标),$p_x^{(l)}(t,q)$ 是 $n$ 个离散箱的预测概率向量,而 $\text{target_bin}_x$ 是独热编码的地面真实箱。

$$ L_{CE}(p, \text{target}) = - \sum_{i=1}^{n} \text{target}_i \log(p_i) $$ - 物理/逻辑作用:这些项训练坐标头将 $x$ 和 $y$ 坐标分类到预定义的离散箱中。这种受 [16] 启发的分类方法至关重要,因为它允许模型表达不确定性(例如,一个点可能以一定的概率位于几个箱中的一个),并处理多模态预测,这比仅预测单个连续值的先前方法具有显著优势。论文指出,这种分类坐标头是其中最重要的组成部分之一。

- 数学定义:Softmax交叉熵损失。对于给定的坐标(例如,x坐标),$p_x^{(l)}(t,q)$ 是 $n$ 个离散箱的预测概率向量,而 $\text{target_bin}_x$ 是独热编码的地面真实箱。

-

$L_{Huber}((\hat{x}^{(l)}_{t,q}, \hat{y}^{(l)}_{t,q}), (x_{t,q}, y_{t,q}))$:

- 数学定义:Huber损失,应用于连续预测坐标 $(\hat{x}^{(l)}_{t,q}, \hat{y}^{(l)}_{t,q})$ 与地面真实坐标 $(x_{t,q}, y_{t,q})$。连续坐标是从分类器概率的期望值得出的:$\hat{x}^{(l)}_{t,q} = \sum_{i=1}^{n} b_{x,i} \cdot p_x^{(l)}(t,q,i)$,其中 $b_{x,i}$ 是箱 $i$ 的中心。

$$ L_{Huber}(e) = \begin{cases} 0.5 e^2 & \text{if } |e| \le \delta \\ \delta (|e| - 0.5 \delta) & \text{if } |e| > \delta \end{cases} $$

其中 $e$ 是误差(例如,$\hat{x} - x$),$\delta$ 是一个超参数。 - 物理/逻辑作用:此项充当回归损失,微调连续坐标预测。Huber损失选择而不是简单的L2(均方误差)损失,因为它对异常值不那么敏感。在点追踪中,地面真实标注有时可能存在轻微的不准确性,或者点可能由于遮挡或快速运动而短暂出现在意外位置。Huber损失为小误差(如L2)提供了平滑的梯度,但为大误差(如L1)提供了线性梯度,使其对这种噪声更鲁棒,并防止大误差主导损失景观。

- 数学定义:Huber损失,应用于连续预测坐标 $(\hat{x}^{(l)}_{t,q}, \hat{y}^{(l)}_{t,q})$ 与地面真实坐标 $(x_{t,q}, y_{t,q})$。连续坐标是从分类器概率的期望值得出的:$\hat{x}^{(l)}_{t,q} = \sum_{i=1}^{n} b_{x,i} \cdot p_x^{(l)}(t,q,i)$,其中 $b_{x,i}$ 是箱 $i$ 的中心。

-

$L_{vis}^{(l)}(t,q)$:

- 数学定义:来自层 $l$ 的时间 $t$ 的查询点 $q$ 的可见性损失。

- 物理/逻辑作用:此项驱动模型预测被追踪点在给定帧中是否可见或被遮挡。准确的可见性预测对于鲁棒追踪至关重要,尤其是在物体经常消失或暂时隐藏的真实世界场景中。

-

$L_{BCE}(\hat{V}^{(l)}_{t,q}, V_{t,q})$:

- 数学定义:Sigmoid二元交叉熵损失。$\hat{V}^{(l)}_{t,q}$ 是可见性预测概率(0到1之间的标量),而 $V_{t,q}$ 是二元地面真实值(0表示遮挡,1表示可见)。

$$ L_{BCE}(\hat{v}, v) = - (v \log(\hat{v}) + (1-v) \log(1-\hat{v})) $$ - 物理/逻辑作用:此项训练可见性头执行二元分类。当模型错误地预测点的可见性状态时,它会受到惩罚。Sigmoid激活确保输出是一个概率,而二元交叉熵是此类二类问题的标准损失。模型还使用不确定性估计:如果坐标的概率质量超过50%位于8像素半径之外,则该点被标记为遮挡,从而在坐标不确定性和可见性之间建立了自然的联系。

- 数学定义:Sigmoid二元交叉熵损失。$\hat{V}^{(l)}_{t,q}$ 是可见性预测概率(0到1之间的标量),而 $V_{t,q}$ 是二元地面真实值(0表示遮挡,1表示可见)。

分步流程

想象一个我们想要追踪的移动汽车上的特定像素的单个抽象数据点。以下是它通过TAPNext数学引擎的旅程:

-

输入与Token化:

- 旅程始于一个视频,一个包含 $T$ 帧的RGB序列,以及一组 $Q$ 个初始查询点,每个点由其起始时间和 $(x,y)$ 坐标定义。

- 每个视频帧首先被划分为 $h \times w$ 个非重叠图像块的网格。然后将这些块线性投影到 $C$ 维特征空间,并添加空间位置嵌入。这会将原始图像数据转换为一个形状为 $[T, h \times w, C]$ 的图像Token序列。

- 同时,对于我们的特定查询点(以及所有其他点),会创建一个 $T$ 个“点轨迹Token”的序列。对于我们的点最初被查询的帧,其Token用对应于其 $(x,y)$ 坐标的位置嵌入进行初始化。对于所有其他帧,其Token用一个特殊的“掩码Token”值进行初始化,表示其位置未知,需要预测。这些点Token的形状也为 $[T, Q, C]$。

-

输入张量组装:

- 然后将图像Token和点轨迹Token沿着空间维度连接起来。这会创建一个形状为 $[T, h \times w + Q, C]$ 的统一“输入Token张量”。该张量现在包含所有信息:视频的视觉内容和查询点信息,其中包含要追踪的帧的掩码位置。

-

分层时空处理(TRecViT):

- 这个组合的输入张量随后进入TRecViT骨干网络,该网络由 $L$ 个交错层组成。每一层都是一个两阶段过程:

- SSM块(时间处理):首先,数据通过状态空间模型(SSM)块。该块在时间维度($T$)上执行线性循环。它将组合的空间维度($h \times w + Q$)视为一个批次。概念上,这就像一个随时间移动的传送带。SSM块有效地将信息从过去帧传播到当前帧和未来帧,使模型能够保持点轨迹和外观的“记忆”。这对于通过遮挡和长时间追踪至关重要。

- ViT块(空间处理):接下来,SSM块的输出进入视觉Transformer(ViT)块。该块在每一帧内对所有 $h \times w + Q$ 个Token执行完全自注意力,将时间维度($T$)视为一个批次。这是模型在单帧内“环顾四周”的地方,允许图像Token关注点Token,点Token关注彼此和图像Token。这种空间混合有助于模型识别点相对于其周围环境的位置,并整合视觉线索。

- 这个两阶段过程(SSM然后ViT)对所有 $L$ 层重复进行,逐步精炼我们抽象数据点的时空表示。

- 这个组合的输入张量随后进入TRecViT骨干网络,该网络由 $L$ 个交错层组成。每一层都是一个两阶段过程:

-

预测头:

- 通过每一层 $l$ 后,模型输出 $T \times Q$ 个轨迹Token的集合。然后将这些Token输入到两个独立的预测头:

- 坐标头(MLP):一个MLP(多层感知机)接收每个时间步的点轨迹Token。它首先为x和y坐标的离散箱预测概率。然后,它通过将箱中心乘以这些概率来计算期望的连续 $(x,y)$ 坐标。

- 可见性头(MLP):另一个MLP接收相同的轨迹Token,并预测一个二元概率,指示该点在该帧中是否可见或被遮挡。

- 通过每一层 $l$ 后,模型输出 $T \times Q$ 个轨迹Token的集合。然后将这些Token输入到两个独立的预测头:

-

损失计算与反向传播:

- 对于每一层 $l$,以及每一个时间步 $t$ 和查询点 $q$,预测的坐标 $(\hat{x}^{(l)}_{t,q}, \hat{y}^{(l)}_{t,q})$ 和可见性 $\hat{V}^{(l)}_{t,q}$ 与地面真实值 $(x_{t,q}, y_{t,q})$ 和 $V_{t,q}$ 进行比较。

- 坐标损失 $L_{coord}^{(l)}(t,q)$ 使用箱分类的softmax交叉熵和连续回归的Huber损失来计算。

- 可见性损失 $L_{vis}^{(l)}(t,q)$ 使用Sigmoid二元交叉熵来计算。

- 将这些单独的损失相加形成 $L_{total}$。然后使用此总损失计算梯度,该梯度通过整个网络反向传播以更新模型的参数。这个前向传播、损失计算和反向传播的迭代过程使模型能够学习和改进其追踪能力。

优化动力学

TAPNext机制通过一个复杂的多任务端到端监督训练过程进行学习、更新和收敛,主要由多组件损失函数和架构设计选择驱动。

-

梯度流与深度监督:总损失 $L_{total}$ 是每一层 $l$、每一个查询点 $q$ 和每一个时间步 $t$ 的损失的总和。这种“深度监督”策略确保梯度有效地流经整个网络,从最终的预测头一直回溯到初始层。通过以相等的权重在每一层应用损失,模型被鼓励在多个抽象级别上学习有意义且准确的表示。这有助于缓解非常深的网络中常见的梯度消失或爆炸等问题,并确保中间特征也具有预测性,从而实现更鲁棒和稳定的学习过程。

-

损失景观塑造(坐标预测):坐标预测头是一项关键创新,它结合了分类和回归。

- 分类(Softmax交叉熵):将坐标离散化为 $n$ 个箱并使用softmax交叉熵损失来塑造损失景观,以允许多模态预测。如果一个点的真实位置不确定(例如,由于遮挡或运动模糊),模型可以为多个箱分配概率,而不是被迫确定一个单一的、可能不正确的连续值。这使得损失景观在不确定的情况下更平滑且更宽容,因为如果模型仍然捕捉到点的通用区域,它不会受到严重惩罚。

- 回归(Huber损失):对连续期望坐标应用的Huber损失提供了鲁棒的回归信号。对于小误差,它表现得像L2损失,提供强梯度以精确地定位坐标。对于大误差,它过渡到类似L1的行为,使其对异常值或极端预测误差不那么敏感。这可以防止少数难以追踪的点主导损失并扭曲模型的学习,从而塑造一个更稳定的损失景观。

-

时间连贯性和循环(SSM):SSM块的循环性是模型随时间更新其内部状态的基础。在训练期间,SSM学会将相关信息从过去帧传播到当前帧。这使得模型即使在长时间遮挡的情况下也能保持时间连贯性并追踪点。流经SSM层的梯度教会模型哪些信息需要记住以及如何转换它来预测未来状态。论文提到通过“将SSM中的遗忘门裁剪到0.0到0.1之间,并将查询特征广播到视频Token的长度”,可以部分缓解长视频退化。这是对SSM内部动态的特定调整,以提高其在非常长的序列中保留和传播信息的能力,防止状态衰减或变得无关紧要。

-

空间交互(ViT注意力):ViT块及其完全自注意力机制使模型能够学习复杂空间关系。流经注意力机制的梯度教会模型在更新特定点的表示时,如何权衡不同图像块和其他点Token的重要性。这使得模型能够隐式地学习各种追踪启发式方法,例如“类似成本体积的注意力”(匹配外观)、“基于坐标的读出”(使用空间上下文)和“基于运动聚类的读出”(分组移动对象),而无需将它们显式地设计到架构中。这些涌现的行为证明了端到端学习在塑造模型内部逻辑方面的力量。

-

BootsTAP(教师-学生学习):为了在真实数据上进行微调,TAPNext采用了名为BootsTAP的教师-学生设置。‘教师’模型是‘学生’权重的指数移动平均值,它在未损坏的、全分辨率的真实视频上提供稳定的伪标签。然后,‘学生’TAPNext模型从这些伪标签中学习,但是在视频的仿射变换和损坏版本上。损失仅反向传播给学生。这种机制有助于模型收敛到一个对常见真实世界损坏和仿射变换不变的鲁棒解决方案,有效地弥合了模拟到真实差距,并提高了泛化能力,而无需依赖复杂的归纳偏置。教师的稳定性可以防止学生崩溃或过拟合到嘈杂的伪标签。

总而言之,TAPNext通过精心设计的损失函数迭代地精炼其时空表示和预测头来收敛,该损失函数鼓励精确的定位和鲁棒的可见性估计,同时其循环和注意力机制学会跨时间和空间自适应地传播和整合信息。双坐标损失和BootsTAP策略是塑造一个有弹性且准确的模型关键。

结果、局限性与结论

实验设计与基线

为了严格验证TAPNext的数学主张并展示其优越性,作者设计了一个全面的实验设置。用于训练和评估的主要基准是TAP-Vid [11],它包括由Kubric生成的合成数据以及两个人工标注的评估数据集:DAVIS(30个视频,24至105帧)和Kinetics(1150个视频,250帧)。

他们训练策略的一个关键方面是使用了比先前工作大得多的合成数据集,包含500,000个视频,每个视频长48帧,并包含了相机平移和运动模糊等挑战性元素。对于真实世界微调,BootsTAPNext模型利用了来自互联网的1500万个视频片段,同样长48帧,遵循BootsTAP [13]的自监督训练方案。这包括在合成数据上进行初始300,000步训练,然后进行额外的1500步在真实视频上的自监督训练。模型在256 x 256分辨率下进行训练,使用批次大小为256个视频,每个视频有256个点查询。开发了两种模型变体:TAPNext-S(56M参数)和TAPNext-B(194M参数),在余弦衰减调度下,峰值学习率分别为 $10^{-3}$ 和 $5 \times 10^{-4}$。

在推理时,TAPNext模型在256 x 256分辨率下进行评估。作者采用了查询跨步评估,从每个查询点向前和向后运行视频,并一次追踪一个查询点,类似于CoTracker [26]那样,整合了局部和全局支持点以提高性能。

与TAPNext进行无情比较的“受害者”(基线模型)涵盖了广泛的现有TAP方法,按其延迟特性分类:

- 帧延迟方法:TAPNet [11],Online TAPIR [53],Online BootsTAP [13],Track-On [1]。这些模型在消耗每个帧后立即输出预测。

- 窗口化推理方法:TAPIR [12],BootsTAP [13],TAPTR [34],TAPTRv2 [33],TAPTRv3 [41],PIPs [21],CoTracker2 [26],CoTracker3 [27]。这些方法需要一小段帧(通常 $T=8$)才能输出轨迹。

- 视频延迟方法:OmniMotion [55],Dino-Tracker [51],LocoTrack-B [9]。这些模型需要整个视频作为输入才能产生点轨迹。

TAPNext核心机制的决定性证据是通过三个标准指标来衡量的:

1. 遮挡准确率(OA):分类点是否可见的准确率。

2. 坐标准确率(davg):预测坐标落在地面真实值1、2、4、8和16像素阈值内的点的平均比例。

3. 平均Jaccard:遮挡和坐标准确率的组合度量。

证据证明了什么

实验结果提供了无可辩驳的证据,表明TAPNext的核心机制——将追踪任意点(TAP)表述为序列化掩码Token解码,并采用简单的循环架构——非常有效。如表1所示,TAPNext在TAP-Vid基准测试的十二个报告指标中的八个上取得了新的最先进追踪性能,通常比其他在线(1帧延迟)方法有显著优势。考虑到TAPNext的延迟极低,使其适用于机器人技术等实时应用,这一点尤其令人印象深刻。

一个关键发现是,TAPNext在不依赖于先前最先进方法中常见的复杂、特定于追踪的归纳偏置或启发式方法的情况下,实现了这一点。它避免了迭代或窗口化推理、测试时优化、成本体积、特征插值、Token特征工程和局部搜索窗口。相反,模型基于状态空间模型(SSM)和视觉Transformer(ViT)等开源架构组件构建的简洁性,使其能够通过在大型合成数据集上进行端到端训练来自然地学习这些启发式方法。注意力图的可视化(图3和图4)证实,TAPNext有机地开发了类似于成本体积外观匹配、基于坐标的读出和基于运动聚类的读出的注意力模式——这些机制并未明确编程到其架构中。

此外,TAPNext展示了卓越的泛化能力。尽管在48帧视频上进行了训练,但它成功地追踪了长达五倍的视频(例如,Kinetics数据集中的250帧视频)。这种强大的时间泛化能力归因于其SSM层的循环性质,这些层在因果在线处理点,并即使在长期遮挡期间也能保持时间连贯性。消融研究(表4)强调了分类坐标头(使用分类和回归损失)以及选择8x8像素图像块大小的关键作用。表5进一步强调了SSM在时间处理方面的优越性,该表显示用时间注意力替换SSM会导致时间泛化能力差,即使使用了先进的位置嵌入。

在效率方面,表2明确证明了TAPNext的优势。它在窗口化推理方面实现了最佳的追踪速度,在逐帧推理方面实现了最低的延迟,同时与CoTracker3和LocoTrack-B等基线相比,内存消耗也最低。定性结果(如作者所述)进一步加强了这些发现,显示TAPNext比竞争对手更准确地处理遮挡、快速运动以及追踪细长/小型、无纹理的物体。模型能够为被追踪区域准确地传播视觉信息,即使在被遮挡时,也表明SSM层有效地编码和传播了外观信息。

局限性与未来方向

虽然TAPNext标志着点追踪的重大飞跃,但本文坦率地承认了一个显著的局限性:“在超过150帧的视频的长期点追踪中存在显著失败”。这一问题主要归因于状态空间模型目前无法有效泛化到比其训练时长(48帧)显著更长的视频片段。尽管通过裁剪SSM中的遗忘门和广播查询特征找到了一种部分缓解方法,但这仍然是未来改进的关键领域。解决SSM的这一局限性为进一步提升TAPNext已有的强大追踪性能提供了巨大的机会。

展望未来,TAPNext的发现开启了几个令人兴奋的讨论话题和未来研究方向:

-

推进SSM以实现极端时间泛化:目前在超过150帧的视频中存在的局限性表明,需要新颖的SSM架构或训练方法,能够处理任意长序列而不会出现性能下降。能否开发分层SSM或自适应循环机制来更好地管理长程依赖性?如果我们探索SSM中的动态内存分配以适应视频长度会怎样?

-

扩展“下一个Token预测”范式:本文提出,将TAP视为下一个Token预测的TAPNext框架可以“扩展到视频中的许多其他计算机视觉任务”。这是一个深刻的声明。如何将这种范式应用于目标检测、分割甚至视频生成等任务,其中时间连贯性和点级理解至关重要?能否从这种方法中涌现出一个统一的视频基础模型?

-

深化对涌现启发式方法的理解:复杂追踪启发式方法(运动、坐标、外观匹配)从端到端训练中自然涌现的观察非常吸引人。未来的工作可以更深入地研究这些启发式方法为何以及如何涌现。我们能否设计实验或可解释性工具来更好地理解导致这种涌现特性的内部机制?这可以为设计更通用、偏置更少的架构提供信息。

-

优化坐标头和不确定性估计:分类坐标头被认为是TAPNext最重要的组成部分之一。对其参数化的进一步研究,特别是用于表示多模态预测和从离散箱精炼连续坐标输出,可能会带来显著的收益。此外,通过整合更先进的概率建模来增强模型固有的不确定性估计,可以在挑战性场景中提高鲁棒性。

-

利用开源贡献:作者立即开源推理代码和模型权重的承诺,并计划开源训练代码,这是一个关键步骤。这将使更广泛的研究社区能够快速进行实验、构建和发展TAPNext。未来的讨论应侧重于如何最好地促进这种协作开发,例如通过社区驱动的基准测试或推动视频理解边界的共享挑战。

-

通过BootsTAP弥合模拟到真实差距:BootsTAP微调策略被证明有助于弥合模拟到真实差距。未来的工作可以探索更先进的自监督或半监督学习技术,这些技术可以进一步减少对稀缺真实世界标注数据的依赖,使TAP模型更具可扩展性并适用于各种真实世界场景。

这些多样的观点强调,TAPNext不仅是一个新的最先进模型,而且是一项基础性工作,可能激发新一轮通用、简洁且可扩展的视频理解研究。

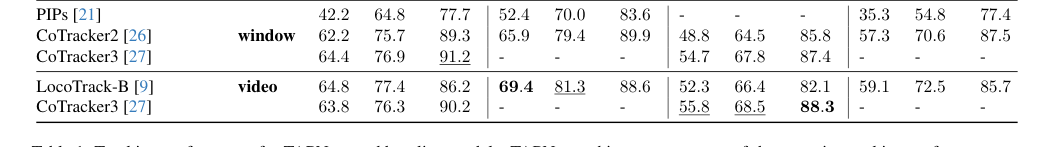

Table 1. Tracking performance for TAPNext and baseline models. TAPNext achieves a new state-of-the-art point tracking performance on eight of the twelve metrics, while also achieving the lowest possible latency. Methods are organized by their latency. Latency: video - these models require the entire video as input before outputting the point tracks. Latency: window - these models output tracks of length T after consuming a chunk of T frames (typically T = 8). After filling a buffer of T frames, these models can operate in a per-frame fashion. Latency: frame - these models have minimal latency by outputting point predictions immediately after consuming each frame. In each column, the best performing values are in bold, the second best are underlined

Table 1. Tracking performance for TAPNext and baseline models. TAPNext achieves a new state-of-the-art point tracking performance on eight of the twelve metrics, while also achieving the lowest possible latency. Methods are organized by their latency. Latency: video - these models require the entire video as input before outputting the point tracks. Latency: window - these models output tracks of length T after consuming a chunk of T frames (typically T = 8). After filling a buffer of T frames, these models can operate in a per-frame fashion. Latency: frame - these models have minimal latency by outputting point predictions immediately after consuming each frame. In each column, the best performing values are in bold, the second best are underlined

Table 2. Speed comparison of TAPNext3to online Cotracker3 running on Nvidia V100 and H100 GPUs. The latency metric is defined as the maximum (worst case) time between passing a frame to the model and receiving predicted points and it includes the time it takes to fill and process the initial frame buffer. All models are implemented in PyTorch. TAPNext (frame) is per frame inference of TAPNext. TAPNext (window) is when we track with non-overlapping chunks of 32 frames

Table 2. Speed comparison of TAPNext3to online Cotracker3 running on Nvidia V100 and H100 GPUs. The latency metric is defined as the maximum (worst case) time between passing a frame to the model and receiving predicted points and it includes the time it takes to fill and process the initial frame buffer. All models are implemented in PyTorch. TAPNext (frame) is per frame inference of TAPNext. TAPNext (window) is when we track with non-overlapping chunks of 32 frames

与其他领域的同构性

结构骨架

一种循环序列到序列模型,通过利用已知Token和学习到的时空关系来插补时空数据流中的缺失Token。