关于小型图神经网络在求解线性规划中的能力

Graph neural networks (GNNs) have recently emerged as powerful tools for addressing complex optimization problems.

背景与学术渊源

起源与学术渊源

本文所解决的问题源于蓬勃发展的“学习优化”(Learning to Optimize, L2O)领域,该领域旨在通过整合机器学习技术来提升传统优化过程的效率。在L2O中,图神经网络(GNNs)因其处理复杂优化问题的能力,特别是在线性规划(LP)和混合整数线性规划(MILP)方面,近期获得了显著的关注。

历史上,GNNs在理论上已被证明能够普遍逼近LP的解映射函数。然而,这些基础理论结果,特别是来自Chen等人[8]和Qian等人[29]的研究,通常假设GNN需要大量的参数或相对于问题维度而言的多项式深度才能达到任意精度。这一理论要求源于它们对多层感知机(MLPs)的通用逼近定理等概念的依赖。

这些先前方法的根本局限性或“痛点”在于理论预测与实际观察之间的显著差异。实践中,研究人员发现相对小型GNN——通常具有适中的宽度和少于十层的深度——能够有效地解决具有数百个节点和约束的LP问题,并在其有限的规模下取得良好的性能。这种实际的成功与理论上对大型、复杂GNNs的需求形成了鲜明对比,产生了一个巨大的鸿沟。本文的作者正是为了弥合这一鸿沟而撰写,旨在为为何以及何时小型GNN能够有效解决LP问题提供理论基础,特别是针对装箱LP(packing LPs)和覆盖LP(covering LPs)。

直观的领域术语

- 线性规划 (Linear Programming, LP):想象一下你有一个制作饼干的食谱,但你只有有限的面粉、糖和黄油。你想尽可能多地制作饼干(或者如果你卖饼干,最大化你的利润),同时不超出你的配料限制。线性规划是一种数学工具,它能帮助你在给定这些简单、线性的约束条件下,找出制作饼干的最佳组合以实现你的目标。

- 图神经网络 (Graph Neural Networks, GNNs):将一个社交网络想象成节点代表人物,连接代表友谊。GNN就像一个聪明的侦探,通过与每个人及其朋友交流来了解他们,然后利用这些集体信息来理解整个网络。在优化中,它从问题中变量和约束之间的关系中学习。

- 装箱LP (Packing LPs):想象一下试图将尽可能多的不同大小的箱子装进一辆卡车,而不超过其重量或体积容量。装箱LP是一个优化问题,它帮助你找到在有限空间或预算内“装载”事物(如资源或物品)的最佳方法,确保你不超出任何限制。

- 覆盖LP (Covering LPs):想象一下你需要放置安全摄像头来覆盖一个建筑物的入口,每个摄像头覆盖几个特定的入口。覆盖LP帮助你找到覆盖所有入口所需的最小摄像头数量,确保每个入口都被监控。

- 多对数深度、恒定宽度GNNs (Polylogarithmic-depth, Constant-width GNNs):这描述了一种“浅层”(多对数深度意味着其层数随问题规模增长得非常缓慢,如 $\log(\text{size})$ 或 $\log^2(\text{size})$)且“瘦”(恒定宽度意味着每层具有固定、少量内部处理单元,与问题规模无关)的GNN。它就像一个非常高效、紧凑的计算机器,仍然能够解决大问题。

符号表

| 符号 | 描述 |

|---|---|

| $A$ | LP的约束矩阵 ($n \times m$) |

| $x$ | 对偶变量向量 ($m \times 1$) |

| $y$ | 对偶变量向量 ($n \times 1$) |

| $X^k$ | 第 $k$ 次迭代时的对偶变量矩阵 ($m \times d$) |

| $Y^k$ | 第 $k$ 次迭代时的对偶变量矩阵 ($n \times d$) |

| $d$ | 扩展变量的通道维度 |

| $n$ | 约束数量($A$ 的行数) |

| $m$ | 对偶变量数量($A$ 的列数) |

| $K$ | GNN层数(迭代次数) |

| $\mu$ | ELU输入的缩放参数 |

| $\epsilon$ | 近似精度参数 |

| $\text{ELU}(\cdot)$ | 指数线性单元激活函数 |

| $\text{ReLU}(\cdot)$ | 修正线性单元激活函数 |

| $f_{\theta^k}(\cdot)$ | 对偶变量更新的可学习函数(乘法) |

| $g_{\theta^k}(\cdot)$ | 对偶变量更新的可学习函数(加法) |

| $W^k$ | 通道混合的可学习权重矩阵 ($d \times d$) |

| $\odot$ | Hadamard积(逐元素乘法) |

| $1_{p \times q}$ | $p \times q$ 的全1矩阵 |

| $\Theta$ | GD-Net中所有可学习参数的集合 |

| $obj_i$ | 实例 $i$ 的预测目标值 |

| $obj^*_i$ | 实例 $i$ 的最优目标值 |

| R. Gap | 相对差距:$|obj_i - obj^*_i| / obj^*_i$ |

| A. Gap | 绝对差距:$|obj_i - obj^*_i|$ |

问题定义与约束

核心问题表述与困境

本文旨在解决图神经网络(GNNs)在处理线性规划(LP)问题时,理论理解与实际观察之间存在的显著差距。

输入/当前状态:

起点是已建立的理论结果,即GNNs能够普遍逼近LP问题的解映射函数。然而,这些理论证明通常需要GNN具有大量参数或相对于问题维度的多项式深度。同时,经验证据一致表明,相对小型GNNs(例如,具有适中宽度和少于十层的GNNs)能够有效地解决LP问题,并在实践中取得良好的性能。

期望终点/目标状态:

主要目标是提供一个稳健的理论基础,解释为何以及何时小型GNNs能够有效地解决LP问题。具体而言,本文旨在证明具有多对数深度和恒定宽度的GNNs足以以任意精度逼近一类广泛的LP问题,即装箱LP和覆盖LP。这种对更小、更高效GNNs的理论验证将指导参数高效模型在学习优化(L2O)中的开发,并可能加速传统的LP和混合整数线性规划(MILP)求解器。

缺失环节/数学鸿沟:

确切的缺失环节是小型GNNs在实践中取得成功所需的理论依据。先前关于GNNs在LP中通用逼近能力的研究依赖于大模型规模(例如,大参数量或多项式深度)的假设,这与观察到的实际效率产生了脱节。本文试图通过数学证明来弥合这一差距,即GNNs可以模拟精心选择的势函数的梯度下降算法的变体,从而在显著更小的架构(多对数深度和恒定宽度)下实现强大的逼近保证。

痛苦的权衡与困境:

核心困境是“理论预测与实际观察之间的显著差异”(摘要,第1页)。研究人员一直“陷入”一种权衡:在LP求解中,为GNNs获得强大的理论保证传统上需要大型、计算密集型的模型,而实际实现中,较小的、更高效的模型却出奇地有效。这造成了一个痛苦的选择:理论严谨性(要求大型模型,高计算成本和大量训练数据)与实际效率(由小型模型实现,但其成功缺乏正式解释)。本文明确将此表述为“一个有趣的开放问题:何时以及为何小型GNN能够有效地解决LP问题?”(引言,第2页),强调了调和理论-经验鸿沟的必要性。

约束与失败模式

开发高效且理论上可靠的GNNs用于LP求解的问题受到几个严峻、现实的限制:

- 计算资源限制: 较大的GNNs天然需要“更多的训练样本和更高的计算资源”(引言,第2页)。这是实际限制,如果理论保证总是需要大规模模型,它将限制GNNs的可扩展性和适用性。“参数高效模型”(引言,第2页)的驱动直接解决了这个问题。

- 问题复杂性与规模: LP,特别是装箱LP和覆盖LP,可能涉及数百个节点和约束(引言,第2页)。在可接受的时间范围内高效地解决这些大规模问题是一个重大挑战。

- 模型规模的理论界限: 对于一般LP,先前的理论结果要求GNN具有“大参数量”或“深度……相对于问题维度为多项式”(引言,第2页)。这一理论障碍使得证明小型GNN的有效性变得困难,尽管它们在实践中取得了成功。

- 近似精度要求: 目标是获得一个 $(1+\epsilon)$-近似解(第1.1节,第2页)。这意味着GNN不仅要高效,还要保持高水平的解的质量,这在减小模型尺寸时是一项非琐碎的任务。

- 解的可行性: 基于机器学习的优化求解器的一个常见失败模式是产生不可行的解。GD-Net输出的

x_final或y_final可能不满足所有LP约束(例如,$x \ge 0$,$Ax \le 1$)。本文通过一个“可行性恢复”(Feasibility resortation)的后处理程序(第7页,第8页)来解决这个问题,表明这是一个需要克服的关键约束。 - 非可微操作: 底层的梯度下降算法(算法1和2)涉及条件更新(if-else语句)和

max操作,这些都是非可微的。直接将它们翻译成神经网络是有问题的。作者通过用可学习的sigmoid函数(方程4、5、6,第6页)近似Heaviside阶跃函数,并使用ReLU来处理非负性,有效地将非可微逻辑转化为可微分的神经网络架构来规避这一点。这是展开迭代算法中的一个关键技术约束。 - 硬件内存限制: 虽然没有明确说明是硬性限制,但实验设置提到了“2.95 TB RAM”(E节,第16页),这暗示内存对于大型LP实例来说可能是一个重要的限制,而小型GNNs自然会减轻这种压力。

- 收敛速度: 迭代算法需要在合理数量的步骤内收敛。本文指出Awerbuch-Khandekar算法具有“多对数收敛性”(第4页),而GNN必须设计成模拟这种高效收敛。

为什么选择此方法

选择的必然性

采用GD-Net架构,该架构展开了Awerbuch-Khandekar梯度下降算法的一个变体,这不仅仅是一个设计选择,而是由图神经网络(GNNs)在解决线性规划(LP)问题时,现有理论理解与实际观察之间存在的显著差距所驱动的必然结果。传统的理论结果,通常依赖于通用逼近定理,表明GNN需要大量的参数或相对于问题维度的多项式深度才能有效地以任意精度解决LP问题(摘要,第1页;第2页)。然而,实际实验一致表明,相对小型GNN能够取得良好的性能,这造成了一种令人费解的差异。

作者们意识到,像传统的图卷积网络(GCNs)这样的标准GNN不足以弥合这一差距,因为虽然它们可以实现多对数深度,但无法保证恒定宽度(Remark 1,第7页)。这意味着通用GNN仍然需要“足够宽的感知机”来模拟ELU等函数以任意精度,从而未能满足“小型”要求(第7页)。然而,Awerbuch-Khandekar梯度下降算法的一个特定变体提供了一个独特的优势:它可以“更自然地被GNN模拟”,其中“算法的一次迭代可以通过恒定宽度的GNN层来模拟”(第4页)。这种从迭代优化算法到具有恒定宽度和多对数深度的GNN结构的直接映射(Theorem 3 and 5,第7-8页)提供了理论上解释小型GNNs在解决装箱LP和覆盖LP方面实际成功的最可行途径。

比较优势

GD-Net方法在结构设计和固有的参数节约方面,展示了优于先前方法的定性优势,超越了简单的性能指标。

首先,GD-Net的架构在根本上与底层优化问题相一致。通过展开针对装箱LP和覆盖LP的理论上可靠的梯度下降算法,它利用了这些问题的内在结构。这与更通用的GNN架构(如GCNs)形成对比,GCNs虽然强大,但并非专门为模拟此类迭代优化过程而设计。这种结构优势使得GD-Net能够“更好地捕捉问题的结构细微之处”(第9页)。

其次,GD-Net在参数效率方面表现出压倒性的优势。实验表明,GD-Net以“比GCN少一个数量级的参数”实现了更好的解决方案(第3页)。例如,一个具有64个隐藏单元的四层GD-Net仅使用1,656个参数,而一个可比的GCN需要34,306个参数(第9页)。这种参数的大幅减少转化为更低的内存复杂度和计算开销,使得模型更实用、更具可扩展性。

第三,该方法在解的质量和速度方面表现出卓越的性能。表1(第9页)显示,GD-Net在各种LP类型(IS、Packing、ECP、SC)和问题规模上,始终实现了比GCNs更窄的相对差距和绝对差距。即使在GD-Net的测试误差可能略高的情况下,其相对差距仍然更优,表明对最优解的定性逼近更好。此外,与传统求解器PDLP和Gurobi相比,GD-Net始终能以显著更少的时间获得相当的精度水平。例如,Gurobi的单纯形法需要长达300倍的时间才能收敛到与GD-Net相同的质量的解决方案(第10页)。这突显了GD-Net生成高质量解决方案的能力,这对于实际应用至关重要。

最后,GD-Net表现出强大的泛化能力和可扩展性。它能够泛化到更大的问题实例,并且在用较小数据集训练后“只有微小的性能下降”(第9页,表2)。“随着问题规模的增加,其推理时间仍然可以接受”(第18页),而GCN则需要“显著更多的时间来处理和预测更大的问题实例”(第18页)。

与约束的对齐

所选的GD-Net方法完美地符合问题的隐式约束,特别是使用小型GNN和强大的理论基础来获得有效解决方案的需求。核心问题陈述围绕着弥合“理论预测与实际观察之间关于LP求解所需GNN尺寸的显著差异”(摘要,第1页)。

GD-Net的设计通过展开Awerbuch-Khandekar梯度下降算法的一个变体,直接解决了这一问题,证明了“多对数深度、恒定宽度的GNN足以解决装箱LP和覆盖LP”(摘要,第1页;Theorem 3 and 5,第7-8页)。这一理论结果为小型GNN的有效性提供了急需的理论基础,直接满足了以有限模型复杂度实现高性能的约束。问题严苛要求(小型、高效模型)与解决方案的独特属性(恒定宽度、多对数深度GNN模拟已知迭代算法)之间的“联姻”在此理论保证中显而易见。

此外,该方法通过将梯度下降算法的一次迭代与一个恒定宽度的GNN层进行模拟的能力(第4页),确保了网络的结构本质上是高效且可扩展的。算法步骤与网络层之间的这种直接对应关系自然地限制了模型的宽度,符合“小型”约束,同时保持了清晰、可解释的机制。

替代方案的拒绝

本文基于其理论局限性、经验性能和计算效率,对几种替代方法进行了隐式和显式的拒绝,特别是针对使用小型GNN解决装箱LP和覆盖LP的特定问题。

通用GNNs(例如,GCNs): 考虑并拒绝的主要替代方案是为了实现小型解决方案的通用GNNs,如GCNs。虽然这些模型也能实现多对数深度,但作者明确指出,对于此类架构,“恒定宽度不再有保证”(Remark 1,第7页)。这意味着为了达到任意精度,GCNs将需要“足够宽的感知机”,导致非恒定宽度,从而未能满足GD-Net成功解决的“小型”约束(第7页)。在实践中,尽管GD-Net使用了“参数量少一个数量级”(第3页,表1,第9页),GCNs在相对差距和绝对差距方面始终表现出较差的性能,并且通常具有更高的验证/测试误差。此外,GCNs表现出较差的可扩展性,与GD-Net相比,“需要显著更多的时间来处理和预测更大的问题实例”(第18页)。

传统LP求解器(PDLP, Gurobi): 本文还将GD-Net与已建立的、理论上可靠的LP求解器进行了基准测试,如PDLP(一种一阶方法)和商业求解器Gurobi(使用原始单纯形法)。虽然这些求解器很稳健,但对于速度和效率至关重要的场景,它们被拒绝作为主要解决方案。PDLP“在更短的时间内无法产生与GD-Net相当的解决方案质量”(第10页)。Gurobi尽管精度很高,“需要长达300倍的时间才能收敛到与GD-Net相同的质量的解决方案”(第10页)。这归因于单纯形法计算成本高昂的矩阵分解(第10页)。因此,虽然在正确性方面并非“失败”,但其计算成本使其不太适合受益于更快速、高质量近似解或热启动的应用,而GD-Net能高效地提供这些。

本文没有讨论其他机器学习范式,如生成对抗网络(GANs)或扩散模型,因为它们不直接适用于解决线性规划问题。重点仍然是GNNs及其与经典优化算法的关系。

数学与逻辑机制

主方程

本文机制的核心在于其图神经网络(GNN)架构GD-Net,该架构旨在模拟Awerbuch-Khandekar梯度下降算法的一个变体,用于解决线性规划(LP)问题。具体而言,对于装箱LP,算法的一次迭代,对应于一个GNN层,由两个主要更新方程控制。这些方程描述了对偶变量(代表约束)和对偶变量(代表物品)如何被迭代更新。

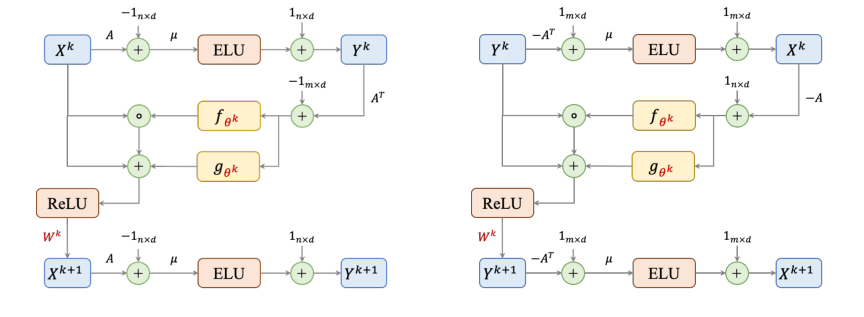

对偶变量 $Y^k$ 在迭代 $k$ 时的更新由下式给出:

$$Y^k := \text{ELU}[\mu(A X^k - 1_{n \times d})] + 1_{n \times d}$$

而对偶变量 $X^{k+1}$ 在下一次迭代 $k+1$ 时的更新为:

$$X^{k+1} = \text{ReLU} (\{X^k + f_{\theta^k}(A^T Y^k - 1_{m \times d}) \odot X^k + g_{\theta^k}(A^T Y^k - 1_{m \times d})\} \cdot W^k)$$

对于覆盖LP,存在一套类似的方程,反映了这些问题的对偶性质。

逐项解剖

让我们剖析这些方程以理解每个组件的作用:

方程 1:$Y^k := \text{ELU}[\mu(A X^k - 1_{n \times d})] + 1_{n \times d}$

- $Y^k$:这是一个 $n \times d$ 的矩阵,代表在迭代 $k$ 时对偶变量(或约束价格)的当前状态。每一行对应一个约束,每一列是通道扩展的特征维度。其物理作用是量化每个约束的“紧迫性”或“违反程度”。

- $\text{ELU}[\cdot]$:指数线性单元激活函数,逐元素应用。其数学定义为 $\text{ELU}(t) = t$ 当 $t > 0$ 时,以及 $\text{ELU}(t) = \alpha(\exp(t) - 1)$ 当 $t \le 0$ 时。在本文中,$\alpha$ 固定为1。作者使用ELU来精确复制原始算法1中的指数函数更新 $y_i := \exp[\mu(A_i x^k - 1)]$,因为ELU的输入 $\mu(A_i x^k - 1)$ 在执行过程中始终是非正的。这种非线性对于GNN学习复杂映射至关重要。

- $\mu$:一个标量参数,固定为 $1/\ln(mA_{\max})$。在数学上,它缩放ELU函数的输入。其物理/逻辑作用是控制对偶变量更新对约束违反的敏感度。较小的 $\mu$(由于较大的 $m$ 或 $A_{\max}$)意味着更新不那么激进。

- $A$:这是线性规划的 $n \times m$ 约束矩阵。每个元素 $A_{ij}$ 要么是零,要么大于1。其作用是定义对偶变量与约束之间的关系。

- $X^k$:一个 $m \times d$ 的矩阵,代表在迭代 $k$ 时对偶变量(或物品数量)的当前状态。每一行对应一个对偶变量,每一列是特征维度。其物理作用是表示LP的当前建议解决方案。

- $1_{n \times d}$:一个所有元素都为1的 $n \times d$ 矩阵。用于逐元素操作。

- $A X^k$:这是一个矩阵乘法,结果是一个 $n \times d$ 的矩阵。$(A X^k)_{id}$ 的每个元素代表对偶变量按约束系数加权的总和,用于约束 $i$ 和特征维度 $d$。其物理作用是计算装箱LP约束 $Ax \le 1$ 的左侧。

- $A X^k - 1_{n \times d}$:逐元素减法。该项量化了每个约束 $i$ 在每个特征维度 $d$ 上的违反程度或松弛度。如果 $(A X^k)_{id} - 1_{id} > 0$,则约束被违反。

- $+ 1_{n \times d}$:逐元素加一个全1矩阵。该项与ELU函数结合,确保 $y$-更新精确匹配原始Awerbuch-Khandekar算法的指数更新。加法用于将ELU的输出移位以匹配所需的指数行为。

方程 2:$X^{k+1} = \text{ReLU} (\{X^k + f_{\theta^k}(A^T Y^k - 1_{m \times d}) \odot X^k + g_{\theta^k}(A^T Y^k - 1_{m \times d})\} \cdot W^k)$

- $X^{k+1}$:代表下一次迭代的更新后的对偶变量的 $m \times d$ 矩阵。

- $\text{ReLU}(\cdot)$:修正线性单元激活函数,逐元素应用。数学上,$\text{ReLU}(t) = \max(0, t)$。其物理/逻辑作用是强制对偶变量的非负约束($x \ge 0$),这是LP的基本约束。

- $f_{\theta^k}(\cdot)$ 和 $g_{\theta^k}(\cdot)$:这些是可学习函数,定义为sigmoid函数的和(论文中的方程5和6)。它们逐元素应用于输入矩阵。其数学作用是近似原始Awerbuch-Khandekar算法条件更新中使用的Heaviside阶跃函数 $f(t)$ 和 $g(t)$(方程4)。其物理/逻辑作用是根据聚合的对偶信息,确定应用于每个对偶变量的调整幅度与类型。作者使用求和(在 $f_{\theta^k}$ 和 $g_{\theta^k}$ 定义为sigmoid和时隐式地)来构建这些函数,允许对原始分步更新进行平滑、可微分的近似。

- $A^T$:约束矩阵 $A$ 的转置。

- $A^T Y^k$:矩阵乘法,结果是一个 $m \times d$ 的矩阵。该项将对偶变量信息 ($Y^k$) 聚合回对偶变量,有效地计算每个对偶变量的“梯度状”信号。在势函数 $\Phi_p(x)$ 的上下文中,$\nabla \Phi_p(x) = A^T y$。

- $A^T Y^k - 1_{m \times d}$:逐元素减法。这代表了每个对偶变量的“梯度”或“更新方向”,指示了它应该被调整多少。

- $\odot$:Hadamard积(逐元素乘法)。该运算符用于将 $f_{\theta^k}$ 的缩放因子逐元素应用于 $X^k$,模仿原始算法中的乘法更新 $(1+\beta)$ 或 $(1-\beta)$。

- $W^k$:一个 $d \times d$ 的可学习权重矩阵。这是神经网络中的标准线性变换。其作用是混合扩展变量通道($d$个特征维度)的信息,增强模型的表达能力。这里的乘法是矩阵乘法,变换特征向量。

- 花括号 $\{\dots\}$ 包含当前对偶变量和两个更新项的总和。这代表了核心梯度下降步骤,其中当前解决方案根据计算出的梯度和可学习函数进行调整。加法用于将当前状态与计算出的更新相结合。

逐步流程

想象一个单一的抽象数据点,代表一个对偶变量 $x_j$,它在装箱GD-Net的一个层(迭代 $k$)中进行遍历:

- 初始化: 在过程开始时($k=0$),所有对偶变量 $X^0$ 都初始化为 $0_{m \times d}$。对偶变量 $Y^0$ 也被有效初始化或从 $X^0$ 导出。

- 对偶到对偶消息传递(Y-更新):

- 约束评估: 对于每个约束 $i$,当前的对偶变量 $X^k$ “发送消息”给它。这包括计算加权和 $A_i X^k$($A X^k$ 的第 $i$ 行)。这个和代表了所选对偶变量当前使用了多少第 $i$ 种资源。

- 违反度计算: 计算出的和 $A_i X^k$ 然后与约束限制(对于标准形式LP为1)进行比较,得到 $A_i X^k - 1_{n \times d}$。这个值指示约束 $i$ 是否被违反(正值)或满足(负值/零)。

- 对偶变量更新: 这个“违反信号”被 $\mu$ 缩放,并通过ELU激活函数,然后通过加1来移位。这个变换生成更新后的对偶变量 $Y^k$。概念上,被严重违反的约束将导致其对应的对偶变量增加更多,表明违反这些约束的“成本”更高。

- 对偶到对偶消息传递(X-更新):

- 梯度聚合: 现在,更新后的对偶变量 $Y^k$ “发送消息”回对偶变量。对于每个对偶变量 $x_j$,项 $A_j^T Y^k$($A^T Y^k$ 的第 $j$ 行)聚合了 $x_j$ 所参与的所有约束的影响。这个聚合信号充当“梯度”,指示调整 $x_j$ 会如何影响整体目标和约束满足。

- 条件调整: 这个梯度信号 $A^T Y^k - 1_{m \times d}$ 被输入到可学习函数 $f_{\theta^k}$ 和 $g_{\theta^k}$ 中。这些函数,如同一个复杂决策单元,根据聚合的对偶信息决定如何调整当前的 $X^k$(通过 $f_{\theta^k} \odot X^k$)以及如何向其添加(通过 $g_{\theta^k}$)。这一步模仿了原始算法的条件逻辑:如果一个变量的梯度低于某个阈值,则增加它;如果高于,则减少它。

- 特征变换: 组合更新然后与可学习权重矩阵 $W^k$ 相乘。此步骤允许每个对偶变量的 $d$ 个特征维度之间的信息进行混合和变换,丰富其表示。

- 非负性强制: 最后,ReLU激活函数逐元素应用于结果。这确保了更新后的对偶变量 $X^{k+1}$ 的所有分量都保持非负,遵守了LP的基本约束。

整个序列构成GD-Net的一个层。输出 $X^{k+1}$ 然后成为下一层的输入 $X^k$,过程重复 $K$ 层,迭代地优化解决方案。

优化动力学

GD-Net的学习和收敛动力学根植于其设计,即作为一个展开的梯度下降算法,并带有可学习的组件。

- 学习机制: GD-Net通过优化其可学习参数集 $\Theta = \{\theta^k, W^k\}_{k=0}^{K-1} \cup \{w^K\}$ 来学习。这些参数包括sigmoid基函数 $f_{\theta^k}$ 和 $g_{\theta^k}$ 的内部系数,以及通道混合矩阵 $W^k$。学习目标是最小化网络最终输出 $x^{\text{final}}(\Theta, A)$ 与给定LP实例 $A$ 的真实最优解 $x^*$ 之间的均方误差(MSE)。这是一个监督学习任务,网络在LP实例及其已知最优解的数据集上进行训练。

- 参数更新: 参数 $\Theta$ 使用标准的基于梯度的优化算法(例如,Adam, SGD)进行更新。在训练过程中,计算损失函数 $L_p(\mathcal{I}; \Theta)$,并通过整个 $K$ 层网络的反向传播计算其相对于 $\Theta$ 的梯度。这些梯度指示了每个参数应如何调整以减少预测误差。

- 损失景观与收敛: 本文强调,原始的Awerbuch-Khandekar算法在一个精心选择的势函数 $\Phi_p(x)$(或 $\Phi_c(y)$)上运行,该函数是可微分且凸的。这意味着对偶下降的底层优化问题具有一个行为良好、单极值的损失景观。通过展开该算法,并用可学习、可微分的函数(由sigmoid组成的 $f_{\theta^k}, g_{\theta^k}$)和线性变换($W^k$)替换其条件更新,GD-Net旨在模拟并加速这种收敛。

- ELU和ReLU激活的使用引入了非线性,这对于GNN的表达能力至关重要。虽然整个神经网络的训练损失景观可能不是凸的,但其设计确保了每一层的更新步骤都是对凸函数梯度下降步骤的近似。

- 理论结果(定理3和5)保证,在足够多的层数(多对数深度)和恒定宽度下,GD-Net可以获得 $(1+\epsilon)$-近似解。这意味着GD-Net层的迭代更新有效地收敛到近优解,继承了原始算法的收敛特性。

- ReLU激活在通过确保对偶变量保持非负性来维持对偶变量的可行性方面起着关键作用。然而,本文也提到了“可行性恢复”的后处理步骤,这表明网络的原始输出有时需要微调才能严格满足所有约束,这是学习优化方法中的常见做法。可学习函数 $f_{\theta^k}$ 和 $g_{\theta^k}$ 允许网络自适应地学习梯度下降的最佳“步长”和“方向”,与固定参数算法相比,可能导致更快、更鲁棒的收敛。

Figure 1. The architectures of a single layer in packing (left) and covering (right) GD-Nets. Learnable parameters are colored in red

Figure 1. The architectures of a single layer in packing (left) and covering (right) GD-Nets. Learnable parameters are colored in red

结果、局限性与结论

实验设计与基线

GD-Net有效性的实验验证经过精心设计,旨在严格测试其在各种线性规划(LP)问题上相对于既有基线的性能。

数据集: 我们使用了四个不同的LP松弛,这些松弛源自公开可用的混合整数优化实例:最大独立集(IS)、装箱问题、边覆盖问题(ECP)和集合覆盖(SC)。每种问题类型都由四组不同规模的实例表示:小型(S)、中型(M)、大型(L)以及专门的泛化(Gen)集。对于训练,我们使用了5,000个实例,另外100个用于验证,100个用于测试。所有实例都经过了标准化处理,并使用SCIP [5]优化求解器获得了其最优解,作为地面真实值。问题规模(行数和列数)和矩阵密度等详细规格在附录中提供。

模型和训练设置: 我们的GD-Net架构与[29]中的传统图卷积网络(GCN)实现进行了基准测试,GCN是学习优化(L2O)中一种流行的GNN架构。两种模型都配置为四层架构,每层包含64个隐藏单元。参数数量出现了一个惊人的差异:GD-Net仅使用了1,656个参数,比GCN的34,306个参数少一个数量级。对于GD-Net,近似参数 $\epsilon$ 设置为0.2。所有模型都使用学习率为 $10^{-3}$ 的Adam优化器训练了10,000个epoch,并保存了性能最佳的检查点(最低验证损失)进行评估。为确保完全可复现性,代码可在 https://anonymous.4open.science/r/GD-Net-6FC7/ 公开获取。

指标: 为了量化性能,我们采用了两个关键指标:

- 相对差距 (R. Gap):定义为 $|obj_i - obj^*_i| / obj^*_i$,其中 $obj_i$ 是可行性恢复后的预测目标值,$obj^*_i$ 是最优目标值。

- 绝对差距 (A. Gap):定义为 $|obj_i - obj^*_i|$。

这些指标使我们能够评估每个模型生成的解决方案的质量。

硬件和软件: 所有实验都在配备Intel(R) Xeon(R) Platinum 8280 CPU @ 2.70GHz和2.95 TB RAM的服务器上进行。数据生成由Ecole 0.7.3和Pyscipopt 4.2.0提供支持,模型实现则使用PyTorch 2.1开发。

其他基线: 为了提供全面的比较,我们还评估了GD-Net与两个传统LP求解器的性能:一阶求解器PDLP [19]和商业求解器Gurobi [12](特别是其原始单纯形法)。此比较侧重于每种方法达到与GD-Net相当精度的解决方案所需的时间。对于最大流问题,GD-Net也与传统的Ford-Fulkerson方法进行了比较。

证据证明了什么

实验结果提供了令人信服且无可辩驳的证据,表明GD-Net的核心机制,其灵感来源于在精心选择的势函数上展开梯度下降,在现实中有效且显著优于传统GNN和传统求解器。

相对于GCN的卓越性能: 如表1所示,GD-Net在所有测试的LP问题(IS、Packing、ECP、SC)和问题规模(S、M、L)上,始终实现了更窄的相对和绝对目标差距。这是在GD-Net使用参数量少一个数量级(GCN为1,656 vs. 34,306)的情况下实现的。例如,在IS-S数据集上,GD-Net实现了 4.41% 的R. Gap,而GCN为 15.46%。即使在GD-Net测试误差略高的情况下,如Packing-L,其目标差距(7.35%)仍然略优于GCN(7.37%),这表明GD-Net能更好地捕捉问题的底层结构细微之处。这明确证明了GD-Net的设计能够带来更参数高效的模型,并产生更高质量的解决方案。

对更大实例的稳健泛化: 表2展示了GD-Net强大的泛化能力。当在大型(L)实例上训练,然后在更大的泛化(Gen)实例(约束和变量增加10%)上测试时,GD-Net仅表现出微小的性能下降。例如,对于Packing,R. Gap仅从 7.06%(L)增加到 7.06%(Gen),这展示了其对增加问题复杂性的鲁棒性和可扩展性。这对于训练数据可能仅限于较小实例的实际应用至关重要。

相对于传统求解器的效率: 与PDLP和Gurobi的比较(表3)突显了GD-Net卓越的效率。为了达到与GD-Net相同精度水平的解决方案,传统求解器需要显著更多的时间。对于具有10,000个变量的SC问题,GD-Net耗时 0.335秒,而Gurobi耗时 103.322秒(约300倍),PDLP耗时 1.001秒。这明确证明了GD-Net能够高效地生成高质量解决方案,在同等解决方案质量下,在速度上甚至优于高度优化的商业求解器。

在二分图最大流上的性能: 对于二分图最大流问题(BMP),GD-Net始终实现了比GCN更好的预测,最优性差距仅为1%(表8)。此外,GD-Net在达到高质量解决方案方面比传统的Ford-Fulkerson方法显著更快(表9),证明了其在该特定图问题上的效率和有效性。

更快的推理时间: 推理时间分析(表10)显示,GD-Nets在所有数据集和规模上始终实现了比GCNs显著更快的推理时间。这种强大的可扩展性意味着GD-Net的推理时间即使在问题规模增加时也保持可接受的水平,这是实际部署的关键优势。

总之,证据无情地证明了GD-Net通过展开梯度下降的一个变体,提供了一种理论上可靠且在实践中更优的解决装箱LP和覆盖LP的方法,弥合了关于小型GNN所需尺寸的理论预测与实际观察之间的长期差距。

局限性与未来方向

尽管GD-Net架构代表了显著的进步,但认识到其当前局限性并考虑未来发展方向至关重要。

当前局限性:

1. 理论差距的持续存在: 尽管缩小了理论与实践之间的差距,但关于GNN所需最小尺寸的理论差异仍然存在。我们的理论证明确立了多对数深度和恒定宽度足以解决装箱LP和覆盖LP,但GNN尺寸的确切下界仍是活跃的研究领域。需要进一步的理论工作来完全理解小型GNN理论上可以如何实现。

2. 对LP类型的特异性: 当前的GD-Net架构专门针对装箱LP和覆盖LP,这是一类广泛但并非普遍的LP。其直接适用性和已证明的有效性不适用于一般LP,除非进一步修改或理论基础。这意味着对于任意LP公式,当前的GD-Net可能不是最优的,甚至不是可行的解决方案。

3. 缺乏统计显著性报告: 说实话,我也不完全确定这一点,但作者明确表示由于重复实验的计算成本,未提供误差条。虽然可以理解,但对于对结果变异性进行严格统计评估而言,这是一个小小的局限性。

未来方向:

1. 进一步理论上的尺寸缩减: 自然的下一步是继续探索如何从理论上进一步减小GNN的尺寸。我们能否实现更严格的深度和宽度界限,或者识别其他架构约束,以用更少的参数保持性能?这可能涉及研究不同的展开策略或新颖的GNN层。

2. 泛化到更广泛的LP类别: 扩展GD-Net对一般LP的适用性是一个关键方向。这可能需要设计新的势函数或调整展开机制以处理一般LP中更广泛的约束和目标函数。挑战在于保持势函数的理想属性(可微分性、凸性、收敛保证)。

3. 集成到MILP求解器中: 鉴于在加速LP求解方面的成功,探索GD-Nets在混合整数线性规划(MILP)的学习优化(L2O)框架中是一个有前途的方向。MILP求解器通常依赖于重复求解LP松弛(例如,在分支定界算法中)。GD-Nets可以提供高质量的初始值或加速LP子问题的求解,从而可能导致更高效的MILP解决方案。这可能涉及使用GD-Nets来指导变量选择或分支决策。

4. 新颖的势函数设计: GD-Net的成功源于在精心选择的势函数上展开梯度下降。未来的研究可以专注于设计具有相似或甚至更好属性的新势函数,以适应不同类别的优化问题。这可能会解锁针对特定问题结构的新的GNN架构,将“展开”范式扩展到装箱和覆盖LP之外。

5. 对数据分布变化的鲁棒性: 虽然本文展示了对更大实例的良好泛化能力,但进一步研究GD-Net对问题实例分布显著变化的鲁棒性(例如,不同的约束矩阵或目标向量)将是有价值的。这可能涉及开发自适应训练策略或对分布外输入不敏感的架构。

与其他领域的联系

数学骨架

这项工作的纯数学核心是理论证明,即一类特定的图神经网络可以模拟指数加权梯度下降算法的一个变体,用于解决装箱和覆盖线性规划。这种模拟将迭代优化步骤映射到GNN层,为近似提供了多对数深度和恒定宽度保证。

相邻研究领域

深度学习中优化算法的展开

这项工作直接贡献于将优化算法展开到深度学习架构的领域。GD-Net的设计通过明确地将LP的Awerbuch-Khandekar梯度下降算法的迭代更新映射到GNN的层来实现。例如,$y$-更新,$y_i^k := \exp[\mu(A_i x^k - 1)]$,以及随后的$x$-更新,$x_j^{k+1} := x_j^k + f_{0k}(A_j^T y^k - 1) \cdot x_j^k + g_{0k}(A_j^T y^k - 1)$,被实现为GNN层。这种方法利用GNN中的可学习参数来潜在地加速收敛或提高解决方案质量,与原始的固定规则迭代算法相比,这是该研究领域的一个常见动机。这种方法展示了经典优化与现代神经网络设计之间强大的联系。

(Yang et al., 2021, ICML)

分布式优化算法

本文的基础在于适应Awerbuch-Khandekar分布式梯度下降算法。LP的二分图表示,其中节点代表变量和约束,自然适合分布式计算。矩阵向量乘法,如 $Ax$ 或 $A^T y$,它们是梯度更新的核心,可以解释为这些变量和约束节点之间的消息传递操作。GNN固有的消息传递机制直接模拟了这些分布式信息交换和局部更新,提供了一个基于神经网络的分布式LP求解框架。这突显了GNN如何被视为分布式算法的计算模型。

(Awerbuch and Khandekar, 2009, SIAM J. Comput.)

组合优化的近似算法

装箱和覆盖LP是许多NP难组合优化问题(包括最大独立集、集合覆盖和边覆盖)的基本松弛。本文提供了理论保证,即所提出的GD-Net可以在多对数迭代次数(GNN层)内找到这些LP的 $(1+\epsilon)$-近似解。这直接联系到近似算法的设计和分析,其目标是找到具有相对于最优解的质量可证明界限的解决方案,通常针对计算上难以精确求解的问题。这里的GNN充当了一个学习到的、高效的近似方案,为解决困难的组合问题提供了一条新途径。

(Cappart et al., 2023, J. Mach. Learn. Res.)