联邦模型异构的嵌套表示学习

Model heterogeneous federated learning (MHeteroFL) enables FL clients to collaboratively train models with heterogeneous structures in a distributed fashion.

背景与学术渊源

起源与学术谱系

本文所解决的模型异构联邦学习(Model Heterogeneous Federated Learning, MHeteroFL)问题,源于传统联邦学习(Federated Learning, FL)固有的局限性。最初,FL 被构想为一种隐私保护方法,其中中央服务器协调多个数据所有者(客户端)训练一个单一的、全局共享的模型,而无需直接暴露本地数据。在每个通信轮次中,服务器广播全局模型,客户端在本地数据上训练该模型,然后将更新后的本地模型发送回来进行聚合,形成新的全局模型。此过程重复进行直至收敛,仅传输模型参数,从而保护数据隐私。

然而,这种传统的 FL 设计在应用于现实场景时遇到了显著的“痛点”,这迫使了 MHeteroFL 等更高级方法的开发。这些局限性包括:

- 数据异构性(非独立同分布数据): 客户端的本地数据通常不遵循独立同分布(non-IID)模式。这意味着从如此多样化的本地数据集中聚合的单一全局模型,可能在所有客户端上都无法达到最优性能。例如,一个客户端的数据可能严重偏向某个特定类别,而另一个客户端的数据则包含不同的类别。

- 系统异构性: FL 客户端可能拥有截然不同的计算能力和网络带宽。强制所有客户端训练相同、通常较大的模型结构,意味着全局模型的大小必须适应最弱的设备,从而导致在能够处理更大、更复杂模型的更强大客户端上性能不佳。

- 模型异构性: 在实际的 FL 应用中,尤其是在客户端是企业的情况下,它们可能拥有具有独特架构或知识产权(IP)问题的专有模型。由于 IP 保护,在 FL 训练期间直接共享这些异构模型或其结构通常是不可接受的。

现有的 MHeteroFL 方法,尽管试图通过允许客户端训练具有定制结构的模型的来解决这些挑战,但仍然受到知识转移能力有限的困扰。它们通常依赖于训练损失来在客户端和服务器模型之间转移知识,这可能导致性能瓶颈、高昂的通信和计算成本,以及暴露私有本地模型结构和数据的持续风险。本文提出了 FedMRL,通过借鉴嵌套表示学习(Matryoshka Representation Learning)的思路,增强自适应表示融合和多视角表示学习的知识转移能力,以克服这些局限性。

直观的领域术语

为了帮助零基础读者理解核心概念,这里提供一些论文中的专业术语及其日常类比翻译:

- 联邦学习(Federated Learning, FL): 想象一场烹饪比赛,多位厨师(客户端)用他们的秘密食材(本地数据)制作各自独特的菜肴(本地模型)。他们不分享食谱,只将烹饪技巧的总结发送给主评委(中央服务器)。评委结合这些总结,制定通用的烹饪建议(全局模型),并将其发回给厨师。这样,每个人都能改进自己的菜肴,而无需透露自己的私密食谱。

- 模型异构联邦学习(Model Heterogeneous Federated Learning, MHeteroFL): 在烹饪类比的基础上,想象每位厨师拥有不同类型的厨房设备(多样化的系统资源)并偏好不同风格的菜肴(异构模型结构)。MHeteroFL 就像一位非常灵活的主评委,即使他们都在使用不同的工具和烹饪方法,也能为每位厨师提供有用的、量身定制的建议。评委帮助他们集体进步,而无需强迫每个人以相同的方式烹饪或使用相同的设备。

- 嵌套表示学习(Matryoshka Representation Learning, MRL): 想象一套俄罗斯套娃。每个娃娃都是一个完整的版本,但比前一个更小、细节更少。MRL 就像训练一个系统,从数据中生成“嵌套”的洞察。它可以产生非常广泛、通用的理解(最大的娃娃),也可以产生更具体、更精细的细节(里面的小娃娃)。这使得系统能够为任务使用恰到好处的细节级别,如果只需要通用理解,就可以节省计算成本,就像你可能只需要看到最大的娃娃就能知道它是套娃一样。

- 非独立同分布数据(Non-IID Data, Non-Independent and Identically Distributed Data): 考虑一个学习动物的班级。如果数据是 IID 的,每个学生都会有一本教科书,其中包含猫、狗、鸟和鱼的图片,比例均衡。非 IID 数据就像一个学生的教科书主要关于猫,另一个学生的教科书主要关于狗,第三个学生的教科书主要关于鸟。他们各自的学习材料(本地数据)分布不均,不能完美地代表所有动物(全局数据分布)的范围。这使得一个统一的课程计划难以对每个人都有效。

符号表

| 符号 | 描述 |

|---|---|

问题定义与约束

核心问题表述与困境

本文的核心问题在于模型异构联邦学习(MHeteroFL)领域,该领域旨在使具有不同模型架构的多个客户端能够在不共享原始本地数据的情况下,协同训练一个全局模型。

输入/当前状态:

传统的联邦学习(FL)通过中央服务器协调 $N$ 个客户端来训练一个单一的、共享的全局模型。在每个通信轮次中,服务器广播全局模型,客户端在本地数据上训练该模型,然后将更新后的本地模型发送回来进行聚合。此过程重复进行直至收敛,仅传输模型参数以保护数据隐私。然而,这种传统的 FL 设计在实际应用中普遍存在的三个关键异构性挑战方面存在困难:

1. 数据异构性(非 IID): 客户端的本地数据集通常遵循非独立同分布(non-IID)模式,这意味着从如此多样化的本地数据聚合的单一全局模型,在各个客户端上可能表现不佳。

2. 系统异构性: FL 客户端拥有不同的计算资源(例如,CPU、GPU、内存)和网络带宽。要求所有客户端训练相同的模型结构意味着全局模型的大小必须受限于最弱的设备,导致在更强大的客户端上性能不佳。

3. 模型异构性: 客户端,尤其是企业,可能拥有具有不同、不可共享结构的专有本地模型,这是由于知识产权(IP)问题。这阻止了直接的参数平均或聚合。

现有的 MHeteroFL 方法试图解决这些挑战,但主要依赖于通过训练损失在客户端和服务器模型之间转移知识。然而,这种方法导致知识交换有限,从而导致性能瓶颈、高昂的通信和计算成本,以及暴露私有本地模型结构和数据的潜在风险。

期望终点(输出/目标状态):

本文旨在开发一种新颖的 MHeteroFL 方法,命名为联邦模型异构嵌套表示学习(FedMRL),该方法能够有效且联合地解决监督学习任务中的数据、系统和模型异构性。目标是实现:

1. 增强的知识转移: 促进服务器的全局同构模型与客户端的异构本地模型之间更有效的知识交互。

2. 改进的模型性能: 实现比现有 SOTA 方法更高的模型精度。

3. 低通信和计算成本: 最大限度地减少与模型训练和更新相关的开销。

4. 强大的隐私保护: 确保客户端的本地数据和异构模型结构不暴露给服务器或其他客户端。

5. 个性化适应: 使学习过程能够适应本地非 IID 数据分布和多样化的客户端资源。

缺失环节或数学鸿沟:

确切的缺失环节是缺乏一种有效且高效的机制,能够在隐私保护的方式下,跨异构模型和数据分布进行知识转移。当前方法对训练损失的依赖进行知识转移是不够的。FedMRL 试图通过引入两项关键创新来弥合这一差距:

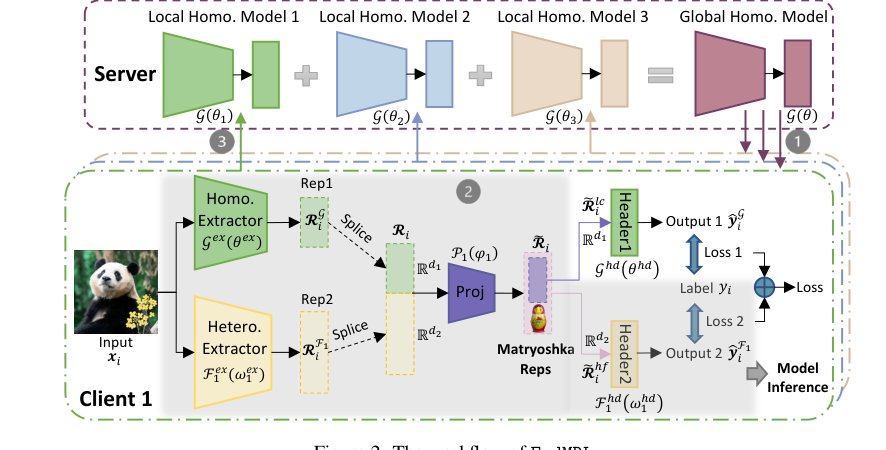

1. 自适应表示融合: 对于每个本地数据样本,来自全局同构小型模型和本地异构模型的特征提取器分别提取通用和个性化表示。然后,这些表示被拼接并通过个性化的轻量级表示投影器 $P_k(\phi_k)$ 映射到融合表示,该投影器适应本地非 IID 数据。

2. 多粒度表示学习: 融合表示用于构建嵌套表示,这些表示是多维度的、多粒度的嵌入式表示。这些表示由全局同构模型和本地异构模型的预测头进行处理,它们的组合损失用于更新所有模型。

在数学上,本文旨在最小化以下目标函数(方程 1):

$$

\min_{\theta, \omega_0, \dots, \omega_{N-1}, \phi_0, \dots, \phi_{N-1}} \sum_{k=0}^{N-1} l(W_k(D_k; (\theta \circ \omega_k | \phi_k)))

$$

其中 $W_k(w_k) = (G(\theta) \circ F_k(w_k) | P_k(\phi_k))$ 表示客户端 $k$ 的组合模型,它结合了全局同构小型模型 $G(\theta)$、客户端的本地异构模型 $F_k(w_k)$ 和个性化表示投影器 $P_k(\phi_k)$。损失 $l$ 是基于嵌套表示的多视角输出来计算的。

困境:

困扰研究人员的痛苦权衡是,在实现高模型性能和跨异构 FL 客户端的有效知识转移之间,同时保持低通信/计算成本和强大的隐私保证之间存在固有的冲突。改进一个方面通常会损害另一个方面。例如,共享更多信息(如完整的模型参数或详细的中间表示)可以增强知识转移和性能,但会急剧增加通信成本和隐私风险。相反,限制共享信息以保护隐私和降低成本,通常会导致“有限的知识交换”和“模型性能瓶颈”(第 2 页,第 1 节),从而导致准确性不佳,尤其是在非 IID 数据上。困境是如何在不暴露敏感的客户端细节或压垮资源受限的情况下,实现丰富、多视角的知识交互。

约束与失效模式

模型异构联邦学习的问题由于作者遇到的几个严峻的现实障碍而变得异常困难:

- 非 IID 数据分布: 客户端的本地数据通常是非独立同分布(non-IID)的,这使得训练一个在所有客户端上都表现良好的单一全局模型变得具有挑战性。这需要个性化模型或自适应机制,这增加了复杂性。

- 多样化的客户端系统资源: FL 客户端的计算能力、内存和网络带宽各不相同。任何提出的解决方案都必须足够高效,以便在最弱的设备上运行,同时还能利用更强大设备的优势。这对模型大小和每个客户端的计算开销施加了严格的限制。

- 专有模型结构和 IP 保护: 客户端可能使用多样化的、专有的本地模型架构,由于知识产权问题,这些架构不能直接共享或聚合。这阻止了传统的联邦平均模型参数。

- 有限的知识转移有效性: 现有的 MHeteroFL 方法,特别是那些依赖训练损失或简单互学习的方法,通常只能实现“有限的知识转移”(第 1 页,摘要;第 3 页,第 2 节)。这导致模型性能不佳和收敛缓慢。

- 高通信成本: 在每个轮次中,在服务器和众多客户端之间传输大型模型参数或大量的中间表示会产生显著的通信成本,尤其是在网络带宽有限的情况下。目标是最小化这一点。

- 高计算开销: 在客户端设备上训练额外的模型或复杂的知识蒸馏机制可能会导致大量的计算开销,这对于资源受限的客户端来说是不希望的。

- 严格的隐私要求: FL 的基本原则是保护本地数据隐私。任何方法都必须确保原始客户端数据和本地模型结构永远不会暴露给服务器或其他客户端。未能遵守这一点是关键的失效模式。

- 非凸优化景观: 具有异构模型的联邦学习中的优化问题通常是非凸的。保证收敛到好的解,更不用说全局最优解,是一个重大的数学挑战。本文提供了理论分析,显示了 $O(1/T)$ 的非凸收敛率(第 1 页,摘要),这是一个常见但仍然具有挑战性的方面。

- 模型性能瓶颈: 在没有有效知识转移的情况下,客户端模型可能会遭受性能瓶颈,无法很好地泛化或达到高精度。

- 可扩展性问题: 该解决方案必须能够扩展到大量客户端($N$)并对每个通信轮次中的不同客户端参与率($C=K/N$)具有鲁棒性(第 3 页,第 3 节)。

这些约束共同使得在具有异构模型的隐私保护、资源高效的联邦学习中实现高性能成为一项极其困难的挑战。

为什么选择此方法

选择的必然性

FedMRL 的开发源于现有模型异构联邦学习(MHeteroFL)方法在面对实际 FL 应用复杂现实时固有的局限性。作者们意识到,即使是适应于联邦设置的传统“SOTA”方法也远远不够,因为它们主要依赖于训练损失在客户端和服务器模型之间进行知识转移。这种依赖导致了几个关键的缺点:“有限的知识交换”、“模型性能瓶颈”、“高昂的通信和计算成本”以及“暴露私有本地模型结构和数据的显著风险”(摘要,第 1 页)。

具体而言,本文强调传统 FL 设计在三个主要的异构性挑战方面存在困难:(1)数据异构性,客户端数据是非 IID 的;(2)系统异构性,客户端拥有不同的计算能力和网络带宽,迫使全局模型适应最弱的设备;(3)模型异构性,客户端拥有专有模型,由于知识产权问题无法直接共享(第 1-2 页,第 1 节)。虽然 MHeteroFL 应运而生以应对这些挑战,但该领域内现有的方法,例如基于自适应子网络、知识蒸馏、模型拆分或互学习的方法,仍然表现出关键的缺陷。例如,互学习方法(FedMRL 的基础)被指出“仅在两个模型之间转移有限的知识,导致模型性能瓶颈”(第 3 页,第 2 节)。

虽然没有明确指出一个单一事件,但通过对先前 MHeteroFL 方法的全面批判,强烈暗示了作者的顿悟时刻。作者们认识到需要一种根本不同的知识转移机制——一种超越简单的基于损失的蒸馏,转向更复杂的表示级别交互。这促使他们借鉴了嵌套表示学习(MRL)[24] 的思想,该方法提供了一种调整表示维度并实现模型性能与推理成本之间最佳平衡的方法。这种转向以表示为中心的方法,而不是以模型或损失为中心的方法,成为了克服联邦学习中异构性、隐私和效率持久挑战的唯一可行途径。

比较优势

FedMRL 通过多种结构和功能优势,远远超越了以往的黄金标准,展示了压倒性的定性优势。

首先,其核心创新在于自适应表示融合和多粒度表示学习。与依赖单一固定表示的方法不同,FedMRL 提取通用表示(来自共享的同构模型)和个性化表示(来自客户端的异构本地模型)。然后,这些表示通过一个轻量级的个性化投影器进行自适应融合,这对于适应本地非 IID 数据分布至关重要(第 4 页,第 3.1 节)。这种结构设计允许对本地数据进行更丰富、更细致的理解,这是那些在数据异构性方面存在困难的方法的重大质的飞跃。随后构建的嵌套表示,涉及多维度和多粒度的嵌入式表示,通过实现多视角学习,进一步增强了模型的学习能力(第 5 页,第 3.2 节)。这是一个结构优势,允许模型学习粗粒度和细粒度的特征,使其更具鲁棒性和有效性。

其次,FedMRL 提供了卓越的隐私保护和资源效率。通过仅在服务器和客户端之间传输小型同构模型,它确保“在训练过程中,每个客户端的本地模型和数据都不会暴露”(第 2 页,第 2 节)。这对于隐私敏感的应用来说是一个关键的结构优势。此外,这种设计本质上带来了“低通信成本”和“低额外计算成本”,因为客户端除了本地模型外,只需要训练一个小型同构模型和一个轻量级投影器(第 2 页,第 2 节)。虽然本文没有明确说明从 $O(N^2)$ 到 $O(N)$ 的内存复杂度降低,但对“小型同构模型”和“轻量级”组件的强调直接暗示了与可能需要更大、更复杂模型或大量数据共享的方法相比,内存和计算足迹的显著减少。

最后,该方法的对非 IID 数据的鲁棒性和更强的个性化能力在定性上是优越的。实验表明,在各种非 IID 设置下,FedMRL 与 FedProto 等基线相比,始终实现了更高的平均测试精度(第 9 页,第 5.3.1、5.3.2 节)。此外,它提供了更强的个性化,其中很大一部分(CIFAR-10 上为 87%,CIFAR-100 上为 99%)的单个客户端取得了比 FedProto 更好的性能(第 8 页,第 5.2.2 节)。这表明在处理多样化的客户端环境和数据分布方面具有根本性的结构优势。

与约束的对齐

FedMRL 的设计完美地契合了异构联邦学习的严苛要求和约束,创造了问题与解决方案之间的协同“联姻”。

- 数据异构性(非 IID 数据): 自适应表示融合机制明确设计用于解决此问题。个性化表示投影器将拼接的通用和个性化表示映射到“适应本地非 IID 数据”的融合表示(第 4 页,第 3.1 节)。这确保了每个客户端独特的数据分布都被考虑在内,从而避免了在非 IID 设置中常见的性能下降。

- 系统异构性: FedMRL 通过引入一个“共享的全局辅助同构小型模型”与“异构本地模型”进行交互来适应多样化的客户端能力(第 2 页,第 2 节)。全局模型故意设计得很小,即使是资源有限的客户端也可以广播和训练它。客户端还可以调整其表示投影器的线性层维度以匹配拼接表示,进一步适应本地系统约束(第 4 页,第 3.1 节)。

- 模型异构性: 该框架本身就支持客户端拥有“具有异构结构的本地模型”(第 4 页,第 3.1 节)。服务器仅与同构小型模型交互,将客户端的异构本地模型视为黑盒。这种设计通过不要求客户端暴露其专有模型结构来尊重知识产权问题。

- 隐私保护: 这是 FedMRL 的基石。“在训练过程中,每个客户端的本地模型和数据都不会暴露,以实现隐私保护”(第 2 页,第 2 节)。仅传输小型同构模型,确保本地数据和模型结构保持私密。

- 通信效率: 通过仅传输“小型同构模型”(第 2 页,第 2 节),FedMRL 与交换完整客户端模型的方法相比,显著降低了通信成本。改变同构小型模型的表示维度 $d_1$ 的能力,进一步允许优化通信开销(第 9 页,第 5.3.3 节)。

- 计算效率: 客户端除了本地模型外,只需要训练一个“小型同构模型和一个轻量级表示投影器”,从而产生“低额外计算成本”(第 2 页,第 2 节)。FedMRL 实现的更快的收敛速度(图 4,第 8 页)也意味着达到目标精度所需的通信轮次更少,从而降低了整体计算开销(第 9 页,第 5.2.4 节)。

- 知识转移限制: 自适应表示融合和多粒度表示学习的两项创新直接解决了先前方法“有限的知识交换”问题。它们通过学习来自多个视角的通用和个性化表示,促进了“跨两个模型更多的知识交互并提高模型性能”(第 3 页,第 2 节)。

替代方案的拒绝

本文通过强调现有 MHeteroFL 方法在解决问题的约束方面的根本性缺陷,系统地识别并拒绝了几类方法:

- 具有自适应子网络的 MHeteroFL: 这些方法从全局模型构建异构本地子网络。作者拒绝了这种方法,因为“在客户端拥有非源自通用全局模型的黑盒本地模型的情况下,服务器无法聚合它们”(第 3 页,第 2 节)。这暗示了无法处理客户端模型是专有的、而非全局模型简单剪枝的真正模型异构性。

- 具有知识蒸馏的 MHeteroFL:

- 依赖公共数据集进行知识转移的方法被认为不切实际,因为“很难找到这样合适的公共数据集”(第 3 页,第 2 节)。

- 训练生成器来合成共享数据集的方法因其“高昂的训练成本”而被拒绝(第 3 页,第 2 节)。

- 其他共享中间信息的方法因可能暴露“客户端本地数据进行知识融合”的风险而被隐式拒绝,这可能损害隐私。

- 模型拆分的 MHeteroFL: 这些方法将模型拆分为特征提取器和预测器,共享其中一个或另一个。本文拒绝了这种策略,因为它“暴露了部分本地模型结构,如果模型是客户端的专有 IP,这可能无法接受”(第 3 页,第 2 节)。这直接与隐私和知识产权保护约束相冲突。

- 互学习的 MHeteroFL: 虽然 FedMRL 以此类为基础,但它明确指出现有的互学习方法(如 FML、FedKD、FedAPEN)是不够的,因为“互损失仅在两个模型之间转移有限的知识,导致模型性能瓶颈”(第 3 页,第 2 节)。FedMRL 被呈现为一种优化,通过转向基于表示的方法而不是仅仅依赖互损失来“增强知识转移”。

本文没有讨论像 GAN、Diffusion 模型或 Transformer 这样的通用深度学习架构作为联邦学习方法本身的替代方案的失败。相反,它隐含地将 CNN(一种 Transformer 的前身架构)作为其框架内的底层模型(表 2,第 17 页)。拒绝的是未能有效管理异构性、隐私和资源效率独特挑战的联邦学习范式,而不是基本的模型架构。

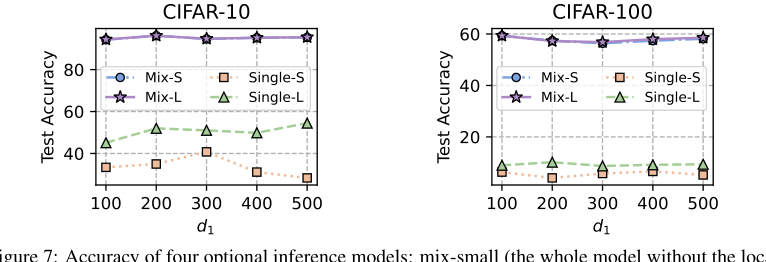

Figure 7. Accuracy of four optional inference models: mix-small (the whole model without the local header), mix-large (the whole model without the global header), single-small (the homogeneous small model), single-large (the client heterogeneous model)

Figure 7. Accuracy of four optional inference models: mix-small (the whole model without the local header), mix-large (the whole model without the global header), single-small (the homogeneous small model), single-large (the client heterogeneous model)

数学与逻辑机制

主方程

FedMRL 方法的核心是其目标函数,旨在最小化联邦学习环境中所有参与客户端的总损失。这个主方程概括了整个学习目标:

$$ \min_{\theta, \omega_0, \dots, \omega_{N-1}, \phi_0, \dots, \phi_{N-1}} \sum_{k=0}^{N-1} l(W_k(D_k; (\theta \circ \omega_k | \phi_k))) $$

逐项解剖

让我们剖析这个主方程及其底层组件,以理解其数学定义、逻辑作用以及构建的理由。

-

$\min_{\theta, \omega_0, \dots, \omega_{N-1}, \phi_0, \dots, \phi_{N-1}}$:这是优化目标。

- 数学定义:它表示目标是找到一组参数($\theta$、$\omega_k$、$\phi_k$),它们最小化后续的损失总和。

- 物理/逻辑作用:这是整个 FedMRL 系统的核心指令。它规定学习过程应调整所有相关模型参数,以使所有客户端的预测尽可能准确。

- 为何最小化:在机器学习中,我们通常定义一个“损失”或“误差”函数,目标是减少这个误差,因此最小化是自然的选择。

-

$\sum_{k=0}^{N-1}$:这是一个求和运算符。

- 数学定义:它将每个客户端的个体损失贡献相加,从客户端 $k=0$ 到 $N-1$。

- 物理/逻辑作用:在联邦学习中,整体性能是所有客户端的集体衡量标准。此求和确保全局目标考虑每个客户端的学习结果,同时尊重本地数据,促进共享学习目标。

- 为何求和而不是,例如,乘积:求和是多客户端或多任务设置中聚合损失的标准方法。乘积对小损失(使总和为零)或大损失(使总和爆炸)非常敏感,导致优化不稳定。求和提供了更稳定、可解释的个体客户端性能聚合。

-

$l(\cdot)$:这代表一个损失函数。

- 数学定义:如论文(方程 8)所述,这通常是交叉熵损失 $l(y, Y_i)$,它衡量模型预测输出 $y$ 与真实标签 $Y_i$ 之间的差异。

- 物理/逻辑作用:损失函数量化了模型预测的“错误”程度。损失越高,预测越差。它为优化过程提供了调整模型参数的信号。

- 为何是交叉熵:交叉熵广泛用于分类任务,因为它对错误的分类进行更严厉的惩罚,并鼓励模型输出与真实标签分布匹配的概率。

-

$W_k(D_k; (\theta \circ \omega_k | \phi_k))$:这表示客户端 $k$ 的组合模型,它在本地数据 $D_k$ 上运行,并由全局($\theta$)、本地($\omega_k$)和个性化投影器($\phi_k$)参数的组合参数化。FedMRL 的核心机制就存在于此处。让我们分解其内部工作原理:

-

$D_k$:这表示客户端 $k$ 的本地数据集。

- 数学定义:一组数据样本 $(x_i, Y_i)$,其中 $x_i$ 是输入特征向量,而 $Y_i$ 是其对应的真实标签。

- 物理/逻辑作用:这是每个客户端用于训练的私有本地数据。在 FL 中,至关重要的是此数据保持本地,不与服务器或其他客户端直接共享。

-

$\theta$:这表示全局同构小型模型的参数。

- 数学定义:$\theta = \{\theta_{ex}, \theta_{hd}\}$,其中 $\theta_{ex}$ 是全局模型特征提取器 $G_{ex}$ 的参数,$\theta_{hd}$ 是其预测头 $G_{hd}$ 的参数。这些参数在所有客户端之间共享。

- 物理/逻辑作用:该模型充当“通用”知识源。它体积小且同构,以最小化通信成本并适应系统异构性。它提供了一个通用的基线表示。

-

$\omega_k$:这表示客户端 $k$ 的异构本地模型的参数。

- 数学定义:$\omega_k = \{\omega_{ex,k}, \omega_{hd,k}\}$,其中 $\omega_{ex,k}$ 是客户端 $k$ 的本地特征提取器 $F_{ex}$ 的参数,$\omega_{hd,k}$ 是其预测头 $F_{hd}$ 的参数。这些参数是每个客户端独有的。

- 物理/逻辑作用:该模型捕获了适应客户端 $k$ 特定数据分布和模型结构的“个性化”知识。它解决了数据和模型异构性问题。

-

$\phi_k$:这表示客户端 $k$ 的个性化表示投影器的参数。

- 数学定义:$\phi_k$ 是轻量级投影器 $P_k$ 的参数。

- 物理/逻辑作用:该投影器负责自适应地融合通用和个性化表示。它针对每个客户端进行个性化,以有效处理本地非 IID 数据分布。

-

$\circ$(拼接运算符):此运算符组合了特征提取器的输出。

- 数学定义:根据方程 (3),$R_i = R_k^g \circ R_k^f$,其中 $R_k^g = G_{ex}(x_i; \theta_{ex,t-1})$ 是来自全局模型特征提取器的通用表示,而 $R_k^f = F_{ex}(x_i; \omega_{ex,t-1})$ 是来自本地模型特征提取器的个性化表示。拼接通常意味着连接特征向量。

- 物理/逻辑作用:此操作将通用特征(通用知识)与个性化特征(客户端特定知识)合并到一个单一的、更丰富的表示中。

- 为何是拼接而不是加法或乘法:拼接(连接)保留了两种来源的独立语义信息。如果我们相加或相乘,信息可能会混合或丢失,特别是当特征空间具有不同尺度或含义时。拼接允许后续投影器学习如何最好地组合这些不同的视角。论文指出它可以“保持相对的语义空间位置”。

-

$|$(嵌套表示学习):此符号概念上代表多维度、多粒度的嵌套表示学习过程。

- 数学定义:在拼接表示 $R_i$ 被投影到融合表示 $R_i = P_k(R_i; \phi_{k,t-1})$(方程 4)之后,它被分成两个嵌入式表示:$R_i^{lc} = R_i^{1:d_1}$(低维度,粗粒度)和 $R_i^{hf} = R_i^{1:d_2}$(高维度,细粒度)(方程 5)。然后将它们输入到不同的预测头:$y_i^{lc} = G_{hd}(R_i^{lc}; \theta_{hd,t-1})$(方程 6)和 $y_i^{F_k} = F_{hd}(R_i^{hf}; \omega_{hd,t-1})$(方程 7)。

- 物理/逻辑作用:此机制的灵感来自俄罗斯套娃,其中小娃娃嵌套在大娃娃里面。这里意味着以不同的粒度和维度提取表示。这使得模型能够从多个视角学习,捕捉粗粒度和细粒度信息,从而增强模型的学习能力和鲁棒性。全局头使用粗粒度表示,而本地头使用细粒度表示。

- 为何拆分和使用不同的头:这种设计实现了“多视角表示学习”。通过让不同的头处理融合表示的不同粒度,模型可以学习到更鲁棒、更全面的特征。这就像从远处观察一个物体以获得整体形状,然后近距离观察细节,两者都有助于更好地理解。

-

$m_i^{lc} \cdot l_i^{lc} + m_i^{F_k} \cdot l_i^{F_k}$(加权损失总和):这是客户端 $k$ 上单个数据点 $i$ 的最终组合损失。

- 数学定义:$l_i = m_i^{lc} \cdot l_i^{lc} + m_i^{F_k} \cdot l_i^{F_k}$(方程 9),其中 $l_i^{lc}$ 是来自全局模型头的损失,而 $l_i^{F_k}$ 是来自本地模型头的损失(方程 8)。$m_i^{lc}$ 和 $m_i^{F_k}$ 是重要性权重,默认通常设置为 1。

- 物理/逻辑作用:这结合了来自通用(全局)和个性化(本地)视角的学习信号。通过对这些损失进行加权,系统可以平衡每个学习分支的影响。将权重设置为 1 确保两个模型都对整体学习做出同等贡献。

- 为何是加法:与整体求和类似,加权损失的相加是组合多个学习目标的标准方法。它允许每个组件做出平衡的贡献,引导模型达到满足粗粒度和细粒度学习目标的最佳状态。

-

分步流程

想象一个数据点,一张图像 $x_i$ 及其真实标签 $Y_i$,进入客户端 $k$ 的 FedMRL 系统。这是它的旅程:

-

特征提取:输入图像 $x_i$ 首先并行进入两个不同的特征提取器。

- 全局同构模型的特征提取器 $G_{ex}$(参数为 $\theta_{ex}$)处理 $x_i$ 以生成通用表示 $R_k^g$。这就像获得对图像的通用、共同的理解。

- 同时,客户端 $k$ 的本地异构模型的特征提取器 $F_{ex}$(参数为 $\omega_{ex,k}$)处理 $x_i$ 以生成个性化表示 $R_k^f$。这捕捉了客户端特定的细节或细微差别。

-

表示拼接:两个表示 $R_k^g$ 和 $R_k^f$ 然后被“拼接”(连接)在一起,形成一个组合表示 $R_i$。此步骤确保通用和个性化信息都并排保留。

-

自适应表示融合:拼接表示 $R_i$ 然后被输入到客户端 $k$ 的个性化轻量级表示投影器 $P_k$(参数为 $\phi_k$)。该投影器将拼接表示映射到融合表示 $R_i$。这是系统根据客户端独特的数据分布调整组合知识的地方。

-

嵌套表示拆分:融合表示 $R_i$ 然后被概念上拆分成两部分,就像打开一个俄罗斯套娃以揭示一个更小的娃娃。

- 从 $R_i$ 的初始部分提取低维度、粗粒度表示 $R_i^{lc}$。

- 从 $R_i$ 的较大部分提取高维度、细粒度表示 $R_i^{hf}$。

-

多视角预测:这两个嵌套表示然后被传递到它们各自的预测头:

- $R_i^{lc}$ 进入全局同构模型的预测头 $G_{hd}$(参数为 $\theta_{hd}$)以生成粗粒度预测 $y_i^{lc}$。

- $R_i^{hf}$ 进入客户端 $k$ 的本地异构模型的预测头 $F_{hd}$(参数为 $\omega_{hd,k}$)以生成细粒度预测 $y_i^{F_k}$。

-

损失计算:对于每个预测,都会根据真实标签 $Y_i$ 计算损失:

- $l_i^{lc}$ 是粗粒度预测 $y_i^{lc}$ 的损失。

- $l_i^{F_k}$ 是细粒度预测 $y_i^{F_k}$ 的损失。

-

加权损失聚合:最后,这两个个体损失通过加权求和组合成数据点 $x_i$ 的单个总损失 $l_i$。默认情况下,两个损失都贡献相等。这个 $l_i$ 是贡献给整体目标函数的数值。

整个过程对批次中的所有数据点重复进行,并使用批次的平均损失进行优化。

优化动力学

FedMRL 机制通过梯度下降过程迭代地学习和更新其参数,旨在最小化全局目标函数。

-

梯度计算:在客户端 $k$ 计算一批数据点的加权损失 $l_i$ 后,将计算该损失相对于客户端 $k$ 模型中涉及的所有参数的梯度:

- $\nabla l_i$ 相对于 $\theta$(全局模型参数)。

- $\nabla l_i$ 相对于 $\omega_k$(客户端 $k$ 的本地模型参数)。

- $\nabla l_i$ 相对于 $\phi_k$(客户端 $k$ 的个性化表示投影器参数)。

-

本地参数更新:每个客户端 $k$ 然后使用这些梯度和预定义的学习率($\eta_\theta$、$\eta_\omega$、$\eta_\phi$)来更新其本地参数($\omega_k$ 和 $\phi_k$)以及其全局模型参数的副本($\theta$)。这是一个标准的梯度下降步骤:

$$ \theta^t \leftarrow \theta^{t-1} - \eta_\theta \nabla l_i \\ \omega_k^t \leftarrow \omega_k^{t-1} - \eta_\omega \nabla l_i \\ \phi_k^t \leftarrow \phi_k^{t-1} - \eta_\phi \nabla l_i $$

这些更新在每个客户端本地进行,使模型适应其特定的数据和学习目标。论文提到默认设置 $\eta_\theta = \eta_\omega = \eta_\phi$ 以实现稳定的收敛。 -

服务器聚合:在本地训练轮次(可能涉及多个本地 epoch)之后,每个参与的客户端将其更新后的同构小型模型参数(即更新后的 $\theta$ 参数)上传到中央服务器。然后,服务器将来自所有参与客户端的这些更新后的全局模型参数进行聚合,以生成一个新的、统一的全局模型 $\theta^t$。这种聚合通常是对接收到的参数进行平均。本地异构模型参数 $\omega_k$ 和投影器参数 $\phi_k$ 保留在客户端,不传输到服务器,从而保护隐私。

-

广播与迭代:新聚合的全局模型 $\theta^t$ 然后广播回所有客户端以进行下一轮通信。这个本地训练、参数上传、服务器聚合和全局模型广播的循环重复指定的轮次,或直至收敛。

损失景观与收敛:FedMRL 的整体损失景观是非凸的,这对于深度学习模型来说是典型的。迭代梯度下降步骤在景观中导航,寻求找到一个最小值。论文第 4 节中的理论分析表明,FedMRL 实现了 $O(1/T)$ 的非凸收敛率,其中 $T$ 是通信轮次的总数。这意味着随着轮次的增加,本地训练整个模型的平均梯度减小,表明模型确实在学习并随着时间的推移而收敛。此收敛的条件取决于学习率以及参数变化和梯度方差的有界性,如引理和定理中所述。自适应表示融合和多粒度表示学习旨在以一种促进更有效知识转移并提高模型找到更好最小值的能力的方式来塑造此损失景观,从而带来卓越的性能。

Figure 2. The workflow of FedMRL

Figure 2. The workflow of FedMRL

结果、局限性与结论

实验设计与基线

为了严格验证 FedMRL 的数学声明和实际有效性,作者们设计了一个全面的实验设置。所提出的 FedMRL 方法使用 Pytorch 实现,并与七种 SOTA MHeteroFL 方法进行了基准测试。这些实验在强大的硬件配置上进行,该配置包括四个 NVIDIA GeForce 3090 GPU,每个 GPU 配备 24GB 内存。

与 FedMRL 对比的“受害者”(基线模型)分为四类:

1. 独立训练: 客户端在本地数据上独立训练模型。

2. 无公共数据的知识蒸馏: 如 FD [21] 和 FedProto [43] 等方法。

3. 模型拆分: 以 LG-FedAvg [27] 为代表。

4. 互学习: 包括 FML [41]、FedKD [45] 和 FedAPEN [37]。

使用了两个广泛使用的 FL 图像分类基准数据集:CIFAR-10(60,000 张 32x32 彩色图像,10 个类别)和 CIFAR-100(60,000 张 32x32 彩色图像,100 个类别)。对于两者,使用了 50,000 张图像用于训练,10,000 张用于测试。为了模拟现实的联邦环境,构建了两种类型的非 IID(非独立同分布)数据分布:

* 非 IID(类别): 客户端被分配有限数量的类别(CIFAR-10 为 2 个,CIFAR-100 为 10 个),类别数量越少表示非 IID 性越强。

* 非 IID(狄利克雷): 使用狄利克雷($\alpha$) 函数来控制数据分布,其中较小的 $\alpha$ 表示更显著的非 IID 性。

评估涵盖了模型同构(所有客户端使用 CNN-1)和模型异构(客户端混合使用 CNN-1 到 CNN-5)的 FL 场景。FedMRL 的表示投影器是一个简单的单层线性模型。在模型同构设置中,FedMRL 使用 CNN-1 作为其同构全局小型模型,但其表示维度 $d_1$ 小于客户端的 $d_2$。在模型异构设置中,FedMRL 使用最小的 CNN-5 模型作为其全局组件,同样具有减小的 $d_1$。

性能评估涵盖了三个关键方面:

* 模型准确性: 所有客户端的平均测试准确性。

* 通信成本: 以服务器与一个客户端之间为了达到目标平均准确性而传输的总参数数量来衡量,同时考虑每轮的参数数量和轮次数量。

* 计算开销: 以每个客户端为了达到目标平均准确性而产生的总 FLOPs(浮点运算次数)来衡量,同时考虑每轮的 FLOPs 和轮次数量。

训练策略涉及所有算法的广泛超参数调优,包括批量大小、epoch 数、通信轮次和学习率。至关重要的是,FedMRL 的独特超参数 $d_1$(同构全局小型模型的表示维度)从 100 变化到 500,以找到最佳的权衡。实验在三种不同的 FL 设置(N=10, C=100%;N=50, C=20%;N=100, C=10%)下进行,涵盖模型同构和模型异构场景。作者报告了每个实验设置三次试验的平均结果。

证据证明的内容

实验证据提供了确凿、不可否认的证明,表明 FedMRL 的核心机制——自适应个性化表示融合和多粒度表示学习——在实践中有效,并带来了卓越的性能。

卓越的模型准确性:

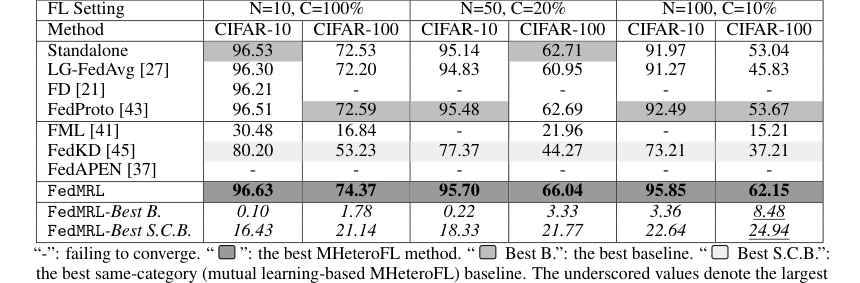

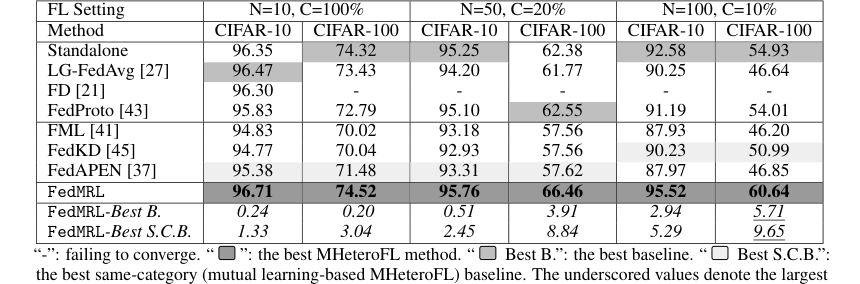

* FedMRL 在模型异构(表 1)和模型同构(表 3,附录 C.2)的 FL 设置中,始终优于所有七种 SOTA 基线。

* 它在平均测试准确性方面取得了令人印象深刻的提升,比最佳整体基线高出 8.48%,比最佳同类(基于互学习)基线高出 24.94%。

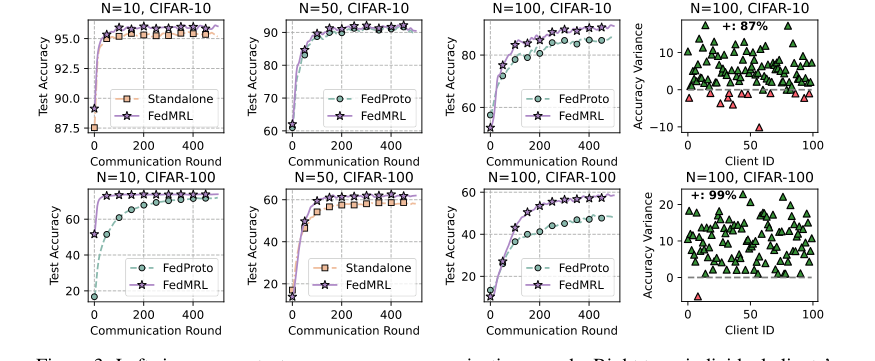

* 图 3(左侧六个图)在各种客户端和参与率设置下,直观地证实了 FedMRL 比最佳基线(FedProto)更快的收敛速度和更高的最终平均测试准确性。

增强的个性化:

* 图 3(右侧两个图)展示了 FedMRL 和 FedProto 之间个体客户端测试准确性的差异。令人瞩目的是,87% 的 CIFAR-10 客户端和 99% 的 CIFAR-100 客户端在使用 FedMRL 时取得了更好的性能。这是 FedMRL 卓越个性化能力的有力证据,直接归因于其自适应个性化多粒度表示学习设计。

提高的效率:

* 通信成本: 虽然 FedMRL 传输完整的同构小型模型,导致每轮通信成本高于 FedProto(后者仅发送本地已见类别平均表示),但图 4(左侧)显示 FedMRL 需要更少的通信轮次才能达到目标准确性,从而实现更快的收敛。此外,当考虑可选的较小表示维度($d_1$)时,FedMRL 的通信效率高于使用较大表示维度的其他互学习基线(FML、FedKD、FedAPEN)。

* 计算开销: 尽管每轮训练额外的同构小型模型和轻量级表示投影器会产生开销,但图 4(右侧)表明 FedMRL 的总计算成本低于 FedProto。这是其收敛速度更快,所需总训练轮次更少的直接结果。

对非 IID 数据的鲁棒性:

* 基于类别的非 IID 性: 图 5(左侧两个图)清晰地显示了 FedMRL 的鲁棒性,即使客户端类别数量减少(非 IID 性增加),其平均测试准确性也高于 FedProto。

* 基于狄利克雷的非 IID 性: 图 5(右侧两个图)进一步验证了这种鲁棒性,FedMRL 在所有测试的 $\alpha$ 值下都显著优于 FedProto,证明了其对不同程度数据异构性的抵抗能力。

通过敏感性和消融研究验证机制:

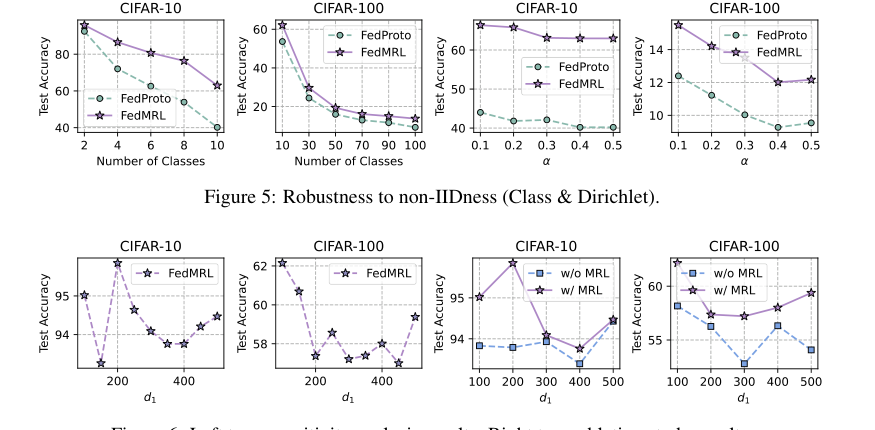

* 对 $d_1$ 的敏感性: 图 6(左侧两个图)显示,较小的 $d_1$ 值(同构小型模型的表示维度)导致更高的平均测试准确性和更低的通信/计算开销。这突显了 $d_1$ 在实现最佳权衡方面的重要性。

* 消融研究: 图 6(右侧两个图)明确证明了嵌套表示学习(MRL)组件的效用。包含 MRL 的 FedMRL 始终优于不包含 MRL 的 FedMRL,证实了多粒度表示学习是 MHeteroFL 的关键设计要素。观察到准确性差距随着 $d_1$ 的增加而减小,这表明当全局和本地头学习的表示越来越重叠时,MRL 的好处就会减少。

推理模型灵活性:

* 附录 C.3 和图 7 显示,“mix-small”(无本地头的整个模型)和“mix-large”(无全局头的整个模型)推理模型实现了相似的高精度,显著优于单一的同构或异构模型。这为用户根据其特定的推理成本要求进行选择提供了实际的灵活性。

局限性与未来方向

尽管 FedMRL 在模型异构联邦学习方面取得了重大进展,但承认其当前局限性并考虑未来发展方向至关重要。

当前局限性:

作者们确定的主要局限性在于嵌套表示中的多粒度嵌入式表示。这些表示目前由全局小型模型的头和本地客户端模型的头共同处理。尽管全局头可能只涉及一个线性层,但这种双重处理仍然增加了存储成本、通信开销以及全局头训练的开销。这表明,虽然 FedMRL 通过加速收敛提高了整体效率,但在与全局模型处理这些多粒度表示相关的资源消耗方面仍有优化空间。

未来方向与讨论话题:

-

简化多粒度处理: 本文明确建议未来工作中采用更先进的嵌套表示学习方法(MRL-E)[24]。这将涉及完全移除全局头,仅依赖本地模型头来处理多粒度嵌套表示。这可能带来模型性能与存储、通信和计算成本之间更好的权衡。

- 讨论: 这种转变如何影响联邦学习的“全局知识”方面?仅依赖本地头进行多粒度处理是否会冒着稀释共享全局模型的益处,还是自适应表示融合机制足以弥补?在不显著增加本地计算负担的情况下,本地模型头需要进行哪些架构更改才能承担这项增加的责任?

-

动态 $d_1$ 优化: 敏感性分析表明,较小的 $d_1$ 值(同构小型模型的表示维度)通常能带来更高的平均测试准确性和更低的通信/计算开销。

- 讨论: $d_1$ 是否可以在 FL 训练过程中动态优化,也许基于客户端特定的数据特征或收敛指标?是否可以使用强化学习方法为不同客户端或通信轮次学习最佳的 $d_1$,而不是依赖于固定的、预先调整的超参数?

-

扩展到无监督/自监督任务: 当前的 FedMRL 方法是为监督学习任务设计的。

- 讨论: 自适应表示融合和多粒度表示学习的原理如何扩展到无监督或自监督联邦学习,这些在标记数据有限的情况下越来越重要?在这些情况下,对损失函数和知识转移机制需要进行哪些修改?

-

对抗性攻击和数据投毒的鲁棒性: 虽然本文提到了隐私保护,但并未明确详细说明对恶意攻击的鲁棒性。

- 讨论: 鉴于增强的知识转移和个性化表示,FedMRL 的架构在多大程度上可以抵抗或容易受到数据投毒或模型反演攻击?除了本文提到的隐私保护机制(例如,差分隐私、安全聚合)之外,还可以集成哪些额外的隐私保护机制来进一步加强其安全性,而不会显著损害其性能或效率优势?

-

扩展到极大的 N 和多样的 C: 实验进行了最多 N=100 个客户端的测试。

- 讨论: FedMRL 如何扩展到拥有数千甚至数百万客户端的联邦网络,特别是考虑到不同的客户端参与率(C)和间歇性的客户端可用性?是否需要对聚合策略或通信协议进行进一步优化,以在如此大规模的部署中保持效率?

-

超越图像分类: 当前的验证是在图像分类数据集上进行的。

- 讨论: FedMRL 在多大程度上能够泛化到其他数据模态和任务,例如自然语言处理、时间序列分析或医学成像?多粒度表示的“嵌套”概念是否能直接转化,还是需要针对特定领域进行特征提取和融合的调整?

这些讨论点旨在激发批判性思维,思考如何利用 FedMRL 的基础见解并对其进行演变,以应对更广泛的挑战并解锁联邦学习领域的新可能性。

Figure 3. Left six: average test accuracy vs. communication rounds. Right two: individual clients’ test accuracy (%) differences (FedMRL - FedProto)

Figure 3. Left six: average test accuracy vs. communication rounds. Right two: individual clients’ test accuracy (%) differences (FedMRL - FedProto)

Figure 6. Left two: sensitivity analysis results. Right two: ablation study results

Figure 6. Left two: sensitivity analysis results. Right two: ablation study results

Table 1. and Table 3 (Appendix C.2) show that FedMRL consistently outperforms all baselines under both model-heterogeneous or homogeneous settings. It achieves up to a 8.48% improvement in average test accuracy compared with the best baseline under each setting. Furthermore, it achieves up to a 24.94% average test accuracy improvement than the best same-category (i.e., mutual learning- based MHeteroFL) baseline under each setting. These results demonstrate the superiority of FedMRL

Table 1. and Table 3 (Appendix C.2) show that FedMRL consistently outperforms all baselines under both model-heterogeneous or homogeneous settings. It achieves up to a 8.48% improvement in average test accuracy compared with the best baseline under each setting. Furthermore, it achieves up to a 24.94% average test accuracy improvement than the best same-category (i.e., mutual learning- based MHeteroFL) baseline under each setting. These results demonstrate the superiority of FedMRL

Table 3. presents the results of FedMRL and baselines in model-homogeneous FL scenarios

Table 3. presents the results of FedMRL and baselines in model-homogeneous FL scenarios

与其他领域的同构性

结构骨架

本文解决方案的核心是一种机制,该机制在不同粒度级别上分解和重组来自多个来源(模型)的信息,以促进分布式系统中稳健、隐私保护的知识转移。